гЂЮАДяПЊдД 9B ВЮЪ§ AI аЁФЃаЭ Nemotron Nano v2ЃЌБШ Qwen3 Пь 6 БЖ

РДдДЃКithome 2025-08-19 14:00:52AIаЁФЃаЭОКШќЩ§МЖЃКгЂЮАДяЭЦГіадФмЧПОЂЕФNemotron Nano v2

дкAIСьгђЯЦЦ№СЫвЛЙЩ"аЁФЃаЭ"ШШГБЁЃМЬТщЪЁРэЙЄбЇдКLiquid AIЭЦГіПЩДЉДїЩшБИЪЪХфЕФЮЂаЭЪгОѕФЃаЭЃЌвдМАЙШИшЗЂВМЪжЛњЖЫдЫааЕФаЁаЭФЃаЭКѓЃЌгЂЮАДяНќШевВМгШыеНОжЃЌЭЦГіСЫЦфзюаТбаЗЂЕФNemotron Nano v2аЁаЭгябдФЃаЭЃЈSLMЃЉЁЃетПюНі9BВЮЪ§ЕФ"аЁ"ФЃаЭдкадФмБэЯжЩЯСюШЫОЊЯВЁЃ

адФмБэЯжССбл

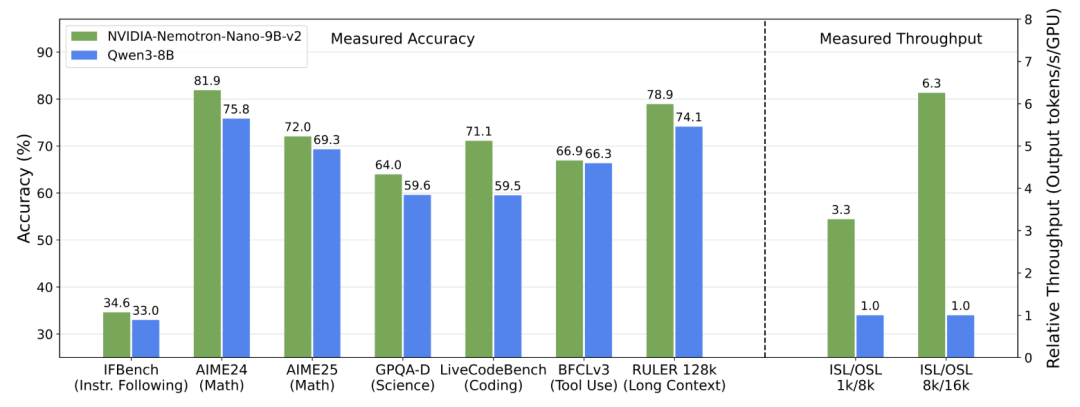

ИљОнВтЪдЪ§ОнЃЌNemotron Nano v2дкИДдгЭЦРэШЮЮёжаЕФзМШЗТЪгыQwen3-8BЯрЕБЩѕжСИќИпЃЌЖјдЫааЫйЖШИќЪЧЬсЩ§СЫОЊШЫЕФ6БЖЁЃетПюгЩгЂЮАДязджїбаЗЂЕФФЃаЭВЩгУСЫЖРЬиЕФЩшМЦРэФюЃЌжМдкГЩЮЊЭЈгУаЭAIНтОіЗНАИЁЃ

ДДаТЙІФмЩшМЦ

ИУФЃаЭзюв§ШЫзЂФПЕФЬиЕуЪЧЦф"ЫМПМдЄЫуПижЦ"ЛњжЦЁЃгУЛЇПЩвдИљОнашЧѓЩшЖЈФЃаЭЭЦРэЙ§ГЬжадЪаэЪЙгУЕФtokenЪ§СПЁЃетжжЩшМЦМШБЃжЄСЫЭЦРэжЪСПЃЌгжЬсИпСЫаЇТЪЁЃММЪѕЭХЖгИКд№ШЫOleksii KuchaievЭИТЖЃЌЫћУЧЭЈЙ§ЬиЪтбЕСЗЗНЗЈНтОіСЫФЃаЭ"ЭЕХм"ЫМПМЕФЮЪЬтЁЃ

ШЋУцПЊдДВпТд

гЂЮАДяДЫДЮВЛНіПЊдДСЫФЃаЭБОЩэЃЌЛЙКБМћЕиЙЋПЊСЫбЕСЗЪ§ОнМЏЁЃетЬзАќКЌ20ЭђвкtokenЕФдЄбЕСЗгяСЯПтЗжЮЊЖрИізЈвЕСьгђЃЌЮЊAIПЊЗЂепЬсЙЉСЫБІЙѓЕФбаОПзЪдДЁЃетжжПЊЗХЬЌЖШдквЕФкЪЕЪєКБМћЁЃ

ММЪѕЯИНкНтЮі

ФЃаЭбЕСЗЙ§ГЬЗжЮЊШ§ИіНзЖЮЃК

- дЄбЕСЗНзЖЮВЩгУFP8ОЋЖШДІРэКЃСПЪ§Он

- КѓбЕСЗНзЖЮЭЈЙ§ЖржжгХЛЏЗНЗЈЬсЩ§адФм

- бЙЫѕНзЖЮЪЙФЃаЭФмдкЦеЭЈGPUЩЯИпаЇдЫаа

ВтЪдНсЙћЯдЪОЃЌИУФЃаЭдкЖрЯюЛљзМВтЪджаБэЯжгХвьЃЌЬиБ№ЪЧдкЪ§бЇЭЦРэКЭГЄЮФБОДІРэЗНУцЁЃ

аавЕгАЯьеЙЭћ

гЂЮАДяНќЦкдкПЊдДСьгђЕФЛ§МЋВМОжЃЌгыВПЗжПЦММОоЭЗзЊЯђБедДаЮГЩЯЪУїЖдБШЁЃЦфNemotronЩњЬЌЯЕЭГЕФГжајЭъЩЦЃЌЬиБ№ЪЧеыЖджаЙњЪаГЁЖдБъQwenЯЕСаЕФеНТдЃЌЛђНЋжиЫмAIПЊдДЩњЬЌИёОжЁЃФПЧАЃЌNemotron Nano v2вбПЊЗХдкЯпЪдгУЃЌИааЫШЄЕФПЊЗЂепПЩвдЧзЩэЬхбщЦфадФмБэЯжЁЃ

БОЮФЪзЗЂгкСПзгЮЛЃЈIDЃКQbitAIЃЉЃЌзїепЃКВЛдВ

ЯРгЮЯЗЗЂВМДЫЮФНіЮЊСЫДЋЕнаХЯЂЃЌВЛДњБэЯРгЮЯЗЭјеОШЯЭЌЦфЙлЕуЛђжЄЪЕЦфУшЪі

ЯрЙиЙЅТд

ИќЖрЭЌРрИќаТ

ИќЖрШШгЮЭЦМі

ИќЖр-

- КНЬьЛ№М§ФЃФтЦї

- Android/ | ФЃФтбјГЩ

- 2026-04-07

-

- УќдЫЦяЪПЭХ

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

-

-

-

-

- зЙаЧДѓТН ТђЖЯАц

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

- ЯцICPБИ14008430КХ-1 ЯцЙЋЭјАВБИ 43070302000280КХ

- All Rights Reserved

- БОеОЮЊЗЧгЏРћЭјеОЃЌВЛНгЪмШЮКЮЙуИцЁЃБОеОЫљгаШэМўЃЌЖМгЩЭјгб

- ЩЯДЋЃЌШчгаЧжЗИФуЕФАцШЈЃЌЧыЗЂгЪМўИјxiayx666@163.com

- ЕжжЦВЛСМЩЋЧщЁЂЗДЖЏЁЂБЉСІгЮЯЗЁЃзЂвтздЮвБЃЛЄЃЌНїЗРЪмЦЩЯЕБЁЃ

- ЪЪЖШгЮЯЗвцФдЃЌГСУдгЮЯЗЩЫЩэЁЃКЯРэАВХХЪБМфЃЌЯэЪмНЁПЕЩњЛюЁЃ