苹果创新“清单法”:用 AI 大模型当“老师”,教小模型更精准执行复杂指令

来源:ithome 2025-08-26 07:00:11xiayx 8月26日报道,据科技媒体 9to5Mac 昨日(8 月 25 日)发布的一篇文章称,苹果公司的研究人员在最新的论文中提出了一种名为“基于清单反馈的强化学习”(RLCF)的新方法。该方法使用任务清单来替代传统的人工点赞/点踩评分,从而显著提升大型语言模型(LLMs)执行复杂指令的能力。

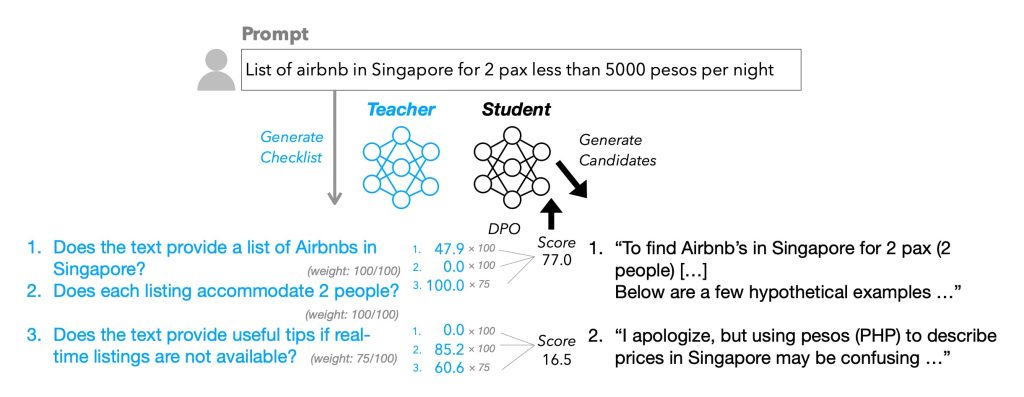

xiayx注:RLCF,即 Reinforcement Learning from Checklist Feedback,与传统的“人类反馈强化学习”(RLHF)不同,它并不依赖人工评分。RLCF 会为每个用户指令生成一份详细的检查清单,并对每一项进行 0-100 分的评分,以此来指导模型的优化。

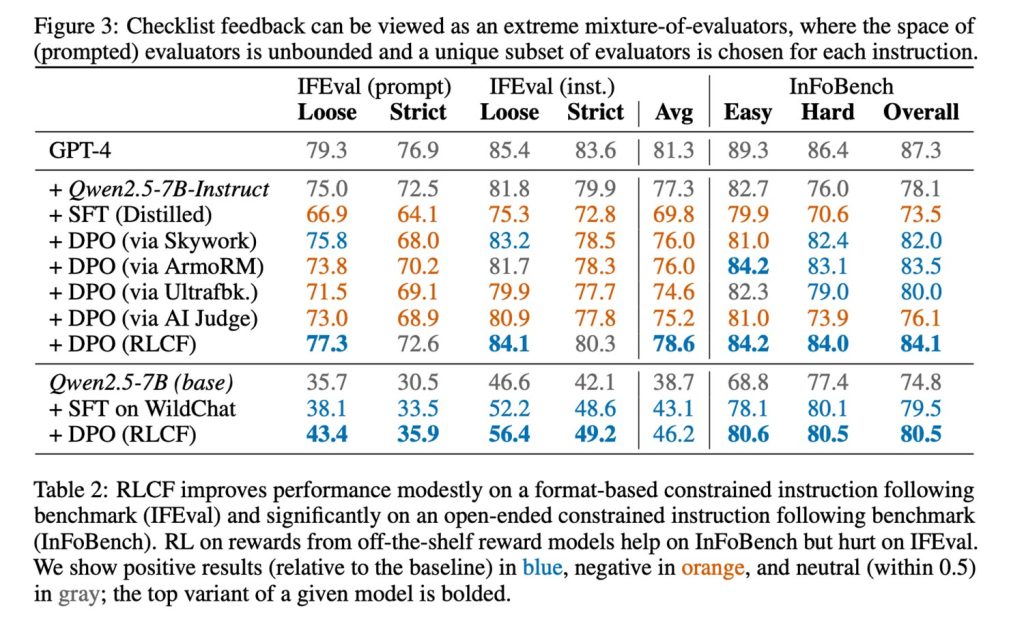

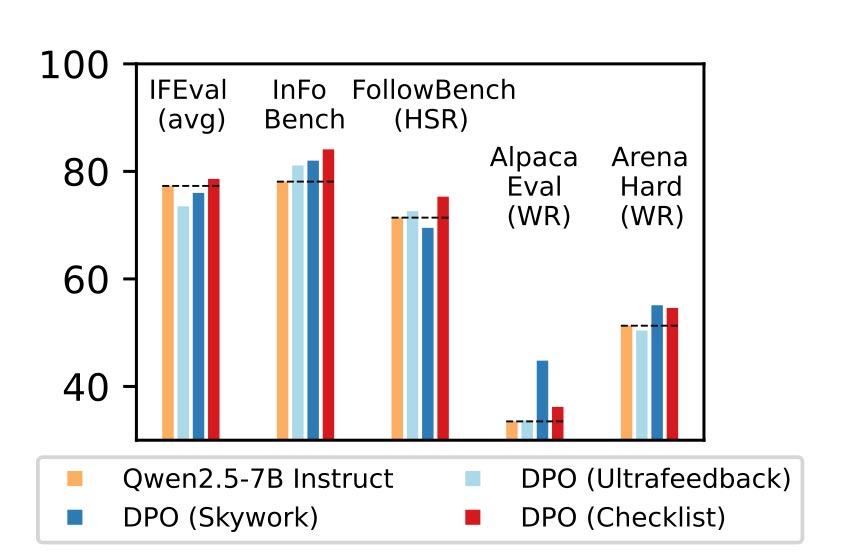

研究团队在强指令跟随模型 Qwen2.5-7B-Instruct 上对该方法进行了测试,测试涵盖了五个常用的评测基准。结果显示,RLCF 是唯一一个在所有测试中都取得了提升的方案:

FollowBench 硬性满意率提升了 4 个百分点InFoBench 提高了 6 点Arena-Hard 胜率增加了 3 点某些任务的最高提升甚至达到了 8.2%。

这些数据表明,清单反馈在执行复杂、多步骤需求方面效果非常显著。

清单的生成过程也很有特点。研究团队利用更大规模的 Qwen2.5-72B-Instruct 模型,并结合现有的研究方法,为 13 万条指令生成了一个名为“WildChecklists”的数据集。清单的内容是一些明确的二元判断项,例如“是否翻译成西班牙语?”。然后,大型模型会对候选答案逐项进行打分,并将综合加权后的分数作为小模型的训练奖励信号。

苹果的研究人员也坦承,这种方法存在一定的局限性。首先,它需要依赖更强大的模型作为评判者,这在资源有限的情况下可能难以实现。其次,RLCF 主要用于提升复杂指令的执行能力,并非专门为安全对齐而设计,因此不能替代安全性评估与优化。此外,该方法对于其他类型任务的适用性还有待进一步验证。

侠游戏发布此文仅为了传递信息,不代表侠游戏网站认同其观点或证实其描述