行业首个:8B 参数面壁小钢炮 MiniCPM-V 4.5 开源,号称“最强端侧多模态模型”

来源:ithome 2025-08-28 10:13:46xiayx 8月27日消息,面壁智能于8月26日宣布,开源其拥有8B参数的MiniCPM-V 4.5多模态旗舰模型,这款“面壁小钢炮”也由此成为业内首个具备高刷新率视频理解能力的多模态模型。

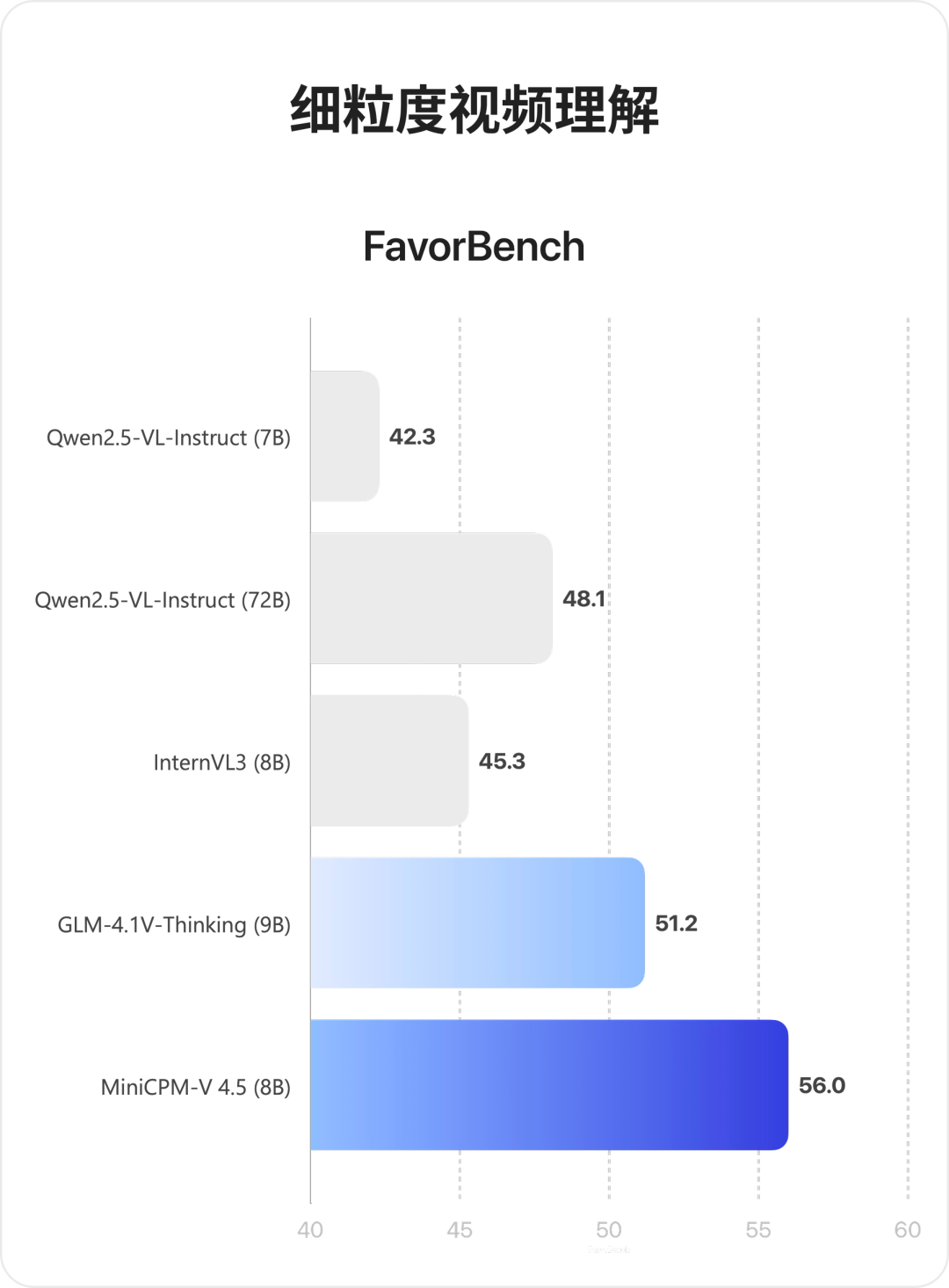

据介绍,MiniCPM-V 4.5在包括高刷视频理解、长视频理解、OCR以及文档解析等多个方面均达到了同级别SOTA(state-of-the-art)水平,甚至在性能上超越了Qwen2.5-VL 72B,堪称“最强端侧多模态模型”。

面壁智能表示,目前主流的多模态模型在处理视频理解任务时,通常会采取1fps的抽帧率,即每秒仅截取1帧画面进行识别和理解,这主要是为了平衡算力和功耗等因素。虽然这种做法在一定程度上保证了模型的推理效率,但也损失了大量的视觉信息,从而降低了多模态大模型对动态世界“精细化”的理解能力。

而MiniCPM-V 4.5作为行业内首个具备高刷视频理解能力的多模态模型,通过将模型结构从2D-Resampler扩展至3D-Resampler,实现了对三维视频片段的高密度压缩。在视觉Token量开销相同的情况下,该模型最大可接收6倍的视频帧数量,达到了96倍的视觉压缩率,是同类模型的12到24倍。

通过大幅增加抽帧频次,MiniCPM-V 4.5得以从过去只能看“PPT”的状态,转变为真正理解“动态画面”。因此,面对转瞬即逝的画面,MiniCPM-V 4.5能够比Gemini-2.5-Pro、GPT-5、GPT-4o等具有代表性的云端模型看得更准、更细致。

在MotionBench、FavorBench这两项主要考察高刷视频理解能力的榜单中,MiniCPM-V 4.5不仅达到了同尺寸SOTA水平,还超越了Qwen2.5-VL 72B,实现了越级领先。

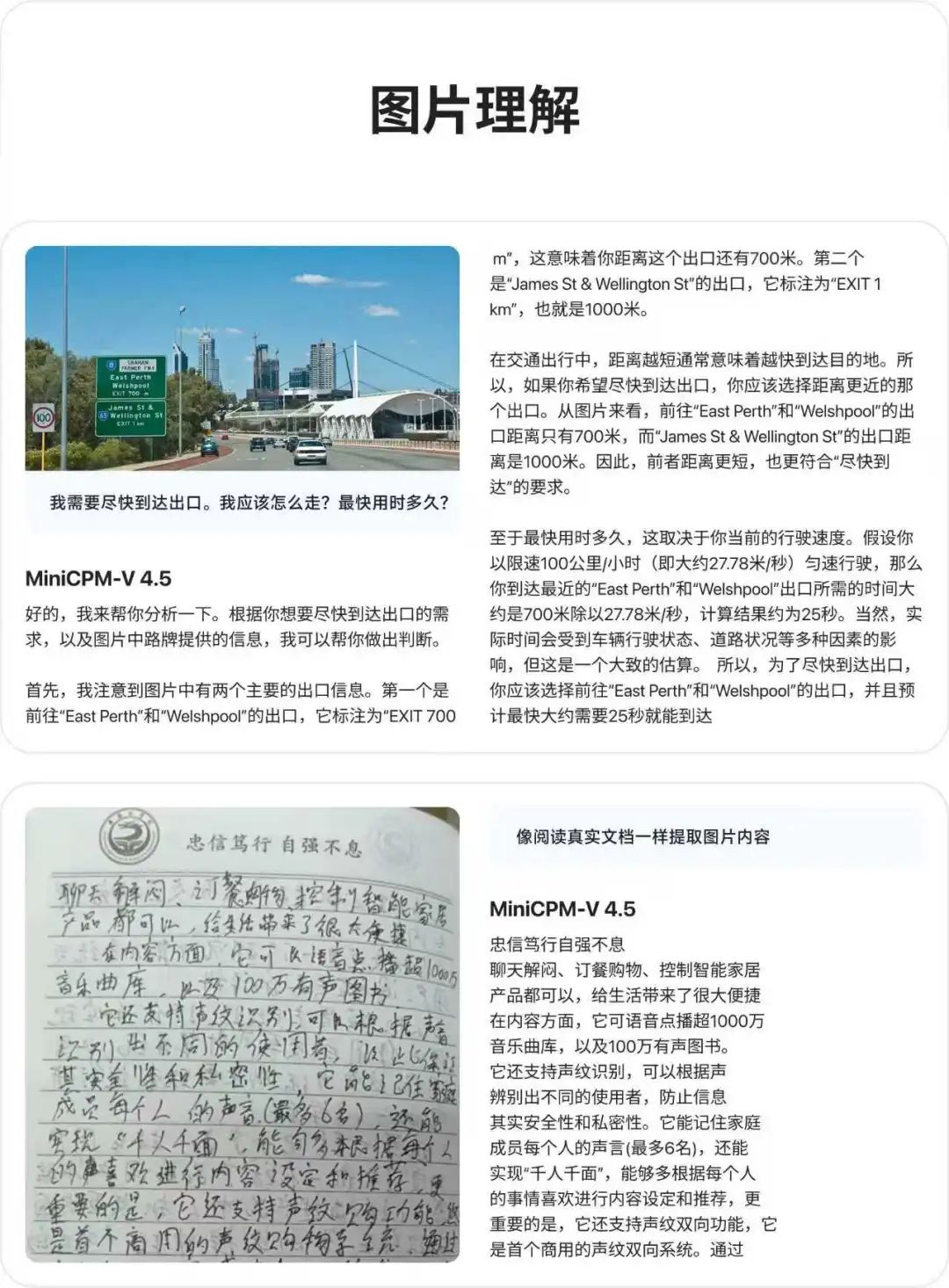

凭借其8B参数,MiniCPM-V 4.5在图片理解、视频理解、复杂文档识别等多模态能力上,再次刷新了能力上限。

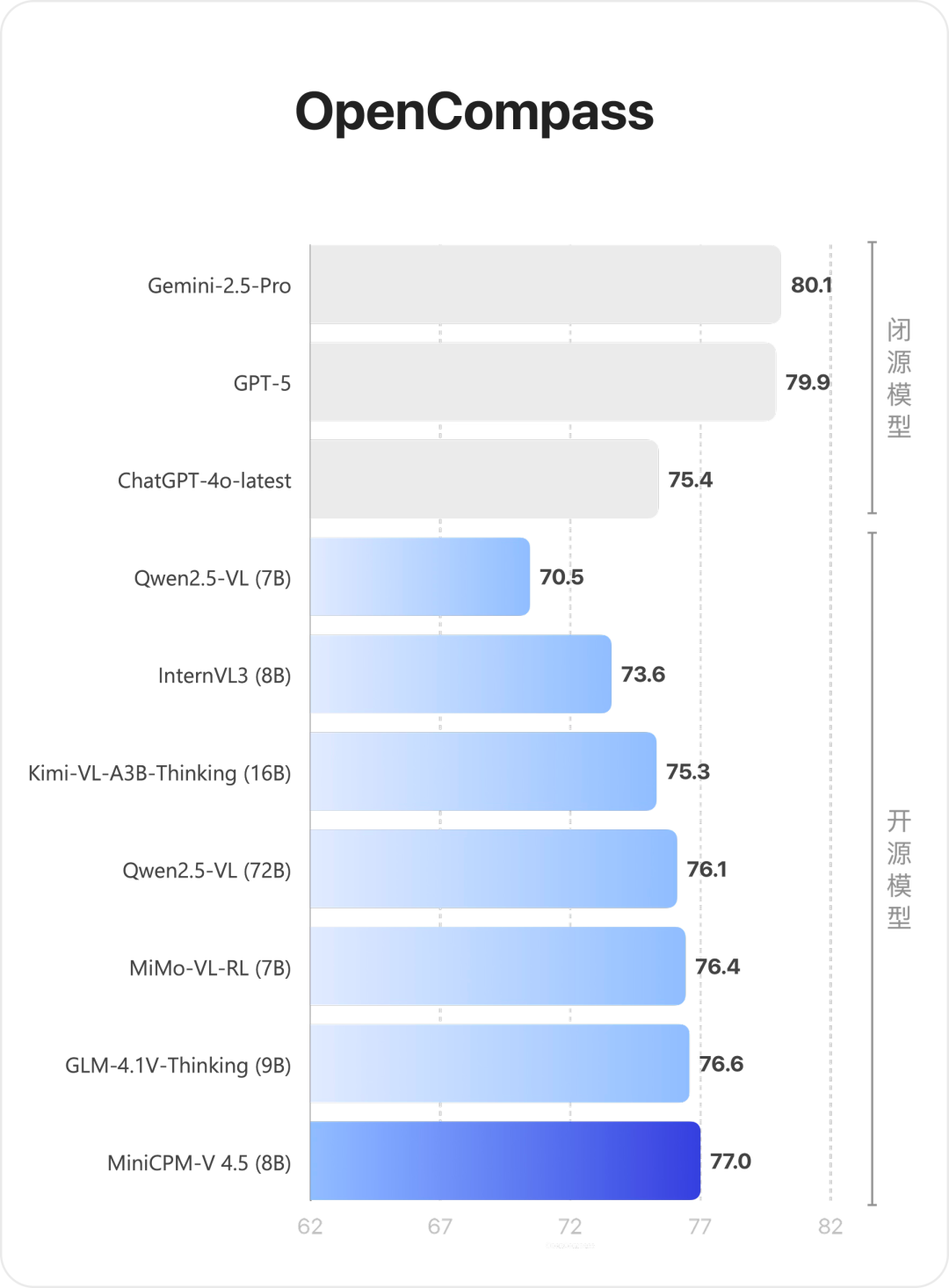

在图片理解性能方面,MiniCPM-V 4.5在OpenCompass测评中,领先于GPT-4o、GPT-4.1、Gemini-2.0-Pro等众多闭源模型,甚至超过了Qwen2.5-VL 72B,实现了越级领先。

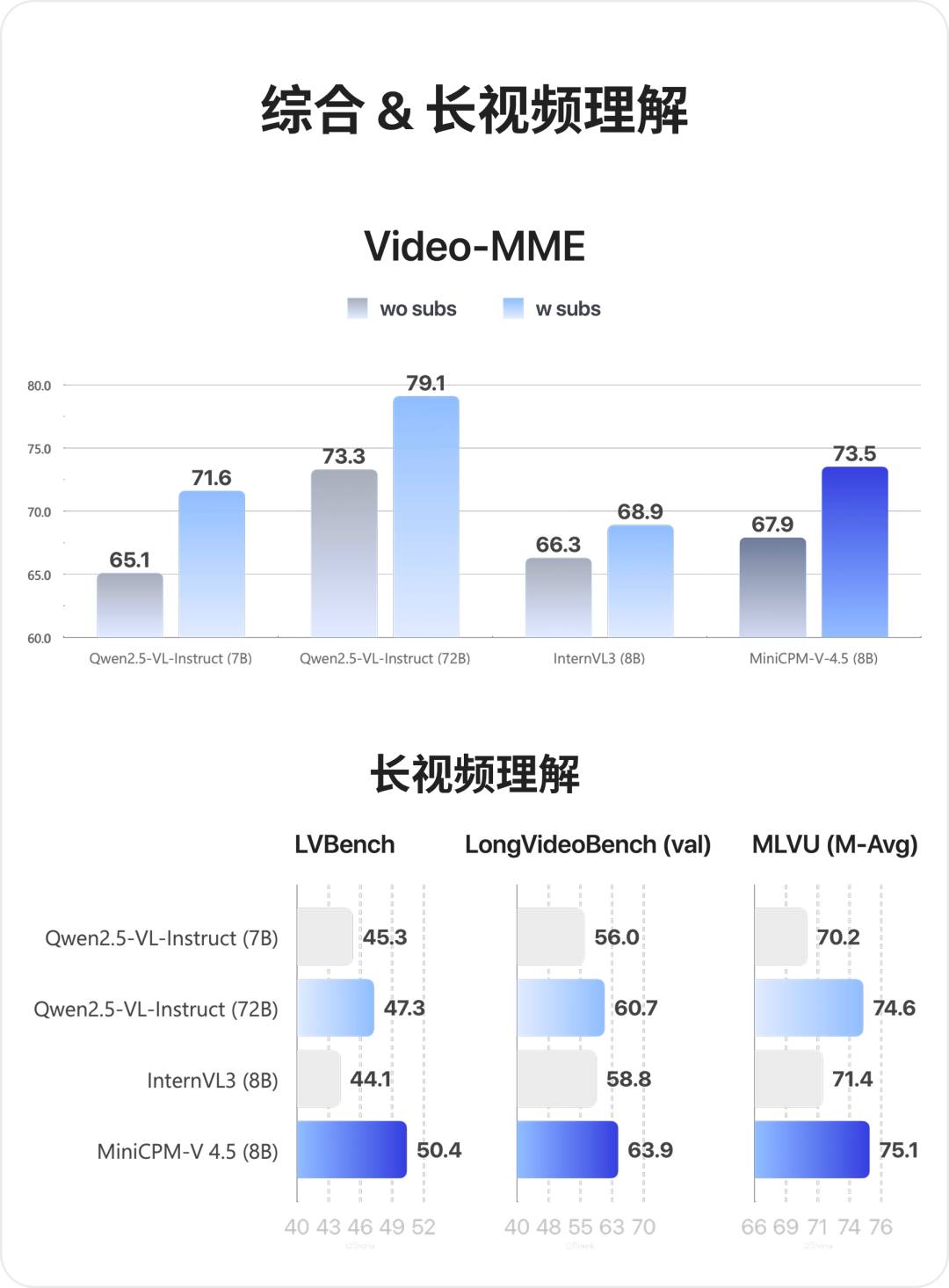

在视频理解性能方面,MiniCPM-V 4.5在LVBench、MLVU、Video-MME、LongVideoBench等榜单中,均达到了同级别最佳水平。

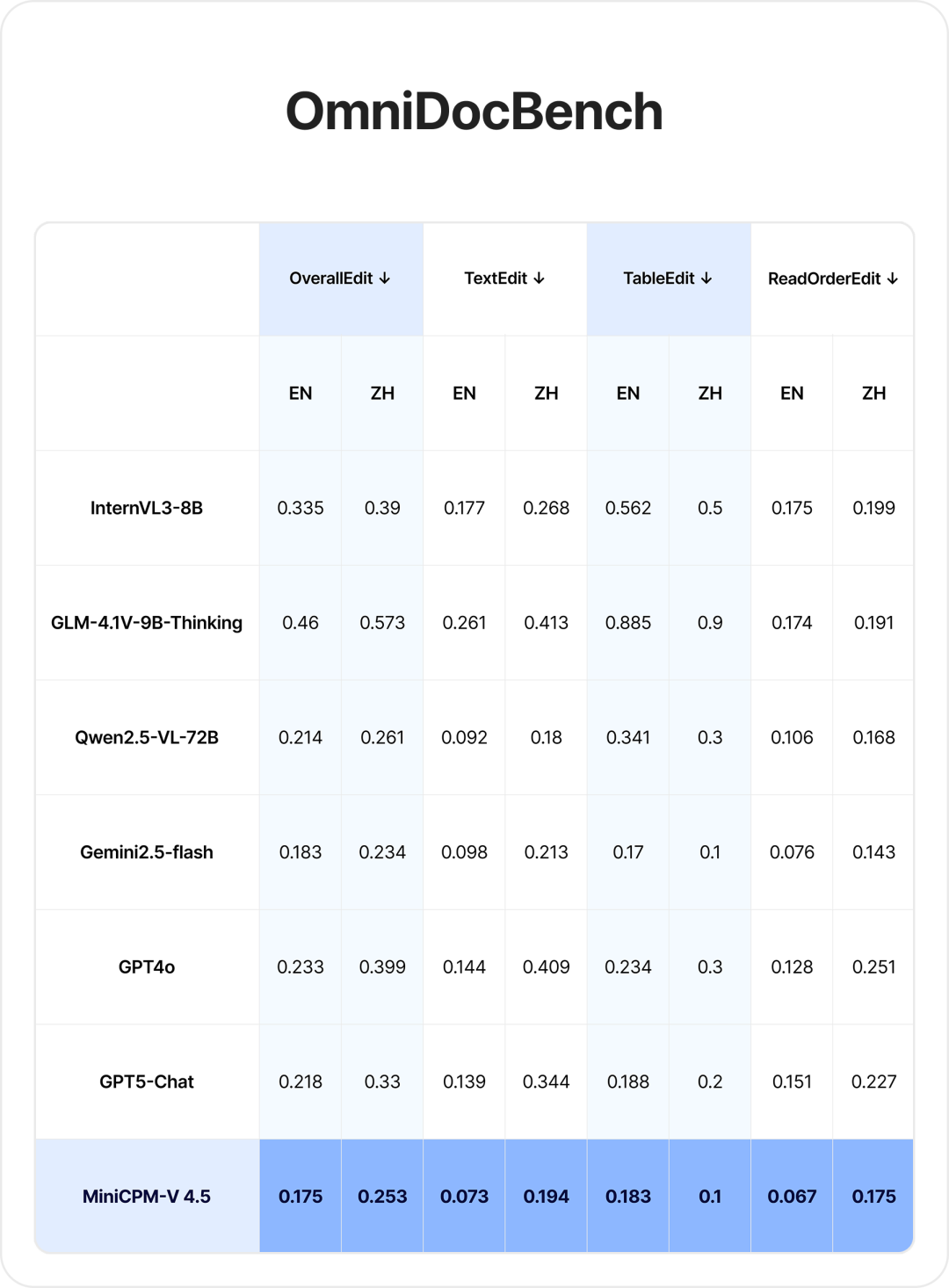

在复杂文档识别任务中,MiniCPM-V 4.5在OmniDocBench榜单的OverallEdit、TextEdit、TableEdit三项指标上,均取得了通用多模态模型同级别的SOTA表现。

值得一提的是,MiniCPM-V 4.5同时支持常规模式和深度思考模式,从而实现了性能与响应速度之间的平衡。其中,常规模式在绝大多数场景下均可提供出色的多模态理解能力,而深度思考模式则专注于应对复杂与复合型推理任务。

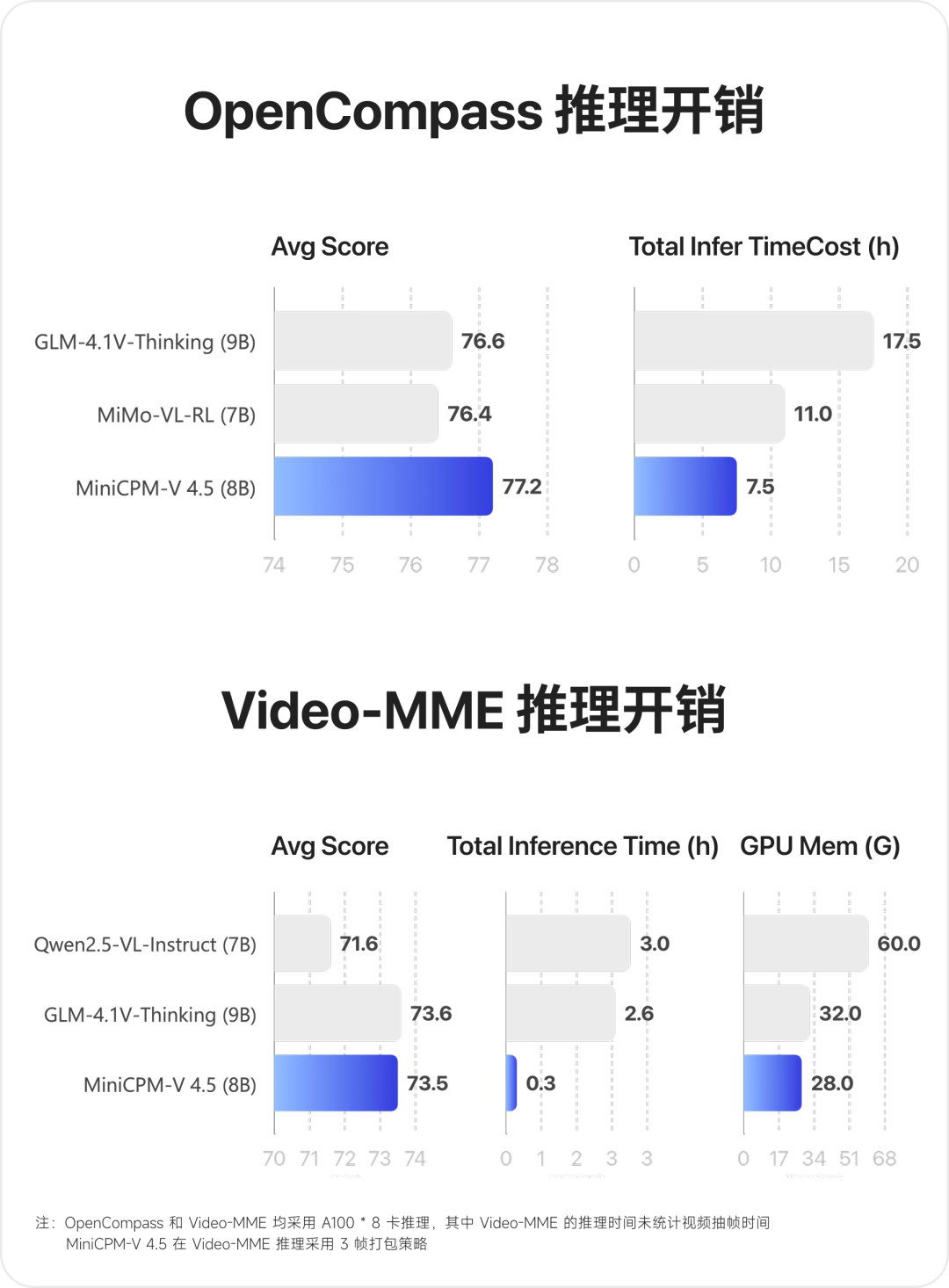

在视频理解榜单VideoMME以及单图OpenCompass测试中,MiniCPM-V 4.5均达到了同级别SOTA水平,并在显存占用、平均推理时间等方面实现了领先。

具体而言,在覆盖短、中、长三种类型的视频理解评测集Video-MME上,MiniCPM-V 4.5采用3帧打包策略进行推理,其时间开销(未计算模型抽帧时间)仅为同级别模型的1/10。

xiayx附模型开源链接:

Github:https://github.com/OpenBMB/MiniCPM-o, Hugging Face:https://huggingface.co/openbmb/MiniCPM-V-4_5, ModelScope:https://www.modelscope.cn/models/OpenBMB/MiniCPM-V-4_5

侠游戏发布此文仅为了传递信息,不代表侠游戏网站认同其观点或证实其描述