Claude УГ»§ЧўТвЈәБДМмјЗВјҪ«ұ»УГУЪ AI СөБ·Ј¬Д¬ИПН¬Тв

АҙФҙЈәithome 2025-08-29 08:30:08xiayx 8ФВ29ИХұЁөАЈ¬Anthropic ҪьИХРыІјЈ¬іэ·ЗУГ»§ГчИ·СЎФсНЛіцЈ¬·сФтҪ«ҝӘКјАыУГУГ»§КэҫЭАҙСөБ·ЖдИЛ№ӨЦЗДЬДЈРНЎЈХвР©КэҫЭ°ьАЁРВөДБДМмјЗВјәНҙъВлұаРҙ»б»°ЎЈУлҙЛН¬КұЈ¬ёГ№«Лҫ»№СУіӨБЛЖдКэҫЭұЈБфХюІЯЦБОеДкЈ¬ХвТ»ХюІЯН¬СщККУГУЪОҙСЎФсНЛіцөДУГ»§ЎЈ

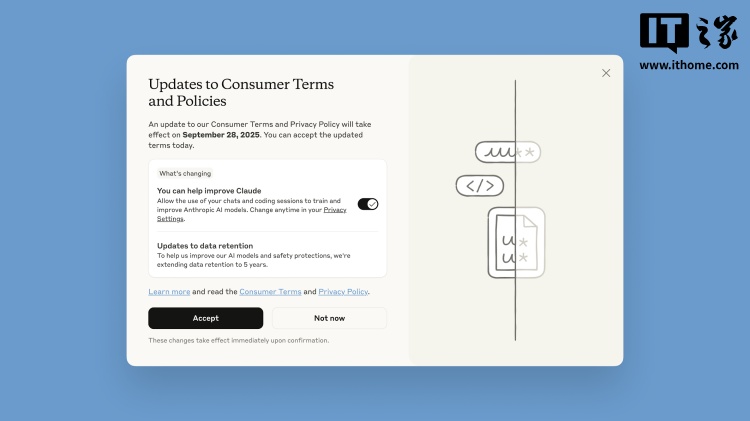

ёщҫЭ Anthropic ЦЬЛД·ўІјөДІ©ҝНОДХВЈ¬ЛщУРУГ»§РиТӘФЪ 9 ФВ 28 ИХЦ®З°ЧціцСЎФсЎЈИз№ыУГ»§ПЦФЪөг»чЎ°ҪУКЬЎұЈ¬Anthropic Ҫ«БўјҙҝӘКјК№УГЖдКэҫЭСөБ·ДЈРНЈ¬ІўҪ«ХвР©КэҫЭЧо¶аұЈБфОеДкЎЈ

ХвПоЙиЦГҪцККУГУЪЎ°РВ·ўЖр»тЦШРВҝӘЖфөДБДМмј°ҙъВлұаРҙ»б»°ЎұЎЈјҙК№КЗН¬Тв Anthropic К№УГЖдКэҫЭСөБ·ДЈРНөДУГ»§Ј¬ёГ№«ЛҫТІІ»»бҪ«УГ»§ОҙЦШРВҝӘЖфөДАъК·БДМм»тҙъВл»б»°ДЙИлСөБ··¶О§ЎЈІ»№эЈ¬Т»ө©УГ»§јМРшК№УГДі¶ОҫЙ»б»°Ј¬Па№ШКэҫЭҫН»бұ»ДЙИлСөБ·ЎЈ

Anthropic ФЪОДЦРГчИ·ЦёіцЈ¬ҙЛҙОёьРВёІёЗБЛ Claude ГжПтПы·СХЯөДЛщУР¶©ФДІгј¶Ј¬°ьАЁ Claude Гв·С°жЎўЧЁТө°жЈЁProЈ©ТФј°ёЯј¶°жЈЁMaxЈ©Ј¬Ў°УГ»§НЁ№эЙПКц¶©ФДХЛ»§К№УГ Claude Code КұН¬СщККУГЎұЎЈІ»№эЈ¬ёГёьРВІ»ККУГУЪ Anthropic өДЙМТөУГНҫІгј¶Ј¬АэИз Claude Хюё®°жЈЁClaude GovЈ©ЎўЖуТө°жЈЁClaude for WorkЈ©ЎўҪМУэ°жЈЁClaude for EducationЈ©Ј¬ТІІ»ККУГУЪ API өчУГіЎҫ°Ј¬Ў°°ьАЁНЁ№эСЗВнС· BedrockЎў№ИёиФЖ Vertex AI өИөЪИэ·ҪЖҪМЁҪшРРөД API К№УГЎұЎЈ

РВУГ»§РиТӘФЪ Claude ЧўІбБчіМЦРСЎФсЖ«әГЙиЦГЎЈ¶шПЦУРУГ»§ФтРиТӘНЁ№эөҜҙ°И·ИПСЎФсЈ¬ҝЙТФСЎФсөг»чЎ°ФЭІ»ЙиЦГЎұ°ҙЕҘСУәуҫц¶ЁЈ¬ө«ұШРлФЪ 9 ФВ 28 ИХЗ°НкіЙСЎФсЎЈ

ЦөөГЧўТвөДКЗЈ¬әЬ¶аУГ»§ҝЙДЬГ»УРЧРПёФД¶БМхҝоДЪИЭЈ¬ҫНҝмЛЩөг»чБЛЎ°ҪУКЬЎұЎЈУГ»§ҝҙөҪөДөҜҙ°ЦРЈ¬ҙуәЕЧЦМеПФКҫЧЕЎ°Пы·СХЯМхҝој°ХюІЯёьРВЎұЈ¬ПВ·ҪОДЧЦЛөГчОӘЎ°ОТГЗөДПы·СХЯМхҝоУлТюЛҪХюІЯёьРВҪ«УЪ 2025 Дк 9 ФВ 28 ИХЙъР§Ј¬ДъҝЙҪсИХҪУКЬёьРВәуөДМхҝоЎұЈ¬өҜҙ°өЧІҝЙиУРТ»ёцРСДҝөДәЪЙ«Ў°ҪУКЬЎұ°ҙЕҘЎЈ

xiayx ·ўПЦЈ¬ФЪёГ°ҙЕҘПВ·ҪөДРЎЧЦІҝ·ЦЈ¬УРјёРРОДЧЦРҙЧЕЎ°ФКРнК№УГДъөДБДМмјЗВјј°ҙъВлұаРҙ»б»°Ј¬УГУЪСөБ·әНёДҪш Anthropic AI ДЈРНЎұЈ¬ЕФұЯ»№ЕдУРТ»ёцҝӘЖф / №ШұХЗР»»ҝӘ№ШЈ¬ІўЗТД¬ИПҙҰУЪЎ°ҝӘЖфЎұЧҙМ¬ЎЈПФИ»Ј¬јҙК№Г»УРФД¶БМхҝоЈ¬әЬ¶аУГ»§ТІ»бЦұҪУөг»чҙуәЕөДЎ°ҪУКЬЎұ°ҙЕҘЈ¬¶шІ»»бЧўТвөҪөчХыёГЗР»»ҝӘ№ШЎЈ

Из№ыУГ»§ПЈНыСЎФсНЛіцЈ¬ҝЙТФФЪҝҙөҪөҜҙ°КұҪ«ЗР»»ҝӘ№ШөчЦБЎ°№ШұХЎұЧҙМ¬ЎЈИз№ыТСҫӯІ»РЎРДөг»чБЛЎ°ҪУКЬЎұІўПЈНыёьёДЈ¬ҝЙТФҪшИлёцИЛЙиЦГЈЁSettingsЈ©Ј¬СЎФсТюЛҪұкЗ©ТіЈЁPrivacyЈ©Ј¬ҪшИлТюЛҪЙиЦГ°еҝйЈЁPrivacy SettingsЈ©Ј¬ЧоәуФЪЎ°°пЦъёДҪш ClaudeЎұСЎПоПВҪ«ҝӘ№ШөчЦБЎ°№ШұХЎұЎЈПы·СХЯҝЙТФЛжКұНЁ№эТюЛҪЙиЦГёьёДСЎФсЈ¬ө«РиТӘЧўТвөДКЗЈ¬РВөДЙиЦГҪц¶ФОҙАҙІъЙъөДКэҫЭЙъР§ ЎӘЎӘ ТСҫӯУГУЪДЈРНСөБ·өДКэҫЭҪ«ОЮ·Ёі·»ШЎЈ

Anthropic ФЪІ©ҝНЦРұнКҫЈәЎ°ОӘБЛұЈ»ӨУГ»§ТюЛҪЈ¬ОТГЗҪ«ҪбәП¶аЦЦ№ӨҫЯУлЧФ¶Ҝ»ҜБчіМЈ¬¶ФГфёРКэҫЭҪшРР№эВЛ»тДЈәэҙҰАнЎЈОТГЗІ»»бПтөЪИэ·ҪіцКЫУГ»§КэҫЭЎЈЎұ

ПАУОП··ўІјҙЛОДҪцОӘБЛҙ«өЭРЕПўЈ¬І»ҙъұнПАУОП·НшХҫИПН¬Жд№Ыөг»тЦӨКөЖдГиКц

Н¬АаёьРВ

ёь¶аИИУОНЖјц

ёь¶а-

- ГьФЛЖпКҝНЕ

- Android/ | ҪЗЙ«°зСЭ

- 2026-03-30

-

-

-

-

-

- Ч№РЗҙуВҪ Вт¶П°ж

- Android/ | ҪЗЙ«°зСЭ

- 2026-03-30

-

-

- ҫЮҙуДпөДНжЛЈ

- Android/ | РЭПРТжЦЗ

- 2026-03-30

- ПжICPұё14008430әЕ-1 П湫Нш°Іұё 43070302000280әЕ

- All Rights Reserved

- ұҫХҫОӘ·ЗУҜАыНшХҫЈ¬І»ҪУКЬИОәО№гёжЎЈұҫХҫЛщУРИнјюЈ¬¶јУЙНшУС

- ЙПҙ«Ј¬ИзУРЗЦ·ёДгөД°жИЁЈ¬Зл·ўУКјюёшxiayx666@163.com

- өЦЦЖІ»БјЙ«ЗйЎў·ҙ¶ҜЎўұ©БҰУОП·ЎЈЧўТвЧФОТұЈ»ӨЈ¬Ҫч·АКЬЖӯЙПөұЎЈ

- КК¶ИУОП·ТжДФЈ¬іБГФУОП·ЙЛЙнЎЈәПАн°ІЕЕКұјдЈ¬ПнКЬҪЎҝөЙъ»оЎЈ