AI“以小博大”新标杆:三星开源 TRM 模型,700 万参数、特定任务性能媲美 Deepseek R1 等万倍大模型

来源:ithome 2025-10-10 15:00:13xiayx 10月10日消息,科技媒体 venturebeat 于 10 月 8 日发布博文,报道称三星高级 AI 研究院发布了名为微型递归模型(TRM)的开源 AI 模型,仅包含 700 万个参数,不过在数独、迷宫等特定的结构化推理任务上,表现媲美甚至超越了参数量为其 10000 倍的谷歌 Gemini 2.5 Pro 等顶尖大模型。

该 AI 模型由三星高级 AI 研究院(SAIT)高级 AI 研究员 Alexia Jolicoeur-Martineau 发布,成为 AI 领域“小模型”对抗“大模型”的趋势的重磅新案例。

该模型仅有 700 万参数,设计理念是极致简化复杂性。在架构方面,摒弃了分层推理模型(HRM)所依赖的双网络协作架构,转而采用一个仅有两层的单一模型。

其核心机制在于“递归推理”:模型对自身输出的预测进行反复迭代和修正,每一步都纠正前一步的潜在错误,直至答案收敛稳定。

TRM 通过这种方式,用迭代计算的深度模拟了庞大网络的复杂推理过程,实现了“以递归替代规模”的目标,从而在不牺牲性能的前提下,大幅降低了计算和内存成本。

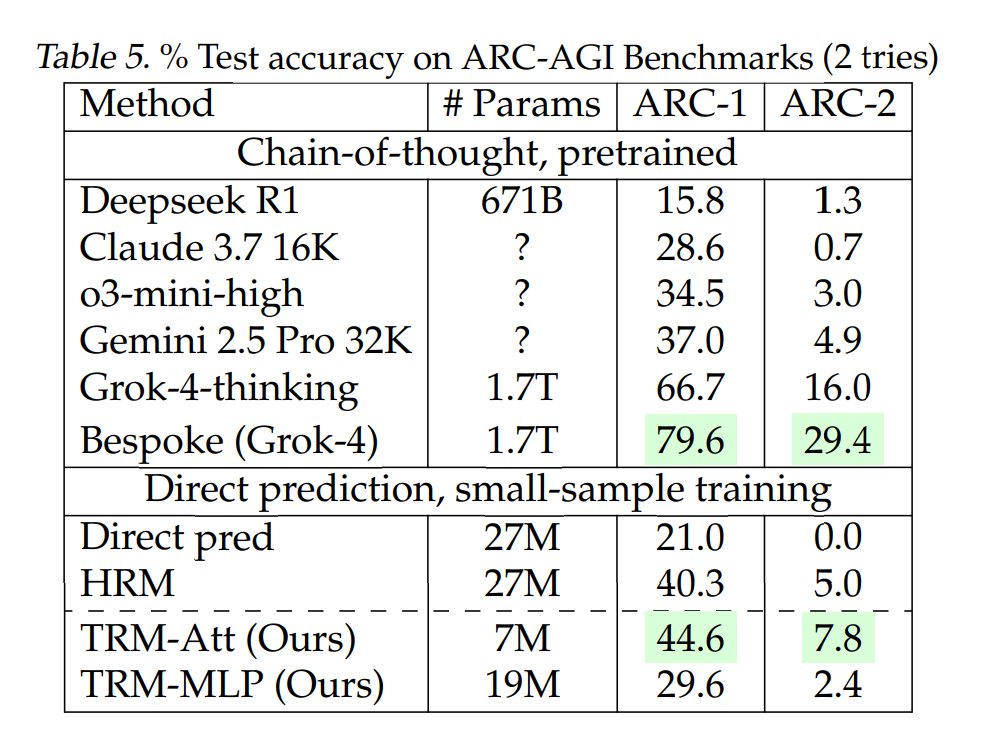

尽管模型极小,TRM 在多个基准测试中展现了“以小博大”的惊人实力:

在 Sudoku-Extreme(极限数独)测试中,其准确率达到 87.4%;

在 Maze-Hard(困难迷宫)中达到 85%;

在衡量抽象推理能力的 ARC-AGI 测试中准确率为 45%;

ARC-AGI-2 的准确率为 8%。

尽管 TRM 使用的参数不到 0.01%,但这些结果仍然超过或接近几种高端大型语言模型的性能,包括 DeepSeek R1 、 Gemini 2.5 Pro 和 o3-mini 。

然而,一个重要的前提是,TRM 是专门为解决结构化、可视化的网格类问题(如数独、迷宫和特定解谜任务)而设计的,并非通用的语言聊天模型,它擅长在有明确规则的封闭环境中进行逻辑推理,而非开放式的语言生成。

TRM 的成功源于其刻意追求的“少即是多”极简主义设计。研究发现,增加模型层数或大小反而会导致在小数据集上出现过拟合,性能下降。其精简的双层结构与递归深度相结合,实现了最佳效果。

TRM 的代码、训练脚本和数据集目前已在 GitHub 上根据 MIT 许可证完全开源,企业和研究人员均可免费使用、修改和部署,甚至用于商业应用。

xiayx附上参考地址

GitHub

Less is More: Recursive Reasoning with Tiny Networks

侠游戏发布此文仅为了传递信息,不代表侠游戏网站认同其观点或证实其描述