宝可梦游戏成AI智能新标尺:多机构用其实测大模型推理、规划与适应能力

来源:牛奶秋刀鱼 2026-01-26 11:43:40

当前,衡量人工智能能力的方式日益多元,各类基准测试与评估体系层出不穷。在众多方法之中,一种别具特色的方式正悄然兴起——让大模型实际运行并操控经典电子游戏宝可梦系列,以此检验其综合智能水平。

长期稳定更新的攒劲资源: >>>点此立即查看<<<

包括谷歌、OpenAI与Anthropic在内的多家前沿人工智能研发机构,已将这一实践纳入内部技术评估流程。他们调用各自最新一代语言模型,在宝可梦的复杂世界中执行任务、应对变化、制定策略,从而观测模型在真实交互场景中的表现。

Anthropic公司AI技术负责人戴维·赫西指出,宝可梦不同于弹球等早期简易游戏,其规则体系庞大、状态空间高度开放、决策路径非线性且充满不确定性,对人工智能而言构成一项兼具广度与深度的挑战。正因如此,该游戏逐渐成为检验模型认知能力、规划能力与适应能力的理想沙盒。

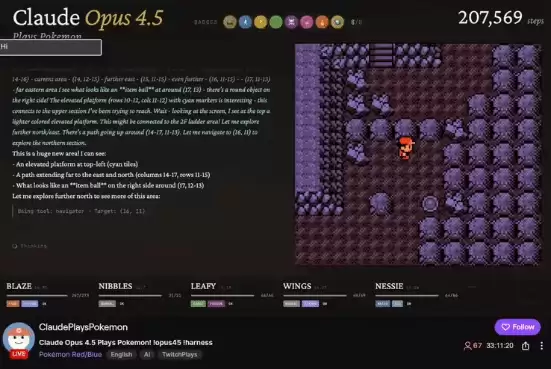

自2025年初起,赫西持续在流媒体平台开展直播,每日使用公司自主研发的Claude模型操作宝可梦游戏。他的日常工作聚焦于协助客户完成AI系统部署,而这场长期直播,实则是将模型置于高强度、长周期、多变量的真实任务中进行压力测试。

这一尝试很快引发开发者社群的广泛响应。不少独立研究者相继启动类似项目,例如基于Gemini与GPT系列模型的游戏实机运行直播。随着关注度提升,相关实践也吸引了核心研发团队的关注与参与。在工程师实时介入调优下,Gemini与GPT模型已成功完成宝可梦蓝全流程通关;Claude则仍在多个关键节点持续优化中。

选择宝可梦作为评估载体,核心在于其天然具备可观测性与可度量性:一方面,游戏进程提供清晰的时间轴与事件序列,便于追踪模型每一步判断的依据与后果;另一方面,胜负结果、通关耗时、资源利用率、队伍构建合理性等维度均可转化为量化指标,支撑横向对比与纵向迭代。

在游戏进程中,玩家需持续完成经验积累、属性培养、战术匹配、对手预判、资源分配等一系列操作。每一环节都嵌套着多重条件判断与长期目标权衡——例如,是优先挑战高难度训练家以获取稀有宝可梦,还是循序渐进打磨整体战力结构?这类决策没有标准答案,却深刻反映逻辑推演、风险预估与跨阶段规划能力。

研究人员由此得以深入解析模型在动态环境中的行为模式,识别其推理链条中的薄弱环节与优势特征,进而厘清能力边界。与此同时,赫西也将这些实战数据反馈至客户应用场景,用于优化指令控制框架、提升计算资源调度效率,推动模型在真实业务负载下实现更稳定、更高效的运行表现。

侠游戏发布此文仅为了传递信息,不代表侠游戏网站认同其观点或证实其描述