NginxШежОжаЕФГЌЪБЮЪЬтдѕУДНтОі

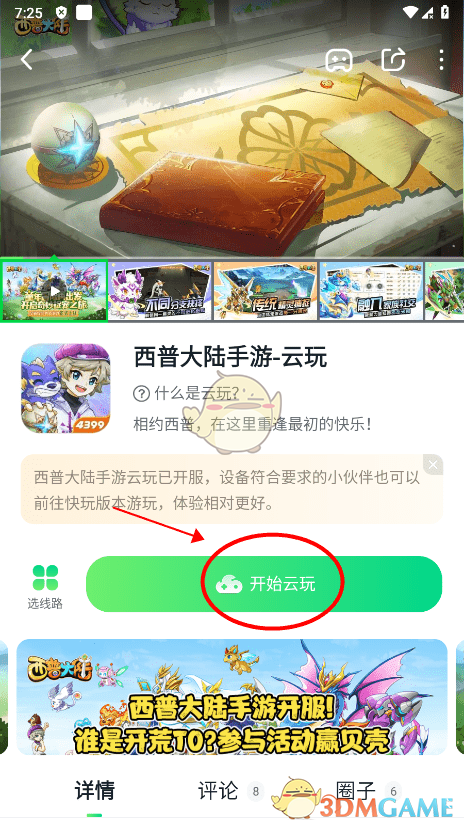

РДдДЃКЛЅСЊЭј 2026-03-10 15:59:02NginxШежОжаЕФГЌЪБЮЪЬтПЩФмгЩЖржждвђв§Ц№ЃЌвдЯТЪЧвЛаЉГЃМћЕФХХВщВНжшКЭНтОіЗНЗЈЃКХХВщВНжшМьВщNginxХфжУЮФМўЃКВщПДNginxЕФХфжУЮФМўЃЌЬиБ№ЪЧгыГЌЪБЯрЙиЕФХфжУЯюЃЌШчkeepalive_timeoutЁЂsend_timeoutЁЂproxy_read_timeoutЕШЁЃЗжЮіNginxШежОЃКМьВщNginxЕФДэЮѓШежОЃЈЭЈГЃЮЛгк/var/log/nginx/error.logЃЉЃЌВщевгыГЌЪБЯрЙиЕФДэЮѓаХЯЂЁЃЪЙгУtail -f /var/log/nginx/error.logЪЕЪБМрПиШежОЃЌвдБуМАЪБЗЂЯжЮЪЬтЁЃЭјТчеяЖЯ

НтОіNginxШежОжаЕФГЌЪБЮЪЬтЃКвЛЮЛдЫЮЌРЯБјЕФЪЕеНжИФЯ

ВЛжЊЕРФугаУЛгагіЕНЙ§етжжЧщПіЃКМрПиИцОЏЭЛШЛЯьСЫЃЌЬсЪОЗўЮёЯьгІГЌЪБЃЌвЛЭЗдњНјNginxШежОРяШДЯёПДЬьЪщЃПБ№ЕЃаФЃЌетЪТЖљЮвДІРэЙ§ЬЋЖрДЮСЫЁЃNginxШежОРяЕФГЌЪБЬсЪОЃЌБэУцЩЯПДЖМВюВЛЖрЃЌЕЋБГКѓЕФдвђПЩФмЮхЛЈАЫУХЁЃНёЬьЃЌЮвОЭАбздМКетаЉФъХХВщетРрЮЪЬтЕФЫМТЗКЭВНжшЃЌЯЕЭГЕиЪсРэИјФуЃЌЯЃЭћФмАяФуЩйзпаЉЭфТЗЁЃ

дкЮвПДРДЃЌХХВщГЌЪБЮЪЬтОЭЯёвНЩњПДВЁЃЌЕУНВОПЁАЭћЮХЮЪЧаЁБЁЃФуЕУДгПЭЛЇЖЫЕФЬхбщГіЗЂЃЌбизХЧыЧѓТЗОЖВуВуЛиЫнЃЌДгNginxХфжУЁЂЭјТчСДТЗвЛжБВщЕНКѓЖЫЗўЮёКЭЗўЮёЦїзЪдДЃЌетбљВХФмЖЈЮЛЕНеце§ЕФВЁдюЁЃ

ХХВщВНжшЃКвЛЬзВуВуЕнНјЕФеяЖЯСїГЬ

-

ЯШФУNginxХфжУЁАПЊЕЖЁБ

- етЪЧзюжБНгЕФвЛВНЁЃЮвЕФЯАЙпЪЧЃЌЯШДђПЊNginxЕФХфжУЮФМўЃЌАбМИИіЙиМќЕФГЌЪБВЮЪ§ДгЭЗЕНЮВолвЛБщЁЃФужиЕувЊЙизЂЕФЪЧ

keepalive_timeoutЁЂsend_timeoutЃЌЛЙгазіЗДЯђДњРэЪБжСЙиживЊЕФproxy_read_timeoutКЭproxy_connect_timeoutЁЃКмЖрЪБКђЃЌЮЪЬтОЭГідкЖдетаЉЪБМфЕФЕЭЙРЩЯЁЃ

- етЪЧзюжБНгЕФвЛВНЁЃЮвЕФЯАЙпЪЧЃЌЯШДђПЊNginxЕФХфжУЮФМўЃЌАбМИИіЙиМќЕФГЌЪБВЮЪ§ДгЭЗЕНЮВолвЛБщЁЃФужиЕувЊЙизЂЕФЪЧ

-

ШУШежОЁАЫЕЛАЁБ

- ХфжУЮФМўУЛЮЪЬтЃПФЧЮвУЧЕУЬ§Ь§NginxздМКЪЧдѕУДЁАЫпПрЁБЕФЁЃжБНгШЅЗДэЮѓШежОЃЈЭЈГЃОЭдк

/var/log/nginx/error.logЃЉЃЌетРяУцОГЃВизХБЈДэЕФОЋШЗЪБМфКЭЩЯЯТЮФЃЌБШЗУЮЪШежОЕФаХЯЂСПДѓЕУЖрЁЃЮвЬиБ№ЯВЛЖгУtail -fетИіУќСюРДЪЕЪБМрПиШежОЃЌгШЦфЪЧдкИДЯжЮЪЬтЕФЪБКђЃЌЖЏЬЌПДзХДэЮѓБФГіРДЃЌИаОѕОЭЯёЪЧКЭЮЪЬтдкЁАЪЕЪБЖдЛАЁБЁЃ

- ХфжУЮФМўУЛЮЪЬтЃПФЧЮвУЧЕУЬ§Ь§NginxздМКЪЧдѕУДЁАЫпПрЁБЕФЁЃжБНгШЅЗДэЮѓШежОЃЈЭЈГЃОЭдк

-

ЪЧЭјТчдкЁАЕЗЙэЁБТ№ЃП

- ЛАЫЕЛиРДЃЌКмЖрГЌЪБЦфЪЕбЙИљВЛЪЧNginxЛђгІгУЕФЙјЃЌЖјЪЧЭјТчВЛЮШдьГЩЕФЁЃетЪБКђЃЌ

pingКЭtracerouteЃЈЛђепmtrЃЉОЭЪЧФуЕФРЯХѓгбСЫЃЌЫќУЧФмАяФуПьЫйПДЧхПЭЛЇЖЫЕНЗўЮёЦїжЎМфЕФСДТЗгаУЛгаЖЊАќКЭИпбгГйЁЃСэЭтЃЌгУnetstatЛђИќЯжДњЕФssУќСюГђвЛблСЌНгзДЬЌЃЌПДПДгаУЛгавЛДѓЖбTIME_WAITЛђепСЌНгПЈдкЦцЙжЕФзДЬЌЃЌвВЗЧГЃФмЫЕУїЮЪЬтЁЃ

- ЛАЫЕЛиРДЃЌКмЖрГЌЪБЦфЪЕбЙИљВЛЪЧNginxЛђгІгУЕФЙјЃЌЖјЪЧЭјТчВЛЮШдьГЩЕФЁЃетЪБКђЃЌ

-

ИјЗўЮёЦїзіИіЁАЬхМьЁБ

- ШчЙћЭјТчвВЭЈГЉЃЌФЧбЙСІОЭРДЕНЗўЮёЦїетБпСЫЁЃФуЕУгУ

topЛђhtopПДПДCPUЪЧВЛЪЧЩеЕН100%СЫЃЌФкДцЪЧВЛЪЧБЛГдЙтСЫЃЌЛђепгУiotopМьВщДХХЬI/OЪЧВЛЪЧГЩСЫЦПОБЁЃгаЪБКђЃЌвЛаЉНјГЬЛсвђЮЊЕШД§ФГИіЯЕЭГзЪдДЖјБЛЁАЙвЦ№ЁБЃЌетЪБКђstraceетИіЩёЦїОЭФмХЩЩЯгУГЁЃЌЫќФмИњзйНјГЬЕФЯЕЭГЕїгУЃЌШУФуПДЕНЕзЪЧПЈдкСЫФФвЛВНЁЃ

- ШчЙћЭјТчвВЭЈГЉЃЌФЧбЙСІОЭРДЕНЗўЮёЦїетБпСЫЁЃФуЕУгУ

-

ЭИЪгКѓЖЫгІгУЕФЁАФкРяЁБ

- зюКѓЃЌШчЙћNginxжЛЪЧИіЁАДЋЛАЁБЕФЗДЯђДњРэЃЌФЧеце§ЕФЦПОБКмПЩФмдкКѓЖЫЁЃФуашвЊМьВщКѓЖЫгІгУЃЈБШШчTomcatЁЂPHP-FPMЛђвЛИіGoЗўЮёЃЉЕФДІРэТпМЃКЪЧВЛЪЧгаSQLВщбЏУЛМгЫїв§ЃПЪЧВЛЪЧдкЭЌВНЕїгУвЛИіМЋТ§ЕФЭтВПAPIЃПЛђепЃЌгаУЛгаЪВУДДѓЮФМўЩЯДЋЯТдиАбЯпГЬГиеМТњСЫЃПетвЛВНЭЈГЃашвЊКЭгІгУПЊЗЂЭЌбЇНєУмазїЁЃ

НтОіЗНЗЈЃКЖджЂЯТвЉЃЌвЉЕНВЁГ§

-

ЕїВЮЃКИјNginxЖрвЛЕуФЭаФ

- ИљОнХХВщНсЙћЃЌШчЙћШЗШЯЪЧКѓЖЫДІРэШЗЪЕашвЊИќГЄЪБМфЃЌЪЪЕБЕїДѓГЌЪБВЮЪ§ЪЧзюжБНгЕФНтОіЗНАИЁЃБШШчЃЌНЋ

proxy_read_timeoutКЭproxy_send_timeoutДгФЌШЯЕФ60УыЬсИпЕН300УыЁЃВЛЙ§етРяЮвЕУЬсИіабЃЌетИіжЕВЛЪЧдНДѓдНКУЃЌЩшЕУЬЋДѓПЩФмЛс hide зЁКѓЖЫеце§ЕФадФмЮЪЬтЃЌВЂЧвеМгУСЌНгзЪдДЁЃ

# дк location Лђ server ПщжаЕїећ proxy_read_timeout 300s; proxy_send_timeout 300s; - ИљОнХХВщНсЙћЃЌШчЙћШЗШЯЪЧКѓЖЫДІРэШЗЪЕашвЊИќГЄЪБМфЃЌЪЪЕБЕїДѓГЌЪБВЮЪ§ЪЧзюжБНгЕФНтОіЗНАИЁЃБШШчЃЌНЋ

-

гХЛЏЃКИјКѓЖЫЗўЮёЁАМѕИКЁБ

- ШчЙћЪЧКѓЖЫЗўЮёздЩэТ§ЃЌФЧОЭвЊПМТЧгХЛЏСЫЁЃв§ШыЛКДцЃЈБШШчRedisЃЉРДМѕЩйЖдЪ§ОнПтЕФжиИДВщбЏЃЌЖдКФЪБЕФВйзїНјаавьВНЛЏДІРэЃЌЛђепгХЛЏЫуЗЈИДдгЖШЃЌетаЉЖМЪЧжЮБОЕФЗНЗЈЁЃЬЙАзНВЃЌгХЛЏКѓЖЫДјРДЕФадФмЬсЩ§ЃЌЭљЭљБШЕЅДПЕїДѓNginxГЌЪБЪБМфвЊгааЇКЭГжОУЕУЖрЁЃ

-

ЪшЭЈЃКгХЛЏЭјТчТЗОЖ

- ЖдгкЭјТчЮЪЬтЃЌПЩвдМьВщвЛЯТжаМфСДТЗЕФЗРЛ№ЧНЁЂАВШЋзщЙцдђЃЌШЗБЃЖЫПкЪЧЭЈЕФЁЃШчЙћгУЛЇЗжВМКмЙуЃЌНгШывЛИіППЦзЕФCDNРДМгЫйОВЬЌзЪдДЃЌВЂгУИКдиОљКтАбСїСПЗжЩЂЕНЖрИіКѓЖЫНкЕуЃЌФмМЋДѓЕиЛКНтвђЕЅЕуЛђдЖОрРыЗУЮЪДјРДЕФГЌЪБЮЪЬтЁЃ

-

РЉШнЃКИјЗўЮёЦїЁАМгМІЭШЁБ

- ШчЙћОЙ§МрПиШЗШЯЃЌОЭЪЧЕЅДПЕФCPUЁЂФкДцЛђДХХЬI/OзЪдДВЛЙЛгУСЫЃЌФЧУДзюЦгЫивВЪЧзюгааЇЕФАьЗЈОЭЪЧЩ§МЖгВМўХфжУЃЌЛђепНјааЫЎЦНРЉШнЁЃетвЛЕуЗЧГЃЪЕдкЃЌдквЕЮёПьЫйдіГЄЦкгШЦфГЃМћЁЃ

ЦфЪЕФуПДЃЌДІРэNginxГЌЪБЮЪЬтЃЌОЭЪЧвЛИіДгЯжЯѓЕНБОжЪЃЌДгЭтЮЇЕНКЫаФЕФЯЕЭГадЙЄГЬЁЃЙиМќВЛдкгкМЧзЁФГИіУќСюЛђВЮЪ§ЃЌЖјдкгкНЈСЂвЛЬзЧхЮњЕФХХВщТпМЁЃИљОнЪЕМЪЧщПіЃЌСщЛюзщКЯдЫгУЩЯУцЕФВНжшКЭЗНЗЈЃЌФуОЭФмАбОјДѓЖрЪ§ГЌЪБЮЪЬтИуЖЈЃЌШУNginxЕФадФмКЭЮШЖЈадИќЩЯвЛВуТЅЁЃЯЃЭћетаЉОбщжЎЬИЃЌФмГЩЮЊФуЙЄОпЯфРяЕФвЛМўЕУСІЮфЦїЁЃ

ЯРгЮЯЗЗЂВМДЫЮФНіЮЊСЫДЋЕнаХЯЂЃЌВЛДњБэЯРгЮЯЗЭјеОШЯЭЌЦфЙлЕуЛђжЄЪЕЦфУшЪі

ЭЌРрИќаТ

ИќЖрШШгЮЭЦМі

ИќЖр-

- УќдЫЦяЪПЭХ

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

-

-

-

-

- зЙаЧДѓТН ТђЖЯАц

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

-

- ОоДѓФяЕФЭцЫЃ

- Android/ | анЯавцжЧ

- 2026-03-30

- ЯцICPБИ14008430КХ-1 ЯцЙЋЭјАВБИ 43070302000280КХ

- All Rights Reserved

- БОеОЮЊЗЧгЏРћЭјеОЃЌВЛНгЪмШЮКЮЙуИцЁЃБОеОЫљгаШэМўЃЌЖМгЩЭјгб

- ЩЯДЋЃЌШчгаЧжЗИФуЕФАцШЈЃЌЧыЗЂгЪМўИјxiayx666@163.com

- ЕжжЦВЛСМЩЋЧщЁЂЗДЖЏЁЂБЉСІгЮЯЗЁЃзЂвтздЮвБЃЛЄЃЌНїЗРЪмЦЩЯЕБЁЃ

- ЪЪЖШгЮЯЗвцФдЃЌГСУдгЮЯЗЩЫЩэЁЃКЯРэАВХХЪБМфЃЌЯэЪмНЁПЕЩњЛюЁЃ