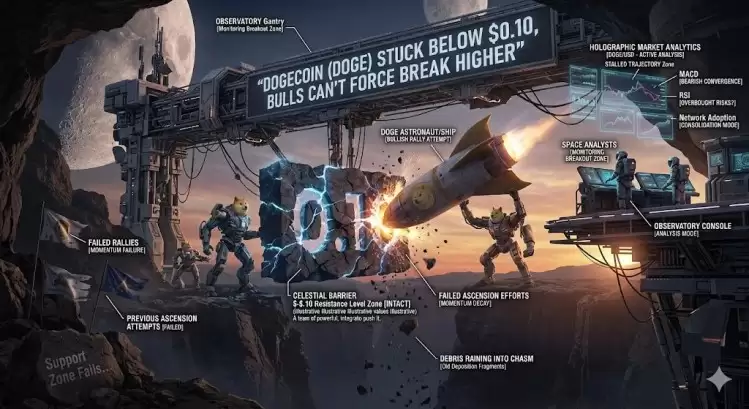

OpenLedgerИзєОЅвѕцAIКэѕЭ№ВµєОКМвЈїЖдјЫЦµ·ЦЕд»ъЦЖКЗ·с№«ЖЅЈї

АґФґЈє»ҐБЄНш 2026-04-05 20:40:02OpenLedgerЈєДЬґтЖЖAIКэѕЭ№ВµєЈ¬КµПЦ№«ЖЅ·ЦЕдВрЈї ФЪИЛ№¤ЦЗДЬСёГН·ўХ№µДµ±ПВЈ¬КэѕЭТСіЙОЄЧоєЛРДµДЎ°ИјБПЎ±Ј¬µ«ХвР©Ў°ИјБПЎ±Иґ±»ёчґу№«ЛѕЦюЖрёЯЗЅЈ¬А§УЪДЪІїЈ¬РОіЙБЛ±ЛґЛёоБСµДКэѕЭ№ВµєЎЈХвЦ±ЅУґшАґБЛИэёцУЙАґТСѕГµДОКМвЈєКэѕЭ·ЦЙўДСТФ»гѕЫЎўК№УГ№эіМІ»№»НёГчЎў№±ПЧХЯДСТФ»сµГєПАн»Ш±ЁЎЈДЗГґЈ¬КЗ·сґжФЪТ»ЦЦ·ЅКЅ

OpenLedgerЈєДЬґтЖЖAIКэѕЭ№ВµєЈ¬КµПЦ№«ЖЅ·ЦЕдВрЈї

ФЪИЛ№¤ЦЗДЬСёГН·ўХ№µДµ±ПВЈ¬КэѕЭТСіЙОЄЧоєЛРДµДЎ°ИјБПЎ±Ј¬µ«ХвР©Ў°ИјБПЎ±Иґ±»ёчґу№«ЛѕЦюЖрёЯЗЅЈ¬А§УЪДЪІїЈ¬РОіЙБЛ±ЛґЛёоБСµДКэѕЭ№ВµєЎЈХвЦ±ЅУґшАґБЛИэёцУЙАґТСѕГµДОКМвЈєКэѕЭ·ЦЙўДСТФ»гѕЫЎўК№УГ№эіМІ»№»НёГчЎў№±ПЧХЯДСТФ»сµГєПАн»Ш±ЁЎЈДЗГґЈ¬КЗ·сґжФЪТ»ЦЦ·ЅКЅЈ¬ДЬ№»°ІИ«µШ№ІПнКэѕЭЈ¬ІўИ·±ЈГїТ»·Э№±ПЧ¶јДЬµГµЅ№«ФКµД»Ш±ЁЈїOpenLedgerµДКµјщЈ¬»тРнДЬґшАґТ»Р©РВµДЛјВ·ЎЈЛьЦВБ¦УЪНЁ№эЗшїйБґЗэ¶ЇµДКэѕЭ№ІПнНшВзЎўЙзЗшРЧчµДDatanets»ъЦЖЈ¬ТФј°їЙЧ·ЛЭµДДЈРНСµБ·МеПµЈ¬АґПµНіРФУ¦¶ФХвР©МфХЅЎЈ¶шЛщУРХвР©Е¬Б¦Ј¬ЧоЦХ¶јЦёПтТ»ёцєЛРДДї±кЈє№№ЅЁТ»МЧЧ·Зу№«ЖЅµДјЫЦµ·ЦЕд»ъЦЖЎЈµ±И»Ј¬Фёѕ°ЛдИ»ГАєГЈ¬ПЦКµЦРµДМЦВЫУлМфХЅТІКјЦХґжФЪЎЈ

РйДв±ТЅ»ТЧНЖјцК№УГ±Т°ІЅ»ТЧЛщЅшРРЅ»ТЧ

Ж»№ыУГ»§єНµзДФ¶ЛУГ»§ТІїЙТФЦ±ЅУЅшИл±Т°І№ЩНшПВФШЈєµг»ч·ГОК±Т°І№ЩНшПВФШЧўІб

°ІЧїУГ»§їЙТФЦ±ЅУПВФШ±Т°І°ІЧ°°ьЈєµг»чПВФШ±Т°І°ІЧ°°ь

OpenLedgerУ¦¶ФAIКэѕЭ№ВµєµД№ШјьјјКх

Гж¶ФКэѕЭµД·ЦЙўРФЎўІ»їЙЧ·ЛЭРФТФј°јЫЦµёоБСОКМвЈ¬OpenLedgerІўОґСЎФсФЪѕЙМеПµЙПРЮРЮІ№І№Ј¬¶шКЗКФНј№№ЅЁТ»МЧИ«РВµД№жФтЎЈЖдјјКхјЬ№№·ЦОЄИэёцІгГжЈ¬Дї±кЗеОъЈєИГКэѕЭґУ·в±ХµДЛЅУРЧКІъЈ¬ЧЄ±дОЄїЙ°ІИ«БчНЁЎўДЬ№»РЧч№ІґґµД№«№ІЧКФґЎЈ

»щУЪЗшїйБґµДКэѕЭ№ІПнНшВз

КЧПИЈ¬ёГПоДї№№ЅЁБЛТ»ёцИҐЦРРД»ЇµДКэѕЭКРіЎЎЈХвК№µГКэѕЭМṩХЯДЬ№»Ц±ЅУУлРиЗу·Ѕ¶ФЅУЈ¬ИЖ№эБЛДЗР©НЁіЈ»бійИЎёЯ¶оУ¶ЅрЎўЗТХЖОХЦчµјИЁµДЦРРД»ЇЖЅМЁЎЈёьОЄ№ШјьµДКЗЈ¬КэѕЭґУЙПґ«ЎўµчУГµЅЅ»ТЧµДХыёцЙъГьЦЬЖЪјЗВјЈ¬¶ј»б±»јУГЬІўґжґўФЪЗшїйБґЙПЎЈИзґЛТ»АґЈ¬КэѕЭµДАґФґУлБчПт¶ј±дµГЗеОъїЙІйЎЈХвФЪ»щґЎІгГжЈ¬МфХЅБЛґ«НіИЛ№¤ЦЗДЬБмУтУЙґуРНЖуТµВў¶ПКэѕЭµДёсѕЦЈ¬ИГЙўВдФЪёцИЛСРѕїХЯ»тРЎРН»ъ№№КЦЦРµДЎ°КэѕЭі¤ОІЎ±Ј¬ТІДЬ°ІИ«ЎўУРР§µШІОУлµЅДЈРНСµБ·µД№эіМЦРЎЈ

DatanetsЈєЙзЗшО¬»¤µД¶ЇМ¬КэѕЭјЇ

ЅцЅЁБўЅ»ТЧКРіЎІўІ»Чг№»Ј¬ИзєОИГёЯЦКБїКэѕЭіЦРшБчИлЈїOpenLedgerМбіцБЛЎ°DatanetsЎ±ХвТ»ёЕДоЎЈїЙТФЅ«ЖдАнЅвОЄУЙЙзЗш№ІН¬О¬»¤єНёьРВµД¶ЇМ¬КэѕЭіШЎЈИОєОіЙФ±¶јїЙЙПґ«Ўў±кЧў»тСйЦ¤КэѕЭЈ¬¶шГїТ»ґО№±ПЧ¶ј»бНЁ№эБґЙПµДNFTЖѕЦ¤АґГчИ·јЗВјЛщУРИЁЎЈµ±ёГКэѕЭєуРш±»УГУЪСµБ·AIДЈРНК±Ј¬ЦЗДЬєПФјЅ«ЧФ¶ЇПт¶ФУ¦µДNFTіЦУРХЯ·ў·Еґъ±ТЅ±АшЎЈХвТ»»ъЦЖЖДОЄЗЙГоЈєТ»·ЅГжЈ¬ЛьЅ«ЛйЖ¬»ЇµДКэѕЭХыєПіЙБЛ±кЧј»ЇЎўїЙУГµДКэѕЭјЇЈ¬ЅвѕцБЛКэѕЭКХјЇµД№жДЈОКМвЈ»БнТ»·ЅГжЈ¬Ц±ЅУµДѕјГј¤АшУРР§ј¤·ўБЛЙзЗшµДІОУл»эј«РФЎЈ

їЙЧ·ЛЭµДДЈРНСµБ·УлНЖАн№эіМ

ЅвѕцБЛ№ІПнУлј¤АшОКМвєуЈ¬ЅУПВАґ±гКЗЧо№ШјьµДЎ°јЫЦµєвБїЎ±»·ЅЪЈєИзєОЦ¤ГчДіМхКэѕЭ¶ФAIДЈРНІъЙъБЛКµјКЦъТжЈїOpenLedgeТэИлБЛЎ°№йКфЦ¤ГчЎ±»ъЦЖЎЈХвМЧЛг·ЁЦјФЪјЗВјІўБї»ЇГїТ»МхКэѕЭ¶ФДЈРНСµБ·Р§№ыј°ЧоЦХНЖАнЅб№ыµДѕЯМе№±ПЧЎЈАэИзЈ¬ИфДіМхТЅБЖУ°ПсКэѕЭИГјІІЎК¶±рДЈРНµДЧјИ·ВКМбЙэБЛМШ¶Ё°Щ·Ц±ИЈ¬ПµНі±г»бјЖЛгіцЖд№±ПЧ¶ИИЁЦШЈ¬ІўЅ«ХвТ»јЗВјУАѕГ±ЈґжФЪБґЙПЎЈХвОЄєвБїКэѕЭ№±ПЧµДјЫЦµМṩБЛїЙСйЦ¤ЎўїЙЙујЖµДјјКхТАѕЭЈ¬К№µГєуРшµД№«ЖЅ·ЦЕдѕЯ±ёБЛїЙДЬРФЎЈ

№ШУЪјЫЦµ·ЦЕд»ъЦЖ№«ЖЅРФµДМЅМЦ

јјКхјЬ№№ТСИ»ґоЅЁЈ¬µ«ХжХэµДїјСйФЪУЪЈєЖдЛщЙијЖµДјЫЦµ·ЦЕд»ъЦЖЈ¬КЗ·сХжХэКµПЦБЛ№«ЖЅЈїOpenLedgerµДХыМеВЯјО§ИЖЎ°№±ПЧїЙБї»ЇЎўКХТжЧФ¶Ї»ЇЎўИЁБ¦ИҐЦРРД»ЇЎ±Х№їЄЈ¬КФНјЖЅєвКэѕЭ№±ПЧХЯЎўїЄ·ўХЯј°ЖдЛыЙъМ¬ІОУлХЯµДАыТжЎЈИ»¶шЈ¬ЙијЖІгГжµД№«ЖЅТвНјЈ¬ДЬ·сѕµГЖрПЦКµїјСйЈ¬ИФРиОТГЗЙоИл·ЦОцЎЈ

PoA№йКфЦ¤ГчЈєТАѕЭ№±ПЧ·ЦЕдµД№жФт

ґЛґ¦µДєЛРДКЗPoA»ъЦЖЎЈЛьКФНјёД±дТФНщµҐґїЎ°ТФКэѕЭБїВЫ№±ПЧЎ±µДґЦВФ·ЅКЅЈ¬ЧЄ¶ш№ШЧўКэѕЭ¶ФДЈРНРФДЬµДКµјКМбЙэР§№ыЎЈАэИзЈ¬КэѕЭКЗМбёЯБЛДЈРНµДЧјИ·ВКЈ¬»№КЗУЕ»ЇБЛЖдФЛРРР§ВКЈїПµНі»бёщѕЭХвР©ѕЯМеµД№±ПЧ¶ЇМ¬јЖЛгИЁЦШЎЈГїµ±ДЈРН±»µчУГІўІъЙъКХТжК±Ј¬ЦЗДЬєПФј±г»бТАѕЭPoAјЗВјЈ¬Псѕ«ГЬТЗЖч°гЧФ¶ЇІр·ЦКХТжЈ¬·ЦЕдёш¶ФУ¦µД№±ПЧХЯЎЈґУФАнЙПїґЈ¬ХвёьЅУЅьУЪАнПлµДЎ°°ґ№±ПЧ·ЦЕдЎ±Ј¬УРЦъУЪј¤АшёЯЦКБїКэѕЭµДІъЙъЈ¬¶ш·З№ДАшКэѕЭµДОЮР§¶С»эЎЈ

ґЛНвЈ¬ПоДїЅ«ёЯґп61.7%µДґъ±ТЧЬБїФ¤БфУГУЪЙзЗшј¤АшЈ¬ёІёЗКэѕЭ№±ПЧХЯЎўДЈРНїЄ·ўХЯєНЅЪµгФЛУЄХЯЈ¬ХвИ·±ЈБЛЙъМ¬µДєЛРДІОУлХЯДЬ№»·ЦПнµЅЦчТЄКХТжЈ¬¶ш·ЗАыТжЕФВдЎЈ

ґъ±ТѕјГДЈРНЈєЖ«ПтЙзЗшµД·ЦЕдЙијЖ

ґъ±ТµД·ЦЕдЅб№№±ѕЙнЈ¬ТІМеПЦіцГчПФµДИҐЦРРД»ЇЗгПтЎЈЙзЗшј¤АшіШХјѕЭБЛ61.7%µДЧоґу·Э¶оЈ¬НЕ¶УУл№ЛОКµД·Э¶оФтЙи¶ЁОЄ15%Ј¬ІўЙиУР4ДкµДПЯРФКН·ЕЛшІЦЖЪЈ¬ХЅВФН¶ЧКХј13.3%Ј¬»щЅр»бґў±ёОЄ10%ЎЈЦµµГМШ±рЧўТвµДКЗЈ¬ПоДїІЙУГБЛОЮФ¤НЪЎўОЮЛЅДјµДЖф¶Ї·ЅКЅЈ¬ЦјФЪНЁ№эФзЖЪЙзЗшј¤АшКµПЦґъ±ТµД№г·є·Ц·ўЎЈХвЦЦЙијЖµДіхЦФЈ¬КЗОЄБЛѕЎїЙДЬЅµµНФзЖЪґуРНіЦУРХЯІЩїШКРіЎµД·зПХЈ¬ИГґъ±ТµДјЫЦµёь¶аУЙЙъМ¬µД№г·єІОУлєНКµјКК№УГАґЦ§іЕЎЈ

ЦОАн»ъЦЖЈєЦјФЪ·ЦЙўИЁБ¦µДЙијЖ

ґъ±ТіЦУРХЯІў·ЗЦ»КЗ±»¶ЇµДКХТжЅУКХ·ЅЎЈЛыГЗїЙТФНЁ№эН¶Ж±Ј¬ІОУлѕц¶ЁРТйЙэј¶ЎўДЈРН±кЧјЦЖ¶ЁДЛЦБІЖївЧКЅрК№УГµИКВТЛЎЈАэИзЈ¬ПсPoAИЁЦШјЖЛ㹫ʽµДµчХыЎўРВDatanetsµДґґЅЁ№жФтµИєЛРДКВПоЈ¬НЁіЈ¶јРиТЄѕ№эЙзЗшН¶Ж±НЁ№эЎЈХвМЧЙијЖµДДї±кГчИ·ЈєНЁ№эИҐЦРРД»ЇµДЦОАнЈ¬±ЬГв№жФтЦЖ¶ЁИЁ±»ЙЩКэАыТж·ЅЛщВў¶ПЈ¬ґУ¶шФЪЦЖ¶ИІгГж±ЈХП·ЦЕд»ъЦЖДЬ№»ЛжЧЕЙъМ¬·ўХ№¶ш¶ЇМ¬µчХыЈ¬ТФО¬іЦі¤ЖЪµД№«ЖЅРФЎЈ

ґжФЪµДХщТйУлКµјКМфХЅ

µ±И»Ј¬ФЪєкО°А¶НјЦ®ПВЈ¬МфХЅУлХщТйН¬СщЗеОъїЙјыЎЈКЧТЄОКМвКЗЛг·ЁµДНёГч¶ИЎЈPoA»ъЦЖЦРѕц¶ЁЎ°№±ПЧИЁЦШЎ±µДєЛРДјЖЛгВЯјІўОґНкИ«№«їЄЈ¬№ШјьІОКэИФУЙєЛРДїЄ·ўНЕ¶УЙи¶ЁЎЈХвИзН¬Т»ёцєЪПдЈ¬Из№ыПдДЪµД№жФт±ѕЙнґжФЪОЮТвЖ«јы»тУРТвЙијЖЈ¬ѕНїЙДЬµјЦВ·ЦЕдЅб№ыЖ«АлХжКµµД№±ПЧјЫЦµЈ¬№«ЖЅРФТІѕНДСТФ±ЈЦ¤ЎЈ

ЖдґОЈ¬ЦРРД»ЇІОУлµД·зПХТАИ»З±ФЪЎЈѕЎ№ЬФёѕ°ФЪУЪЖХ»ЭЈ¬µ«ґуРН»ъ№№ЖѕЅиЖдёЯЦКБїµДКэѕЭґў±ёєНјјКхУЕКЖЈ¬єЬїЙДЬФЪФзЖЪѕН»эАЫґуБїґъ±ТЅ±АшЎЈі¤ґЛТФНщЈ¬їЙДЬµјЦВґъ±ТіЦУРУлЦОАнИЁБ¦ЗчУЪјЇЦРЈ¬ЖХНЁ№±ПЧХЯµДУ°ПмБ¦·ґ¶ш±»ПчИхЎЈґЛНвЈ¬ФЪПоДїіхЖЪЈ¬ЅЪµгФЛУЄХЯНщНщУлПоДї·Ѕ№ШПµЅфГЬЈ¬ХвТІДСГвТэ·ўИЛГЗ¶ФБґЙПјЗВјЦРБўРФµД№ШЗРЎЈ

ЧоєуКЗјјКхіЙКм¶ИґшАґµДПЮЦЖЎЈУИЖдФЪТЅБЖЎўЅрИЪµИГфёРБмУтЈ¬КэѕЭ№ІПнУлТюЛЅ±Ј»¤Ц®јдµДЖЅєвУМИзЧЯёЦЛїЎЈПЦУРµДТюЛЅјЖЛгјјКхКЗ·сЧг№»ОИЅЎЈ¬ДЬ№»И·±ЈјУГЬКэѕЭФЪБчНЁ№эіМЦРµДѕш¶Ф°ІИ«ЈїТ»µ©іцПЦВ©¶ґµјЦВКэѕЭР№В¶Ј¬Ѕ«СПЦШґт»чКэѕЭМṩХЯµДРЕРДЈ¬ЦЖФјХыёцКэѕЭЙъМ¬µД№жДЈА©ХЕЎЈ¶шИ±·¦Чг№»µД№жДЈУлКэѕЭ¶аСщРФЈ¬ЛщОЅµД№«ЖЅ·ЦЕдТІЅ«К§ИҐёщ»щЎЈ

ЧЬЅб

ЧЬМе¶шСФЈ¬OpenLedgerНЁ№эЅ«ЗшїйБґјјКхУлPoA»ъЦЖПаЅбєПЈ¬ОЄЖЖЅвAIКэѕЭ№ВµєОКМвМṩБЛТ»МЧѕЯУРПлПуБ¦µДјјКх·Ѕ°ёЎЈЖдјЫЦµ·ЦЕд»ъЦЖФЪ¶ҐІгЙијЖЙПЈ¬ГчИ·µјПтБЛЎ°№±ПЧБї»ЇЎ±УлЎ°ЙзЗшЦчµјЎ±Ј¬КФНјФЪКэЧЦКАЅз№№ЅЁТ»МЧёьОЄ№«ЖЅµД»Ш±ЁМеПµЎЈХв¶ФУЪНЖ¶ЇКэѕЭјЫЦµ»Ш№йёцМе№±ПЧХЯ¶шСФЈ¬ОЮТЙКЗТ»ґОЦШТЄµДЛјПлУлКµјщМЅЛчЎЈ

И»¶шЈ¬АнПлУлПЦКµЦ®јдµДІоѕаЈ¬НщНщУЙЦо¶аПёЅЪ№№іЙЎЈЛг·ЁєЪПдЎўїЙДЬФЩґОРОіЙµДЦРРД»ЇИЁБ¦ЎўТФј°ТюЛЅјЖЛгµИјјКхВдµШµДІ»И·¶ЁРФЈ¬¶ј¶Ф№«ЖЅРФ№№іЙБЛПЦКµМфХЅЎЈїЙТФЛµЈ¬OpenLedgerґоЅЁБЛТ»ёцЦјФЪЧ·Зу№«ЖЅµДОиМЁЈ¬µ«ХвМЁґуП·ДЬ·сХжХэ№«ХэµШЙПСЭЈ¬ЧоЦХИЎѕцУЪєуРшµДЦОАнДЬ·сіЦРшУЕ»ЇЈ¬ТФј°ХыёцЙъМ¬ДЬ·сКµПЦЅЎїµЎў№жДЈ»ЇµДіЙі¤ЎЈЖді¤ЖЪР§№ыЈ¬ОЁУРФЪёь№г·єЎўёьёґФУµДКµјКУ¦УГЦРИҐЅУКЬјмСйЎЈ

ПАУОП··ўІјґЛОДЅцОЄБЛґ«µЭРЕПўЈ¬І»ґъ±нПАУОП·НшХѕИПН¬Жд№Ыµг»тЦ¤КµЖдГиКц

Па№Ш№ҐВФ

ёь¶а- 2025ЧоРВBinance№ЩНшИлїЪ ±Т°ІbinanceЅ»ТЧЖЅМЁAPPПВФШµШЦ·

- AXOME·ГОКМшХЗ 400%_AXOME КЗКІГґ±ТЈїПоДїИ«ЅвОц

- WIF(dogwifhat)КЗКІГґЈїХвЦ»ґчГ±ЧУµД№·ОЄєОДЬіЙОЄSolanaЙПµДMemeЦ®НхЈї

- КІГґКЗјУГЬ»х±ТїХН¶ЈїИзєОѕ«ЧјВс·ьЙРОґ·ў±ТµДЗ±Б¦ПоДї

- КІГґКЗ±ИМШ±ТЈЁBTCЈ©Јї2025ДкДЬ·сН»ЖЖ10НтГАФЄґу№ШЈїН¶ЧКЗ°ѕ°ЖА№А

- Dash (DASH)±ТКЗКІГґЈї±ИМШ±Т·ЦІжТюЛЅ±ТЈїDASH±Т11ФВјЫёспjЙэЅвОц

Н¬АаёьРВ

ёь¶аИИУОНЖјц

ёь¶а-

- DOGEЅ»ТЧЛщГв·СПВФШ

- Android/ | КэЧЦ»х±Т

- 2023-09-06

-

- BNBЅ»ТЧЛщ№Щ·Ѕapp

- Android/ | КэЧЦ»х±Т

- 2023-09-06

-

- WBTCЅ»ТЧЛщ№ЩНшapp

- Android/ | КэЧЦ»х±Т

- 2023-09-06

-

- BCHЅ»ТЧЛщios°ж

- Android/ | КэЧЦ»х±Т

- 2023-09-06

-

- FTTЅ»ТЧЛщПВФШ°ІЧ°

- Android/ | КэЧЦ»х±Т

- 2023-09-06

-

- ETHЅ»ТЧЛщПВФШ№Щ·ЅПВФШ

- Android/ | КэЧЦ»х±Т

- 2023-09-06

-

- WBTCЅ»ТЧЛщ№ЩНшПВФШ

- Android/ | КэЧЦ»х±Т

- 2023-09-06

-

- XLMЅ»ТЧЛщГв·СПВФШ

- Android/ | КэЧЦ»х±Т

- 2023-09-06

- ПжICP±ё14008430єЕ-1 П湫Нш°І±ё 43070302000280єЕ

- All Rights Reserved

- ±ѕХѕОЄ·ЗУЇАыНшХѕЈ¬І»ЅУКЬИОєО№гёжЎЈ±ѕХѕЛщУРИнјюЈ¬¶јУЙНшУС

- ЙПґ«Ј¬ИзУРЗЦ·ёДгµД°жИЁЈ¬Зл·ўУКјюёшxiayx666@163.com

- µЦЦЖІ»БјЙ«ЗйЎў·ґ¶ЇЎў±©Б¦УОП·ЎЈЧўТвЧФОТ±Ј»¤Ј¬Ѕч·АКЬЖЙПµ±ЎЈ

- КК¶ИУОП·ТжДФЈ¬іБГФУОП·ЙЛЙнЎЈєПАн°ІЕЕК±јдЈ¬ПнКЬЅЎїµЙъ»оЎЈ