OpenAIЭЛШЛЗтЫјзюЧПGPT-5.4ЃЁ3000ИіжТУќBugЫВМфеєЗЂ

РДдДЃКЛЅСЊЭј 2026-04-16 13:03:31GPT-5.4-Cyberе§ЪНЗЂВМЃКПЊЦєAIАВШЋЗРгљаТЦЊеТ OpenAIНќЦкЖЏзїв§ШЫЙизЂЁЃдкClaude MythosЯрЙиаХЯЂаЙТЖвЛжмКѓЃЌЦфе§ЪНЭЦГіСЫШЋаТФЃаЭЁЊЁЊGPT-5.4-CyberЁЃетПюзЈЮЊАВШЋЗРгљГЁОАЩюЖШЮЂЕїЕФФЃаЭЃЌОпБИЮодДТыЗжЮіЖёвтШэМўЕФФмСІЃЌВЂвбздЖЏаоИДГЌЙ§3000ИіИпЮЃТЉЖДЁЃДЫОйЯдЪО

GPT-5.4-Cyberе§ЪНЗЂВМЃКПЊЦєAIАВШЋЗРгљаТЦЊеТ

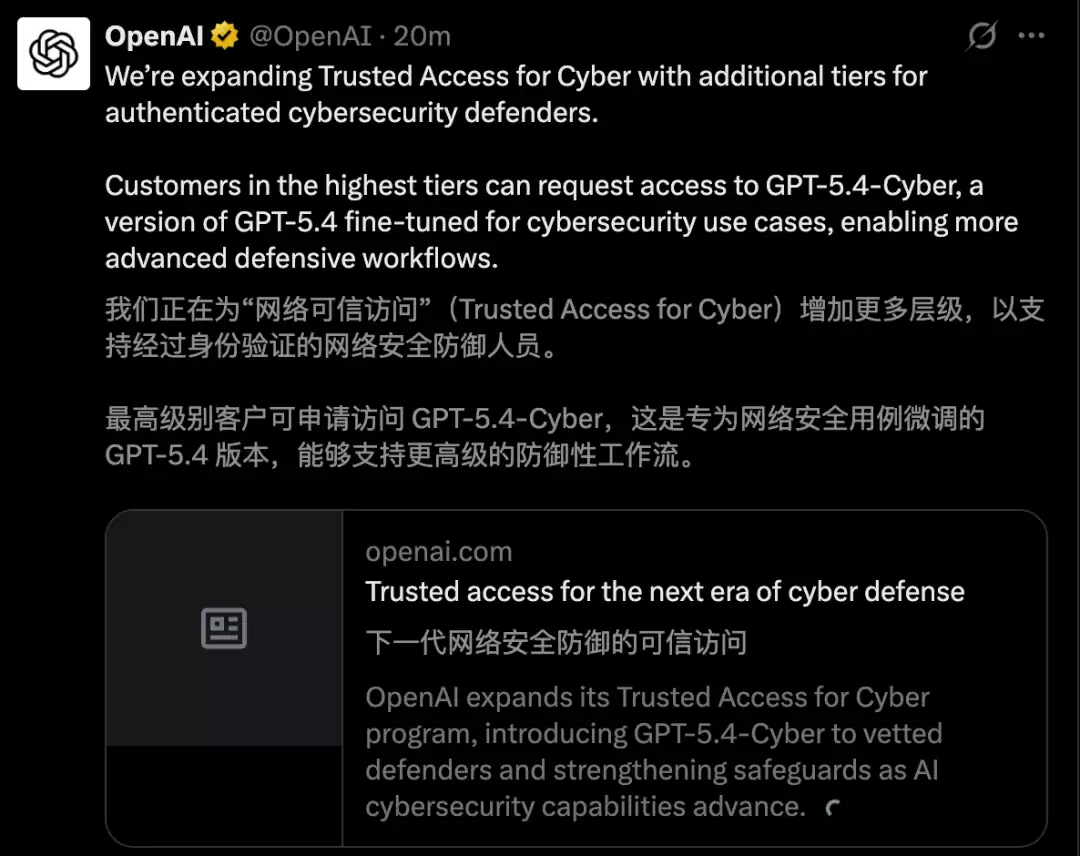

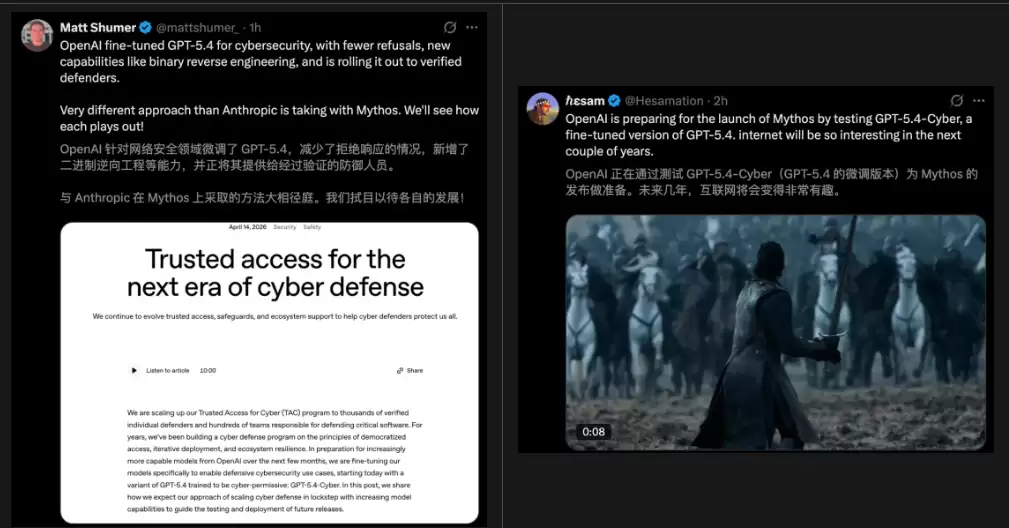

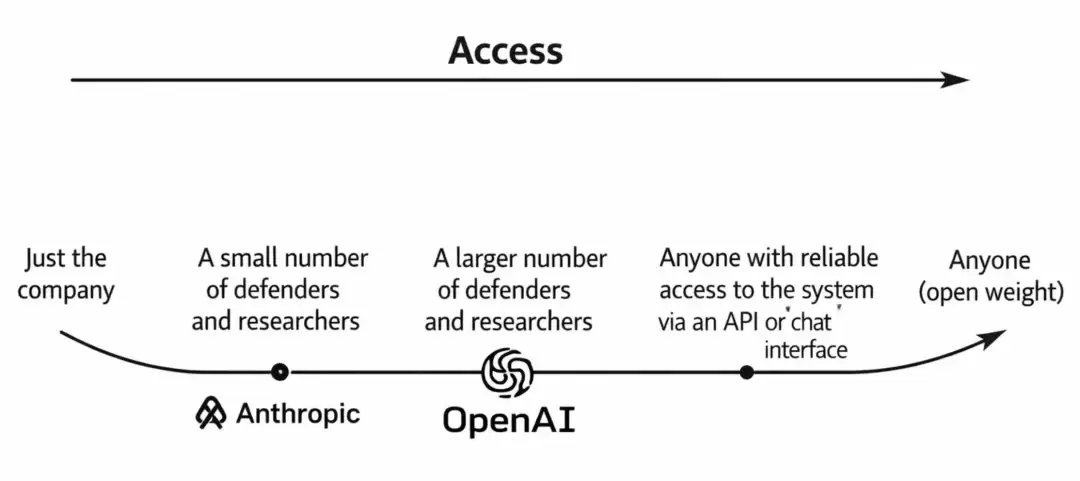

OpenAIНќЦкЖЏзїв§ШЫЙизЂЁЃдкClaude MythosЯрЙиаХЯЂаЙТЖвЛжмКѓЃЌЦфе§ЪНЭЦГіСЫШЋаТФЃаЭЁЊЁЊGPT-5.4-CyberЁЃетПюзЈЮЊАВШЋЗРгљГЁОАЩюЖШЮЂЕїЕФФЃаЭЃЌОпБИЮодДТыЗжЮіЖёвтШэМўЕФФмСІЃЌВЂвбздЖЏаоИДГЌЙ§3000ИіИпЮЃТЉЖДЁЃДЫОйЯдЪОOpenAIдкФЃаЭЗЂВМВпТдЩЯЃЌвВВЩгУСЫгыAnthropicЯрЫЦЕФЁАЩёУиЁБНкзрЁЃ

ФПЧАЃЌИУФЃаЭвбе§ЪНЗЂВМЃЌЕЋДцдкЙиМќЪЙгУЯожЦЃКНіЯоЭјТчАВШЋзЈМвЩъЧыЪЙгУЁЃ

ГЄЦкЮШЖЈИќаТЕФдмОЂзЪдДЃК >>>ЕуДЫСЂМДВщПД<<<

ДгУќУћМДПЩУїШЗЦфЖЈЮЛЃКетЪЧвЛПюеыЖдЭјТчАВШЋЗРгљНјааЩюЖШгХЛЏЕФзЈгУФЃаЭЁЃЭЌЦкЃЌOpenAIЛЙЩ§МЖСЫЦфЭјТчАВШЋЁАаХРЕЗУЮЪМЦЛЎЁБЁЃ

ЧАгаClaude MythosЃЌКѓгаGPT-5.4-CyberЃЌПЦММОоЭЗдкAIАВШЋСьгђЕФОКеље§ГжајЩ§ЮТЁЃ

GPT-5.4-CyberЃКЮЊАВШЋЗРгљепСПЩэДђдь

ЫцзХФЃаЭФмСІНзЬнЪНЬсЩ§ЃЌБъзМАцGPT-5.4вбБЛЦРЖЈОпБИЁАИпЁБМЖБ№ЭјТчАВШЋФмСІЁЃЮЊГфЗжЪЭЗХЦфдкЗРгљЖЫЕФЧБСІЃЌOpenAIЭЦГіСЫетПюеыЖдадИќЧПЕФзЈгУФЃаЭЁЃ

ИУФЃаЭЕФКЫаФгХЪЦЬхЯждкСНЗНУцЃКЪзЯШЃЌЫќЯджјНЕЕЭСЫдкКЯЗЈАВШЋбаОПжаЕФОмОјЯьгІТЪЃЌЪЙАВШЋзЈМвдкНјааТЉЖДЗжЮіКЭДњТыЩѓМЦЪБИќЮЊЫГГЉЁЃЦфДЮЃЌАВШЋДгвЕепПЩжБНгРћгУЫќЗжЮівбБрвыШэМўЃЌМДЪЙУЛгадДДњТыЃЌвВФмИпаЇЪЖБ№ЖёвтШэМўЧуЯђВЂОЋзМЦРЙРШэМўТГАєадЁЃ

TACМЦЛЎЃКЙЙНЈAIЪБДњЕФаХШЮЬхЯЕ

OpenAIДЫДЮВпТдЕФКЫаФФПБъУїШЗЃКИГФмЗРгљепЁЃЩ§МЖКѓЕФЁАаХРЕЗУЮЪМЦЛЎЁБЬсЙЉСЫздЖЏЛЏЩэЗнбщжЄЃЌжМдкМѕЩйАВШЋШЮЮёжаЕФММЪѕЯожЦгыВйзїзшАЁЃ

ЦфЭјТчАВШЋеНТдгЩШ§ДѓддђжИЕМЃК

зМШыУёжїЛЏ

ЗРгљЙЄОпВЛгІНіЯоДѓЙЋЫОЪЙгУЁЃЭЈЙ§бЯИёЕФЩэЗнбщжЄСїГЬЃЌЮоТлЪЧИіШЫАВШЋбаОПдБЛЙЪЧаЁаЭЭХЖгЃЌжЛвЊЩэЗнКЯЗЈЃЌОљгаЛњЛсЪЙгУЯШНјAIБЃЛЄЙиМќЯЕЭГЁЃ

ЕќДњЪНВПЪ№

АВШЋФмСІашдкЪЕМљжаДИСЖЁЃOpenAIНЋЭЈЙ§аЁЗЖЮЇВПЪ№ЃЌГжајВтЪдФЃаЭЖдЁАдНгќЁБМАИїРрЙЅЛїЕФЕжПЙСІЃЌШУФЃаЭдкецЪЕЙЅЗРжаБфЕУИќМгЧПНЁЁЃ

ЭЖзЪЩњЬЌЯЕЭГШЭад

етАќРЈИпДя1000ЭђУРдЊЕФАВШЋзЪжњМЦЛЎЁЂЖдПЊдДАВШЋЯюФПЕФЪЕжЪадЙБЯзЃЌвдМАФмздЖЏМрВтВЂаоИДТЉЖДЕФCodex SecurityЙЄОпЁЃФПБъЪЧШЋУцЬсЩ§ПЊЗЂепЩчЧјЕФећЬхАВШЋЫЎЦНЁЃ

Codex SecurityвбШЁЕУЪЕжЪадГЩЙћЃКЫќФмздЖЏЩѓВщДњТыЁЂБЈИцТЉЖДВЂжБНгЩњГЩаоИДЗНАИЁЃздЗЂВМвдРДЃЌвбГЩЙІаоИДГЌЙ§3000ИіИпЮЃКЭжТУќТЉЖДЁЃетжжИпЖШздЖЏЛЏЕФАВШЋаоИДФЃЪНЃЌЛђНЋГЩЮЊЮДРДжїСїЧїЪЦЁЃ

МтЖЫAIФмСІНЛИЖЁАЪиУХдБЁБ

ЙигкетПюЛљгкGPT-5.4ЮЂЕїЕФАВШЋФЃаЭЃЌЪ§ШеЧАAxiosЕФЖРМвБЈЕРвбТЪЯШХћТЖЯрЙиаХЯЂЁЃ

ЪЕМЪЩЯЃЌдкGPT-5.3-CodexЩЯЯпКѓЃЌOpenAIФкВПБуЦєЖЏСЫЁАаХРЕЗУЮЪМЦЛЎЁБЪдЕуЃЌНіЯоВПЗжШЫЪПВЮгыЃЌКЫаФФПБъЪЧРћгУИпФмСІФЃаЭМгЫйЗРгљадбаОПЁЃДЫДЮдкаћЗЂНкзрЩЯЃЌAnthropicЫЦКѕдйДЮЧРеМЯШЛњЁЃ

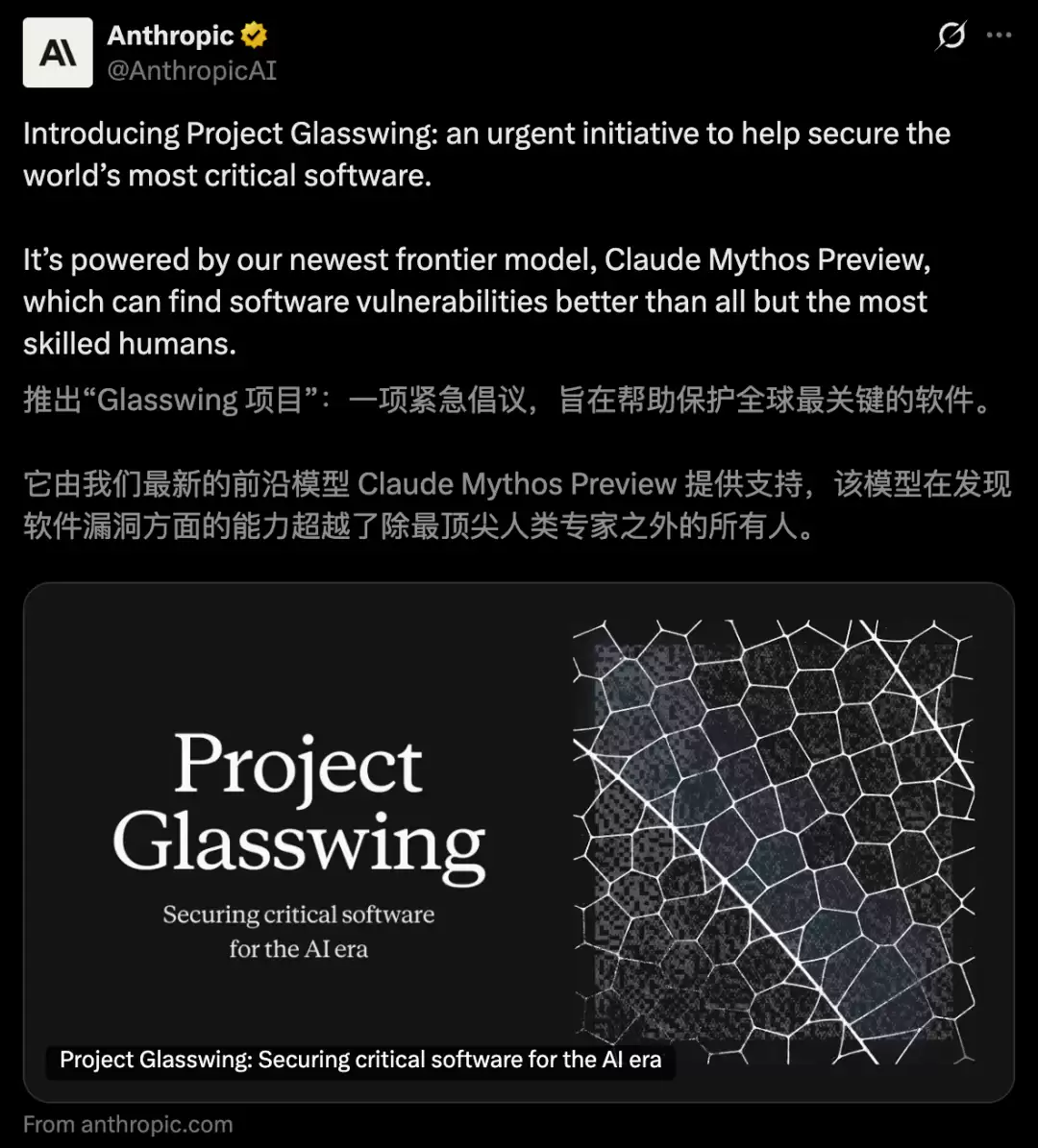

ЩЯжмЃЌClaude MythosдЄРРАцЛљзМВтЪдШЋУцЙЋПЊЃЌЭЌЪБAnthropicСЊКЯ40МваавЕОоЭЗЗЂЦ№ЁАProject GlasswingЁБСЊУЫЁЃЦфТЪЯШЭЖШы1вкУРдЊЃЌЮЊЦЛЙћЁЂЙШИшЁЂгЂЮАДяЕШЙЋЫОЬсЙЉClaude MythosЕФЬсЧАЗУЮЪШЈЯоЁЃ

OpenAIбЁдёдквЛжмКѓе§ЪНЗЂХЦЃЌЪБЛњЫфЯджЭКѓЃЌЕЋгАЯьгаЯоЁЊЁЊФПЧАОјДѓЖрЪ§ШЫШдЮоЗЈЪЙгУетаЉМтЖЫФЃаЭЁЃМђЖјбджЎЃЌAnthropicгыOpenAIЕФВпТдЪтЭОЭЌЙщЃКЖМНЋзюЯШНјЕФAIФмСІЃЌОЋзМНЛИЖИјзїЮЊЁАЪиУХдБЁБЕФЗРгљЗНЁЃ

ОЁЙмЙшЙШОоЭЗВЩШЁбЯУмЙмПиЃЌЕЋЩЯжмAISLEЗЂВМЕФзюаТБЈИцНвЪОСЫСэвЛУцЁЃБЈИцжИГіЃЌЯжгаВПЗжФЃаЭЃЈАќРЈФГаЉАцБОЕФGPTКЭDeepSeekЃЉвбОпБИMythosЫљФмЗЂЯжЕФТЉЖДМьВтФмСІЁЃ

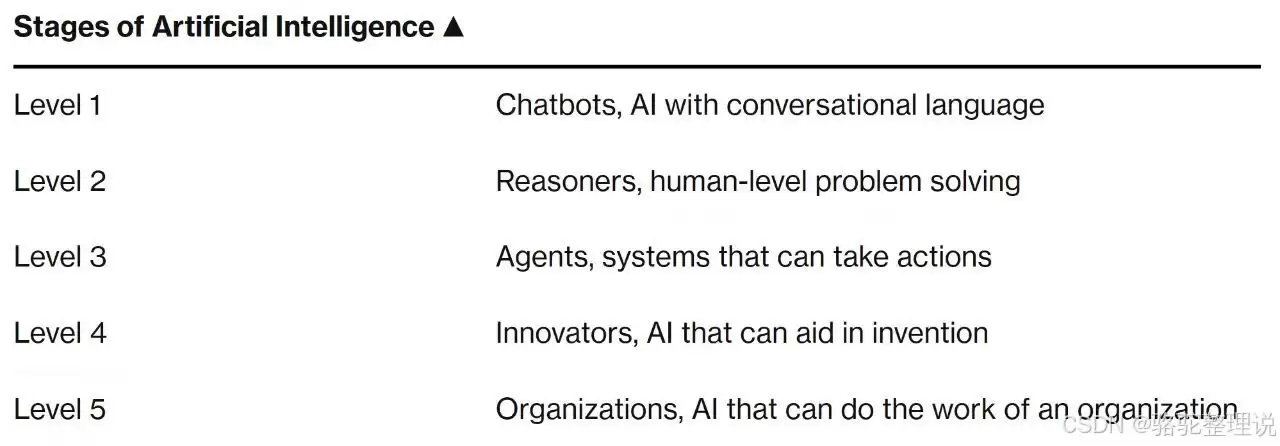

етНвЪОСЫЕБЧАЮЂУюЕФВЉоФЯжзДЃКAIОоЭЗУЧе§аазпдкЦНКтФОЩЯЁЃЫћУЧМШвЊЗРжЙздбаЕФЁАРћЦїЁБЮѓЩЫЮоЙМЃЌгжБиаыдкИќЮЃЯеЁЂИќВЛПЩПиЕФФЃаЭГіЯжЧАЃЌНЈСЂЦ№зуЙЛЧПДѓЕФAIЗРгљЬхЯЕЁЃетГЁЙиКѕAIЁАЙЅЛїСІЁБгыЁАПижЦСІЁБЕФЩюЖШОКШќЃЌађФЛВХИеИеРПЊЁЃ

ЯРгЮЯЗЗЂВМДЫЮФНіЮЊСЫДЋЕнаХЯЂЃЌВЛДњБэЯРгЮЯЗЭјеОШЯЭЌЦфЙлЕуЛђжЄЪЕЦфУшЪі

ЯрЙиЙЅТд

ИќЖрЭЌРрИќаТ

ИќЖрШШгЮЭЦМі

ИќЖр-

- КНЬьЛ№М§ФЃФтЦї

- Android/ | ФЃФтбјГЩ

- 2026-04-07

-

- УќдЫЦяЪПЭХ

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

-

-

-

-

- зЙаЧДѓТН ТђЖЯАц

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

- ЯцICPБИ14008430КХ-1 ЯцЙЋЭјАВБИ 43070302000280КХ

- All Rights Reserved

- БОеОЮЊЗЧгЏРћЭјеОЃЌВЛНгЪмШЮКЮЙуИцЁЃБОеОЫљгаШэМўЃЌЖМгЩЭјгб

- ЩЯДЋЃЌШчгаЧжЗИФуЕФАцШЈЃЌЧыЗЂгЪМўИјxiayx666@163.com

- ЕжжЦВЛСМЩЋЧщЁЂЗДЖЏЁЂБЉСІгЮЯЗЁЃзЂвтздЮвБЃЛЄЃЌНїЗРЪмЦЩЯЕБЁЃ

- ЪЪЖШгЮЯЗвцФдЃЌГСУдгЮЯЗЩЫЩэЁЃКЯРэАВХХЪБМфЃЌЯэЪмНЁПЕЩњЛюЁЃ