Transformer与RNN合体,谷歌打下显存门槛,解锁超长上下文

来源:互联网 2026-04-17 19:56:31谷歌再出招:为RNN配备“可生长”记忆缓存,挑战Transformer显存瓶颈 编辑|泽南 近期,谷歌在优化大模型内存使用方面持续发力。 继上个月发布可能大幅压缩KV Cache的TurboQuant技术并引发行业震动后,本周谷歌团队再次发布一篇新论文,提出了一种解决大模型处理长文本时内存瓶颈的创新

谷歌再出招:为RNN配备“可生长”记忆缓存,挑战Transformer显存瓶颈

编辑|泽南

长期稳定更新的攒劲资源: >>>点此立即查看<<<

近期,谷歌在优化大模型内存使用方面持续发力。

继上个月发布可能大幅压缩KV Cache的TurboQuant技术并引发行业震动后,本周谷歌团队再次发布一篇新论文,提出了一种解决大模型处理长文本时内存瓶颈的创新方法。

该方法的核心思路是,通过对模型架构进行机制创新,为传统的循环神经网络赋予“可生长的记忆容量”。这旨在探索一条结合Transformer与RNN各自优势的新路径。

简而言之,该技术有望帮助AI模型处理更长的文本序列,解锁更强的长上下文理解能力,同时显著降低推理所需的计算资源消耗。这一特性被视为生产环境中的关键需求。

Transformer的挑战与RNN的局限

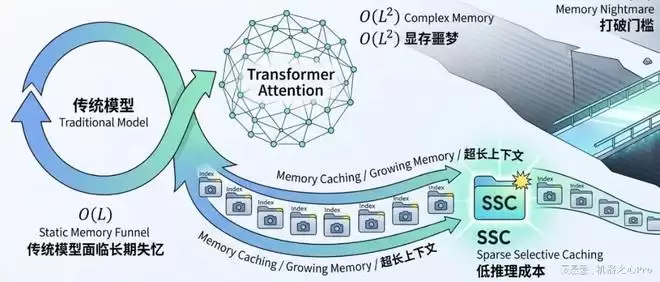

当前主流大模型主要基于Transformer架构。其核心优势在于注意力机制带来的强大信息召回能力,但代价是计算和内存消耗随上下文长度呈二次方增长,导致处理超长文本的成本极高。

为应对此问题,业界一直在探索RNN、线性注意力及状态空间模型等替代架构。这些循环架构的优势在于其固定的记忆容量和线性的计算复杂度,因而推理速度快、显存占用低。但其主要短板在于,所有历史信息都被压缩到一个固定大小的隐藏状态中,导致在需要从长文档中精准提取细节的密集召回任务上,性能通常不及Transformer。

解决方案:为RNN引入“记忆缓存”机制

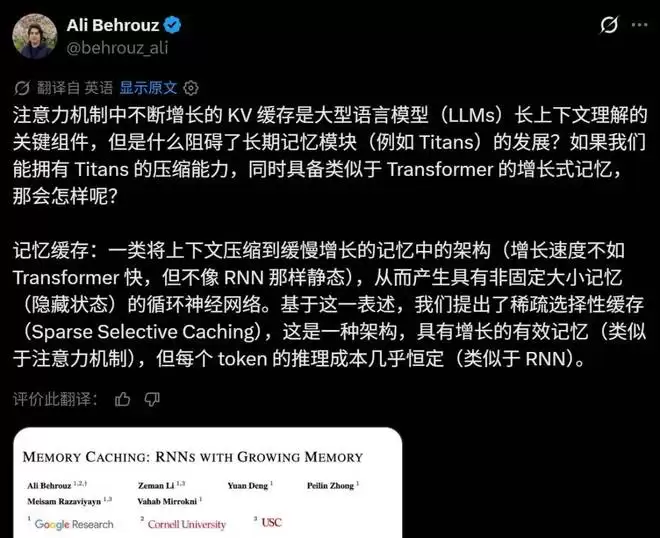

谷歌研究团队提出了一项名为“记忆缓存”的技术,旨在打破上述僵局。

论文:《Memory Caching: RNNs with Growing Memory》论文链接:https://arxiv.org/abs/2602.24281

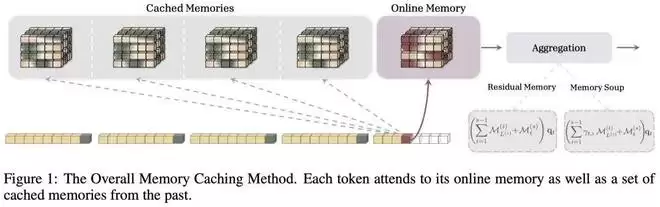

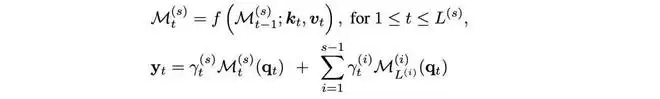

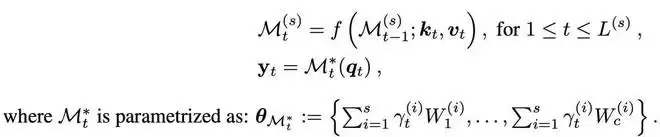

该研究将架构视为一个光谱:一端是缓存每个Token的Transformer,另一端是仅维护单一压缩记忆的传统RNN。记忆缓存技术则创造了一种中间形态——将成组的Token压缩后缓存为长期记忆状态,并在需要时进行检索。

其核心原理是,允许RNN定期为隐藏状态保存“快照”,而非仅维护一个不断更新的当前状态。当模型需要检索信息时,既可访问当前的在线记忆,也能直接调用缓存中的历史快照,从而更快速、准确地找回过往信息。

三种实现变体:权衡记忆增长与计算成本

为验证概念,研究团队提出了三种主要的记忆缓存变体,区别在于组合过去信息的方式。

1. 门控残差记忆:该方法通过查询从历史缓存中检索相关信息,并执行类似注意力的池化操作进行组合。这使得RNN的有效记忆持续增长,解码成本也随之增加。

2. 记忆汤:此变体直接融合历史记忆的权重,而非针对特定查询的输出。它需要对过去记忆的权重进行池化,然后对池化后的记忆进行一次检索。其有效记忆同样随上下文增长,解码成本增加。

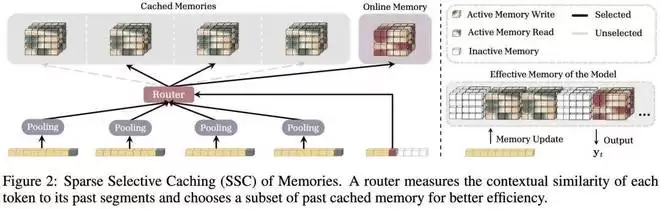

3. 稀疏选择性缓存:该变体旨在在增长的有效记忆与恒定的解码成本之间取得平衡。它类似于混合专家模型,在序列维度上稀疏地选择历史缓存记忆的一个子集,从而在有效记忆增长的同时,保持每Token解码成本相对恒定。

实际效果:实验数据验证

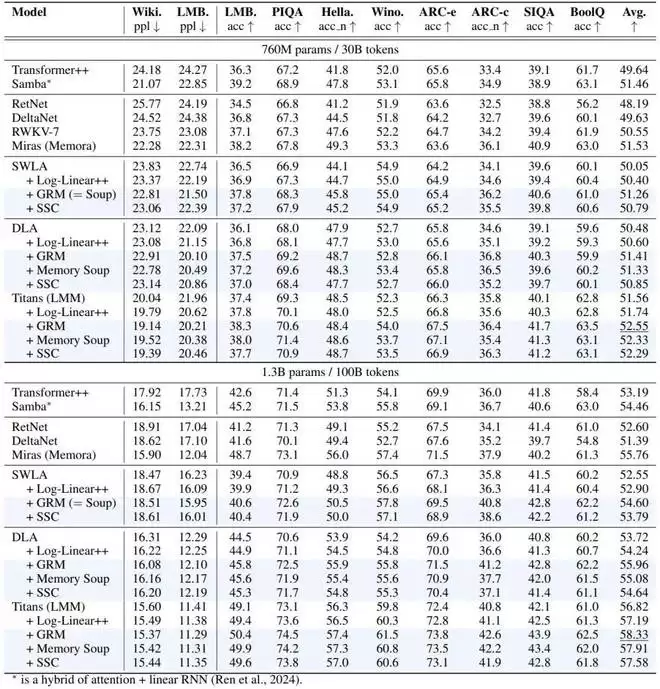

记忆缓存作为一个通用框架,可灵活集成到多种现有循环架构中,如线性注意力模型或深度记忆模型Titans。

实验基于13亿参数模型,涵盖了语言建模、召回密集型任务、长上下文理解等多个方面。结果显示,引入记忆缓存的模型性能普遍提升:

长上下文能力增强:在语言建模和长上下文理解任务中,配备记忆缓存的循环模型性能全面增强。

缩小与Transformer的差距:在关键的“上下文内召回”任务中,加入记忆缓存的模型超越了其他先进的循环模型。

性能上限对比:尽管记忆缓存显著改善了RNN的信息召回能力,缩小了与Transformer的性能差距,但论文指出,在极限密集召回任务上,Transformer仍保持最高的准确率上限。

总结:新路径开启,或影响技术格局

这项研究通过缓存历史状态快照这一直观思路,有效解决了循环架构在长程信息召回上的理论难题,为非Transformer架构的实用化推进了重要一步。

虽然其在极限密集召回能力上尚未完全超越Transformer,但一条清晰的新技术路径已然展现。随着RNN、状态空间模型等架构的持续演进,Transformer主导的市场格局未来可能面临新的变数。

侠游戏发布此文仅为了传递信息,不代表侠游戏网站认同其观点或证实其描述