AI 在现实中寻找到真正 N-Day 漏洞的表现如何?

来源:互联网 2026-04-18 10:17:32漏洞江湖中的“公开秘密”:N-Day漏洞 在网络安全领域,“N-Day漏洞”是一个关键概念。它指的是一个漏洞已被公开披露,相关概念验证代码(PoC)开始在网络上流传,安全社区普遍知晓其存在,但软件厂商尚未发布官方修复补丁的那段危险“空窗期”。 随之而来的问题是:在这些已知漏洞被修复前,究竟由谁来发现

漏洞江湖中的“公开秘密”:N-Day漏洞

在网络安全领域,“N-Day漏洞”是一个关键概念。它指的是一个漏洞已被公开披露,相关概念验证代码(PoC)开始在网络上流传,安全社区普遍知晓其存在,但软件厂商尚未发布官方修复补丁的那段危险“空窗期”。

随之而来的问题是:在这些已知漏洞被修复前,究竟由谁来发现它们?过去,这项工作主要依靠安全研究员、白帽黑客和专业的代码审计。如今,一个新的角色正在加入——AI模型。而N-Day-Bench,正是为测试AI这项能力而设计的“考场”。

长期稳定更新的攒劲资源: >>>点此立即查看<<<

一场“反常识”的能力测试

传统的AI编程测试通常侧重于编写代码、解决算法问题或回答编程提问。但这存在一个认知盲区:能写代码,并不等同于能发现漏洞。

即便一个模型在HumanEval等测试中获得高分,也未必能识别出一处缓冲区溢出风险。编写代码考验的是“创造”,而寻找漏洞考验的是“发现”——这是两种截然不同的思维模式。

N-Day-Bench的核心设计非常直接:提供一段真实代码和一个对应的CVE漏洞编号,然后考察模型能否独立定位漏洞的具体位置。

关键在于,这些漏洞都是在模型“知识截止日期”之后才被公开的。这考验的是真正的分析能力,而非记忆答案。如同在没有复习资料的情况下现场分析陌生代码并揪出隐藏问题,其难度和挑战性远超过解答标准习题。

榜单揭晓:模型表现参差

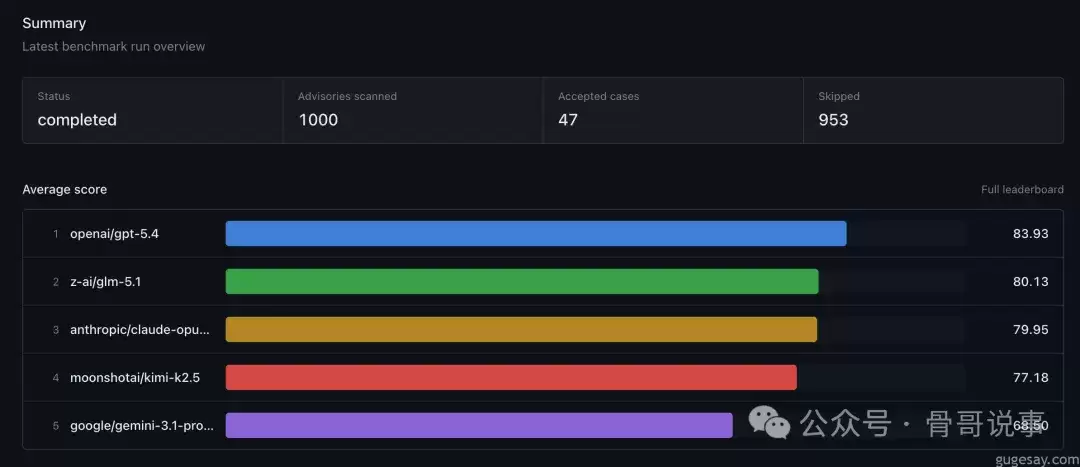

那么,考试结果如何?以下是近期N-Day-Bench榜单的简要情况:

领先的模型达到了约80%的准确率。这意味着模型已能独立定位大部分漏洞,但仍有约五分之一的漏洞可能被漏报或误报。

这大致相当于一位初级安全工程师的水平:能够承担实际工作,但尚需更有经验的同事进行复核。虽然距离“完全自动化”仍有差距,但已能作为高效的“第一防线”——快速扫描代码库、标记可疑点,再将最终判断交由人类。效率的提升是实实在在的。

几个值得关注的发现

闭源模型保持领先

榜单前三名——OpenAI、Anthropic、智谱,均为闭源或半闭源模型。这并非说明开源社区实力不足,而是在处理复杂推理、多步骤分析等任务上,闭源大厂凭借更广泛的预训练数据和更精细的调优,目前仍具优势。

国产模型表现突出

GLM-5.1取得80分的成绩,显示国内大模型在安全等垂直领域同样具备竞争力,并非仅限于聊天机器人场景。安全领域对深度推理能力要求极高,能在此取得好成绩,往往意味着其他方面的能力也不弱。

月度更新防“作弊”

漏洞环境是动态变化的。如果基准测试长期不更新,模型可能通过记忆“背答案”,失去测试意义。N-Day-Bench每月刷新测试用例的设计很巧妙,它迫使模型必须真正具备代码分析能力,而非依赖历史记忆。

一切仅是开端

目前47个有效测试用例是一个起点。未来还需要覆盖更多编程语言和漏洞类型。但这个方向无疑是正确的。

安全研究员会被取代吗?

或许有人会问:AI找漏洞已经如此厉害,安全研究员是否面临失业?

答案是否定的。

80%的准确率也意味着20%的漏报率。在真实攻防中,攻击者会采用各种对抗手段和代码混淆技术来绕过检测,这些层出不穷的“新套路”AI未必都能识别。更何况,发现漏洞只是第一步。

后续还需评估漏洞的实际影响(是否可被利用、破坏程度如何)、生成修复补丁、验证修复方案是否有效……这些环节的复杂性和挑战性,丝毫不亚于漏洞发现本身。

但AI确实从根本上改变了效率等式。

过去需要安全研究员耗费数小时人工审计的代码库,现在模型几分钟即可完成初步扫描。由AI标记高风险点,再由人类专家做最终裁决——这是一种生产力的质变,而非简单的岗位替代。正如现代医学中,AI可辅助医生快速阅读海量影像,但诊断签字权仍在医生手中。

更可能出现的未来图景是:安全研究员 + AI助手 = 超级个体。一个人就能完成过去需要一个团队才能覆盖的工作量。

结语

安全行业有句老话:防御者永远比攻击者更辛苦。因为攻击者只需找到一个突破口,而防御者必须守护整座城墙。

但现在,AI开始为防御者分担压力——它可以不知疲倦地在代码海洋中“巡逻”,捕捉人类容易忽略的细微异常。N-Day-Bench测试的是AI发现漏洞的能力,但其背后折射的,是整个安全行业游戏规则的变局。

漏洞研究不再只是极少数精英的专属技能。当AI作为新玩家加入这场博弈,原有的平衡正在被打破。那么,你准备好和AI成为队友了吗?

侠游戏发布此文仅为了传递信息,不代表侠游戏网站认同其观点或证实其描述