ДѓФЃаЭМмЙЙЕФЯТАыГЁ

РДдДЃКЛЅСЊЭј 2026-04-21 19:13:31ЩюЖШРЉеЙЕФвўгЧЃКЕБВуЪ§діГЄдтгіЭЃжЭЕФЭЈаХ Й§ШЅЪЎФъЃЌЩюЖШбЇЯАСьгђЕФНјеЙзёбзХвЛжжИпЖШвЛжТЕФЗЖЪНЃКзЗЧѓИќДѓЙцФЃЁЃЮоТлЪЧФЃаЭВЮЪ§ЁЂбЕСЗЪ§ОнЛЙЪЧЩЯЯТЮФГЄЖШЃЌЖМдкГжајРЉеЙЁЃетвЛВпТдГЩаЇЯджјЃКЫ№ЪЇКЏЪ§ГжајЯТНЕЃЌФЃаЭФмСІВЛЖЯдіЧПЃЌРЉеЙЖЈТЩЮЊбаОПЭХЖгЬсЙЉСЫЧхЮњЕФзЪдДЭЖШыжИв§ЁЃ ШЛЖјЃЌВЛЭЌЕФРЉеЙЗНЯђЃЌЦфММЪѕФкКгыЪЕ

ЩюЖШРЉеЙЕФвўгЧЃКЕБВуЪ§діГЄдтгіЭЃжЭЕФЭЈаХ

Й§ШЅЪЎФъЃЌЩюЖШбЇЯАСьгђЕФНјеЙзёбзХвЛжжИпЖШвЛжТЕФЗЖЪНЃКзЗЧѓИќДѓЙцФЃЁЃЮоТлЪЧФЃаЭВЮЪ§ЁЂбЕСЗЪ§ОнЛЙЪЧЩЯЯТЮФГЄЖШЃЌЖМдкГжајРЉеЙЁЃетвЛВпТдГЩаЇЯджјЃКЫ№ЪЇКЏЪ§ГжајЯТНЕЃЌФЃаЭФмСІВЛЖЯдіЧПЃЌРЉеЙЖЈТЩЮЊбаОПЭХЖгЬсЙЉСЫЧхЮњЕФзЪдДЭЖШыжИв§ЁЃ

ШЛЖјЃЌВЛЭЌЕФРЉеЙЗНЯђЃЌЦфММЪѕФкКгыЪЕЯжФбЖШДцдкЯджјВювьЁЃађСаГЄЖШЕФРЉеЙЭљЭљашвЊеце§ЕФЛњжЦДДаТЃЌВЂвбДпЩњГіЯЕЭГЕФЙЄГЬгХЛЏЁЃЪ§ОнЙцФЃЕФРЉеЙдђЯрЖджБНгЃКИќЖрЪ§ОнЭЈГЃвтЮЖзХИќЕЭЕФЫ№ЪЇЁЃЯрБШжЎЯТЃЌдіМгФЃаЭЕФПэЖШгыЩюЖШЃЌБэУцЩЯЫЦКѕгыЪ§ОнРЉеЙвЛбљМђЕЅжБНгЁЃ

ГЄЦкЮШЖЈИќаТЕФдмОЂзЪдДЃК >>>ЕуДЫСЂМДВщПД<<<

ЕЋПэЖШгыЩюЖШецЕФдкЭЌЕШГЬЖШЩЯЗЂЛгзїгУТ№ЃП

Д№АИЪЧЗёЖЈЕФЁЃФЃаЭЕФЩюЖШдкЪ§СПЩЯЪЕЯжСЫдіГЄЃЌЕЋдкжЪСПВуУцШДЮДЭЌВНЬсЩ§ЁЃНќЪЎФъРДЃЌЩёОЭјТчВугыВужЎМфЕФКЫаФЭЈаХЛњжЦВЂЮДЗЂЩњИљБОадБфИяЁЃетвЛЯжЯѓжСЙиживЊЃЌЫќВЛНіНвЪОСЫЩюЖШРЉеЙБОЩэЕФЦПОБЃЌИќЭЙЯдСЫЩёОЭјТчМмЙЙЩшМЦжаЕФвЛИіЦеБщУЄЧјЁЃ

баОПЩчЧјЭЖШыСЫЪЎФъЪБМфРЉеЙВуФкЕФМЦЫуФмСІЃЌШДЮДФмЭЌВНЬсЩ§ВуМфЕФЭЈаХФмСІЁЃетвЛЯжзДиНД§ИФБфЁЃ

РЉеЙЕФЩЯАыГЁЃКГЩЙІгыОжЯо

вЊРэНтЩЯАыГЁЕФГЩЙІжЎДІЃЌзюМбЗНЪНЪЧЩѓЪгФФаЉЮЌЖШБЛгааЇРЉеЙЃЌвдМАЦфЪЕЯжТЗОЖЁЃ

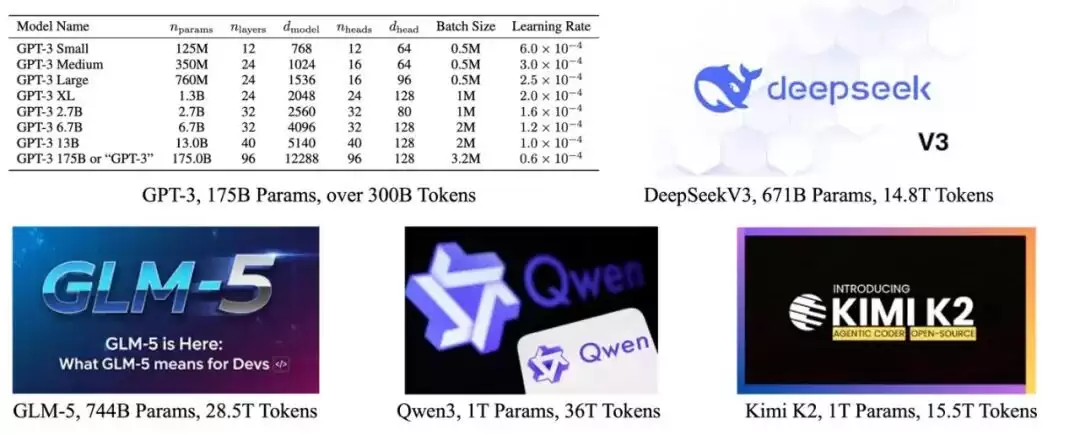

ЪзЯШЪЧађСаГЄЖШЁЃдчЦкЕФTransformerФЃаЭНіФмДІРэЪ§АйИіtokenЁЃвЊЪЕЯж128KЩѕжСИќГЄЕФЩЯЯТЮФЃЌашвЊдкЖрИіЗНЯђГжајДДаТЃКаТЕФзЂвтСІЛњжЦЃЈШчЯЁЪшЁЂЯпадЁЂЛьКЯзЂвтСІЃЉЁЂЯЕЭГЙЄГЬгХЛЏЃЈР§ШчFlashAttentionЃЉЁЂвдМАЮЛжУБрТыЕФИФНјЃЈШчRoPEРЉеЙЃЉЁЃбаОПепКЭЙЄГЬЪІЙВЭЌЙЙНЈСЫвЛИіГжајбнНјЕФЩњЬЌЃЌВЛЖЯгХЛЏtokenМфЕФаХЯЂСїЖЏЗНЪНЁЃЦфЛиБЈЪЧЯджјЕФЃЌВЛНіЪЙФЃаЭФмЙЛДІРэГЌГЄЮФЕЕЃЌвВЮЊOpenAI-O1КЭDeepSeek-R1ЕШФЃаЭЕФГЄСДЭЦРэФмСІЕьЖЈСЫМсЪЕЛљДЁЁЃете§ЪЧЕБЭХЖгШЯецЭЖзЪгкЁАађСаЮЌЖШаХЯЂСїЖЏЗНЪНЁБЪБЫљЛёЕУЕФЗсКёЛиБЈЁЃ

ЁїЯжДњДѓгябдФЃаЭжаВЮЪ§гыЪ§ОнЙцФЃЕФдіГЄЧїЪЦ

ВЮЪ§гыЪ§ОнЙцФЃЕФРЉеЙЃЌдђзюЗћКЯШЫУЧЕФжБОѕЁЃздЩюЖШбЇЯАаЫЦ№жЎГѕЃЌОЕфНЬГЬБуДЋЪкзХЭЌвЛЬзХфЗНЃКИќЖрЕФЪ§ОнЁЂИќПэЕФВуЁЂИќЩюЕФЭјТчЃЌздШЛДјРДИќЧПЕФБэеїФмСІЁЃДгGPT-2ЕФ15вкВЮЪ§ЕНШчНёЕФЪ§ЭђвкЙцФЃЃЌетЬзХфЗНГжајгааЇЁЃетЫЦКѕБэУїЃЌДѓФЃаЭЭХЖгЮоашв§ШыаТЛњжЦЃЌжЛашбизХвббщжЄЕФЗНЯђГжајЭиеЙМДПЩЁЃ

ШЛЖјЃЌЖдгкЩёОЭјТчЖјбдЃЌЁАИќПэЁБгыЁАИќЩюЁБВЂЗЧЕШЭЌЁЃПэЖШЕФРЉеЙЪЧздШЛЕФЃКЯжДњGPUЬьЩњЩУГЄДІРэПэОиеѓГЫЗЈЃЌзЂвтСІЛњжЦЕФбнНјвВШевцИпаЇЃЌЪЙЕУИќПэЕФЭјТчФмЮоЗьШкШыЯжгаМмЙЙЁЃ

ЩюЖШЕФРЉеЙдђЪЧСэвЛЛиЪТЁЃФЃаЭВуЪ§ШЗЪЕдкдіМгЃКДгМИЪЎВудіжСЩЯАйВуЁЃЕЋВуМфЭЈаХЕФКЫаФЛњжЦЃЌБОжЪЩЯШдЪЧResNetгк2015ФъЬсГіЕФЩюЖШВаВюСЌНгЃЌМДОЕфЕФЁАx + F(x)ЁБЙЋЪНЁЃздЦфЕЎЩњвдРДЃЌЫфгаЙ§жюЖрИФНјЃЈШчЙщвЛЛЏЮЛжУЁЂВаВюЫѕЗХЁЂПчВуСЌНгЃЉЃЌЕЋУЛгаШЮКЮИФНјеце§КГЖЏФЧИіЁА+ЁБКХдкЩюЖШВаВюжаЕФОіЖЈадЕиЮЛЁЃ

ВаВюСЌНгЮовЩЪЧЩюЖШбЇЯАЕФЛљЪЏжЎвЛЁЃУЛгаЫќЃЌБуВЛЛсгаЩЯАйВуЕФTransformerЁЂЯжДњДѓгябдФЃаЭЃЌФЫжСЫљЮНЕФРЉеЙЖЈТЩЁЃЕЋЛљДЁЗНАИГЃгавЛИіЬиЕуЃКЫќУЧгаЪБЛсБфЕУЙ§гквўаЮЃЌвджСгкЮоШЫдйШЅжЪвЩЫќОПОЙЪЧзюгХНтЃЌЛЙЪЧНіНіЪЧЬНЫїГѕЦкевЕНЕФЕквЛИіПЩааЗНАИЁЃ

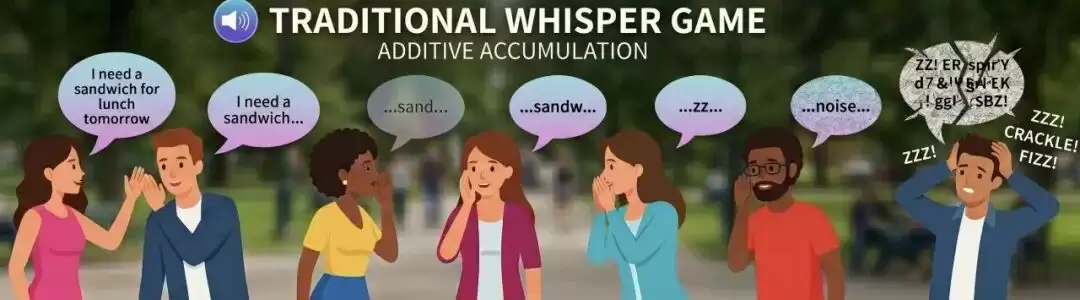

ПЩвдНЋЦфРрБШЮЊвЛИігаЬиЪтЙцдђЕФДЋЛАгЮЯЗЁЃдкБъзМАцБОжаЃЌЕк1ИіШЫЯђЕк2ИіШЫЖњгяЃЌЕк2ИіШЫдйДЋИјЕк3ИіШЫЁЃДЋЕНЕк18ИіШЫЪБЃЌаХЯЂдчвбЪЇецЁЃетБуЪЧВЛДјВаВюСЌНгЕФЩюВуЭјТчЃКУПвЛВужЛФмПДЕНЧАвЛВуЕФЪфГіЁЃ

ВаВюСЌНгаоИДСЫДЫЮЪЬтЃКУПИіШЫдкДЋЕнздЩэРэНтЕФЭЌЪБЃЌвВНЋжЎЧАРлЛ§ЕФдЪМаХЯЂдЗтВЛЖЏЕиЯђЯТДЋЕнЁЃЕк3ИіШЫМШФмЬ§ЕНЕк2ИіШЫЕФаТНтЖСЃЌвВФмЬ§ЕНжЎЧАЕФЫљгаФкШнЁЃдЪМаХКХЪМжеБЛБЃСєЃЌГЩЮЊВЛЖЯзГДѓЕФКЯГЊжаЕФвЛИіЩљВПЁЃ

ЕЋЮЪЬтЫцжЎЖјРДЃКЕНСЫЕк152ИіШЫЃЌФуЭЌЪБЬ§ЕНЕФЪЧ152ИіЩљвєЕФЛьКЯЁЊЁЊдЪМаХЯЂМгЩЯЧА151ВуЕўМгЕФФкШнЃЌШЋВПЛьдггквЛОфЖњгяжаЁЃРэТлЩЯЃЌЧАУцЫљгаШЫЕФЩљвєвРШЛДцдкЃЌЕЋЫќУЧвбБЛбЭУЛЁЃШчЙћЕк152ИіШЫашвЊШЗЧажЊЕРЕк3ИіШЫЫЕСЫЪВУДЃЌЫћБиаыЗбСІЕиДгетКъДѓЕФКЯГЊжаНЋЦфЗжБцГіРДЁЃ

ЁїдкаХЯЂРлМгЕФДЋЛАгЮЯЗжаЃЌППКѓЕФВЮгыепФбвдЗжБцЫљашЕФОпЬхФкШн

ЭЈГЃЃЌЕк152ИіШЫЪЧзіВЛЕНетвЛЕуЕФЁЃ

етОЭЪЧаХЯЂЯЁЪЭЯжЯѓЁЃУПвЛВуЖМУцСйСНФбЃКШєИУВуЙБЯзаТаХЯЂЃЌдђПЩФмбкИЧжЎЧАЕФФкШнЃЛШєбЁдёБЃЪиЃЌдђФмБЃСєЧАВуДЋЕнЕФвбгааХЯЂЁЃдкДЫзДПіЯТЃЌаэЖрВубЇЛсСЫЁАБЃГжГСФЌЁБЃЌМИКѕВЛЯђВаВюСїжааДШыЪЕжЪадЕФаТФкШнЁЃетбљЕФЩюЖШЭјТчдкжНУцЩЯКмЩюЃЌЪЕМЪЩЯШДКмЧГЁЃЭХЖгЖбЕўСЫ152ВуЃЌЕЋЦфжааэЖрВуШДЮДЗЂЛгЪЕжЪзїгУЁЃ

ЦПОБВЂЗЧдДгк152ВуЭјТчЫљашЕФМЦЫуСІЃЌЖјдкгкаХЯЂДЉдНетаЉВуЕФЭЈаХФмСІЁЃCPUЕФЗЂеЙдкМИЪЎФъЧАБузВЩЯЙ§ЭЌбљЕФЧНЃКДІРэЦїЫйЖШВЛЖЯЬсЩ§ЃЌжБжСФкДцДјПэГЩЮЊЦПОБЃЌЦШЪЙећИіаавЕзЊЯђЛКДцгыЭЈаХгХЛЏЁЃзщжЏЙмРэврШЛЃКвЛШКДЯУїШЫЕФМЏЬхДДдьСІЃЌЭЌбљЪмЯогкЫћУЧжЎМфЕФЙЕЭЈгыазїаЇТЪЁЃЩюЖШбЇЯАе§дкОРњздЩэЕФАцБОЃКЪЎФъРДГжајдіЧПУПвЛВуЕФФмСІЃЌЖјВугыВужЎМфЕФЭЈЕРЃЌШДЪМжеЪЧ2015ФъФЧЬѕЁАЕЅГЕЕРЙЋТЗЁБЁЃ

ФЧУДЃЌЪЧЗёДцдкИќКУЕФЛњжЦЃП

ЯжгаИФНјЗНАИМАЦфОжЯо

дкЯрЙибаОПжЎЧАЃЌвбгааэЖрбаОПепзЂвтЕНЩюЖШЦПОБЮЪЬтЁЃЖрФъРДЃЌаоВЙЗНАИШеЧїОЋЧЩЃКР§ШчЛёЕУCVPRзюМбТлЮФЕФDenseNetЃЌЫќБЃСєСЫУПвЛВуЕФЪфГіЃЌЕЋДњМлЪЧЦНЗНМЖЕФПЊЯњЁЃВЩгУПЩбЇЯАМгШЈЕФЗНАИЃЌШчDenseFormerЁЂLIMeЃЌНЕЕЭСЫГЩБОЃЌЕЋбЕСЗЭъГЩКѓШЈжиМДЙЬЖЈЃЌУПИіtokenЁЂУПжжЩЯЯТЮФЖМЪЙгУЯрЭЌШЈжиЃЌШБЗІСщЛюадЁЃ

зжНкЬјЖЏЕФHyper-ConnectionsгыDeepSeekЕФmHCСэБйѕшОЖЃЌНЋЭЈаХЙмЕРЭиПэжСNИіЭЈЕРЃЌВуМфЭЈЙ§ЛьКЯОиеѓСЌНгЃЌЯрЕБгкдкаХЯЂИпЫйЙЋТЗЩЯЭЌЪБПЊБйЖрЬѕГЕЕРЁЃЕЋВЛзужЎДІдкгкЃЌаХЯЂШдашж№ВуСїЖЏЃЌЕк152ВуШдЮоЗЈжБНгЛиЫнжСЕк3ВуЛёШЁаХЯЂЁЃ

ВЪдЦЙЋЫОЕФMUDDFormerЪЕЯжСЫЛьКЯУПВуЪфГіЕФЖЏЬЌЛЏЃЌЫќФмИљОнУПИіtokenЕФБэеїЩњГЩШЈжиЁЃетдкИљБОЗНЯђЩЯЪЧЖдЕФЃКДгУПвЛВуМГШЁЖрЩйаХЯЂЃЌБОгІШЁОігке§дкДІРэЕФФкШнЁЃЕЋЭЌбљДцдкОжЯоЃКЕк152ВудкОіЖЈДгЕк3ВуМГШЁЖрЩйаХЯЂЪБЃЌНівРРЕгкЕк152ВуздЩэЕФзДЬЌЃЌЫќВЂВЛжЊЯўЕк3ВуЪЕМЪАќКЌСЫЪВУДЁЃЫќЪЧдкдЄВтФФаЉВуПЩФмгагУЃЌЖјЗЧеце§ЁАВщПДЁБЦфФкШнЁЃ

ЯРгЮЯЗЗЂВМДЫЮФНіЮЊСЫДЋЕнаХЯЂЃЌВЛДњБэЯРгЮЯЗЭјеОШЯЭЌЦфЙлЕуЛђжЄЪЕЦфУшЪі

ЯрЙиЙЅТд

ИќЖрЭЌРрИќаТ

ИќЖрШШгЮЭЦМі

ИќЖр-

- КНЬьЛ№М§ФЃФтЦї

- Android/ | ФЃФтбјГЩ

- 2026-04-07

-

- УќдЫЦяЪПЭХ

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

-

-

-

-

- зЙаЧДѓТН ТђЖЯАц

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

- ЯцICPБИ14008430КХ-1 ЯцЙЋЭјАВБИ 43070302000280КХ

- All Rights Reserved

- БОеОЮЊЗЧгЏРћЭјеОЃЌВЛНгЪмШЮКЮЙуИцЁЃБОеОЫљгаШэМўЃЌЖМгЩЭјгб

- ЩЯДЋЃЌШчгаЧжЗИФуЕФАцШЈЃЌЧыЗЂгЪМўИјxiayx666@163.com

- ЕжжЦВЛСМЩЋЧщЁЂЗДЖЏЁЂБЉСІгЮЯЗЁЃзЂвтздЮвБЃЛЄЃЌНїЗРЪмЦЩЯЕБЁЃ

- ЪЪЖШгЮЯЗвцФдЃЌГСУдгЮЯЗЩЫЩэЁЃКЯРэАВХХЪБМфЃЌЯэЪмНЁПЕЩњЛюЁЃ