掌握这五个AI核心术语,你已经碾压90%的人!

来源:互联网 2026-04-23 17:43:09别再只会用AI!真正拉开差距的5个底层概念 聊起AI,一个有趣的现象是:很多人要么停留在概念名词的表面,要么一听到LLM、神经网络这些术语就自动静音。问题从来不是信息太少,而是理解太浅。真正的分水岭,不在于你是否用过AI,而在于你是否理解它究竟是如何运作的。 把下面这五个概念真正吃透,你在绝大多数场

别再只会用AI!真正拉开差距的5个底层概念

聊起AI,一个有趣的现象是:很多人要么停留在概念名词的表面,要么一听到LLM、神经网络这些术语就自动静音。问题从来不是信息太少,而是理解太浅。真正的分水岭,不在于你是否用过AI,而在于你是否理解它究竟是如何运作的。

把下面这五个概念真正吃透,你在绝大多数场合下,就不再只是“会用工具的人”,而是“理解工具的人”。差距,往往就从这里开始拉开。

长期稳定更新的攒劲资源: >>>点此立即查看<<<

别再只会提问:Token才是AI的最小单位

很多人下意识地认为AI在“读句子”,甚至是在“理解语义”。但实际情况要更底层一些。

AI既不读单词,也不读字母,它处理的是Token(标记)。你可以把它理解为“文本切片”。举个例子,一句话:

I love pizza在模型内部,可能会被拆解成:

"I" | " love" | " pizza"这些“片段”就是token。有的token对应完整单词,有的可能只是词的一部分,比如“un”、“tion”,甚至标点符号本身也是一个token。

为什么你必须理解它?

因为所有AI产品的底层成本与能力边界,都与token息息相关:输入token越多,处理成本就越高;输出token越多,费用自然越贵;而所谓的上下文长度,本质就是一次性能处理的token数量上限。

可以说,Token就是AI世界里的“原子”。

理解这一点后,很多现象就说得通了:为什么提示词(prompt)越精简往往越有效?为什么长对话进行到后面AI会“忘记”开头的内容?为什么API接口普遍按token计费?答案都藏在这个最基础的单元里。

别再以为AI会一直记住:Context Window的真实限制

想象一下,你在和一个人聊天,但他有个奇怪的特质:只能记住最近一段对话,之前的记忆会被全部清空。这就是上下文窗口(Context Window)的直观比喻。

它的本质是:模型一次能“看到”的最大token数量。你可以把它想象成一块白板。白板越大,能写下的内容就越多;一旦写满了,就必须擦掉旧的内容才能写下新的。

模型一次能“看到”的最大token数量。

现实中的影响

小模型可能只有4K token的窗口,只能处理几页文档;而大模型可以达到200K甚至更多,足以“吞下”一整本书。这也解释了为什么有时AI会“突然变傻”,或者在长对话后逻辑开始混乱——并非它的能力下降了,而是早期信息已经被挤出了当前的上下文窗口。

早期信息已经被挤出上下文了。

实战建议

如果你正在处理长文总结、多轮推理或复杂文档分析,一定要意识到:AI不是“忘记”了,而是“看不到了”。在设计交互流程时,必须将这个限制考虑在内。

别再随机出奇迹:Temperature决定输出风格

Temperature(温度)是一个常被低估却至关重要的参数。它控制的是模型输出的“随机程度”。

输出的“随机程度”。

可以简单理解为:温度越低,输出越确定、保守;温度越高,输出越随机、富有创意。举个例子,给定开头“The cat sat on the ...”,低温度下模型很可能输出“mat”或“floor”;而高温度下,它或许会给出“a collapsing empire of Tuesday”这样天马行空的句子。

怎么用才对?

这里有一条非常关键的使用规则:进行事实类任务时,比如总结、写代码、信息抽取,应使用低温度,以确保结果的准确性和一致性。而在进行创意类任务时,比如撰写文案、头脑风暴、小说创作,则可以适当提高温度,以激发更多样化的想法。

很多人感觉AI输出不稳定,其实问题未必出在模型本身,而可能是用错了“思维模式”。

用错了“思维模式”。

别再盲目信任:Hallucination的本质不是“出错”

大多数人都听说过“AI会产生幻觉”,但重点常常被理解错了。所谓Hallucination(幻觉),指的是AI用极其自信的语气,说出完全错误的信息,比如引用一本不存在的书、虚构一位作者,或编造一段历史。

AI用极其自信的语气,说出完全错误的信息。

关键问题不在于“它会犯错”,而在于它“错得跟真的一样”,极具迷惑性。

它“错得像真的一样”。

为什么会这样?

根源在于,AI本质上不是一个数据库。它的核心任务只有一个:预测下一个最可能出现的token。当它面对未知信息时,并不会回答“我不知道”,而是会生成一段“看起来最像正确答案”的内容。

生成一个“看起来最像正确答案”的内容。

正确使用方式

务必记住这个定位:AI是强大的内容生成器,而非可靠的事实源。因此,它可以用来启发思路、生成初稿,但绝不能不经核查就直接当作最终结论。尤其在医疗、法律、数据分析等严肃领域,二次验证是必不可少的步骤。

AI是生成器,不是事实源。

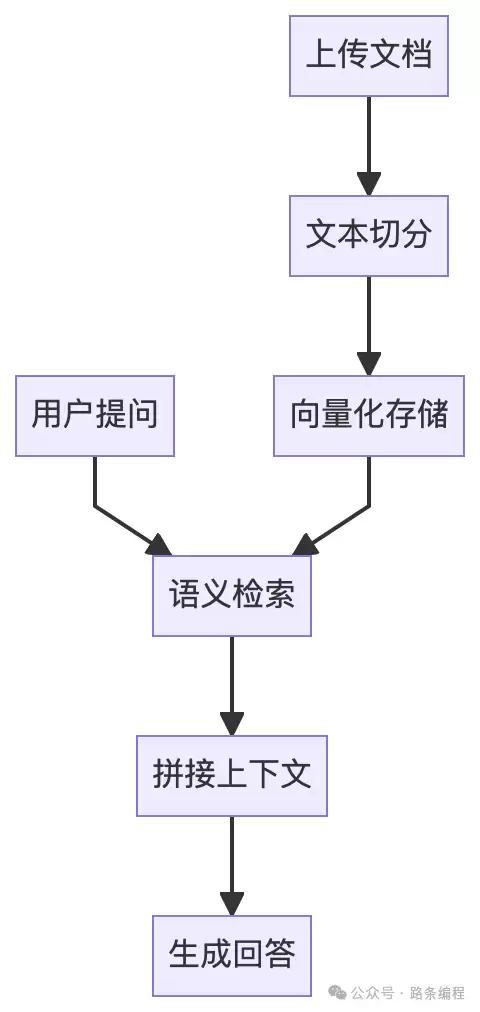

别再以为AI懂你数据:RAG才是关键机制

市面上很多产品宣称能够“读取你的PDF”或“理解你的企业数据”,听起来仿佛是模型瞬间学会了新知识。其实不然,这背后的核心技术是RAG(检索增强生成)。

RAG(检索增强生成)

它到底在做什么?

流程其实相当清晰:

1. 文档拆分

将你的文件切分成小块。

2. 向量化存储

将这些文本块转化为向量,存入数据库。这一步的关键在于理解语义,而非简单匹配关键词。

3. 查询时检索

当用户提问时,系统根据问题从数据库中检索出最相关的文本片段。

4. 拼接上下文给AI

将这些检索到的片段作为补充上下文,与问题一同提交给大模型,让它基于此生成答案。

看流程

本质总结

RAG所做的,并非直接“让AI变得更聪明”,而是为AI提供更精准、更相关的参考资料。模型本身的能力没有改变,改变的是输入给它的信息质量。

给AI提供更精准的参考资料。

为什么重要?

过去两年中,几乎所有具备实用价值的AI产品,如智能客服、文档问答、企业知识库、研究助手,其核心架构本质上都是RAG的某种应用。理解RAG,你就能看透这些产品的“能力边界究竟在哪里”。

AI产品的“能力边界在哪里”。

别再停留在“会用”:真正的差距在理解

表面上看,这五个概念只是一组术语。但一旦将它们串联起来,你就会得到一套完整的认知框架:Token决定了成本与输入结构,Context Window划定了记忆范围,Temperature设定了输出风格,Hallucination警示了可信度边界,而RAG则揭示了知识来源的机制。

你不需要成为工程师,但必须清楚一个事实:AI不是魔法,它是一个有内在规则和限制的系统。当大多数人还在试探“AI能不能帮我做点什么”的时候,真正拉开差距的人,已经在深入思考:眼前这个结果,究竟是模型本身的能力,还是上下文巧妙设计的产物?

这个结果,是模型能力,还是上下文设计?

理解其运行机制的人,是在驾驭AI。而不理解的人,或许只是在被AI的使用体验所牵引。这,才是认知层面上真正的分水岭。

侠游戏发布此文仅为了传递信息,不代表侠游戏网站认同其观点或证实其描述