ФкДцДЂЦїИХЪіЪЧЪВУДвтЫМЃП

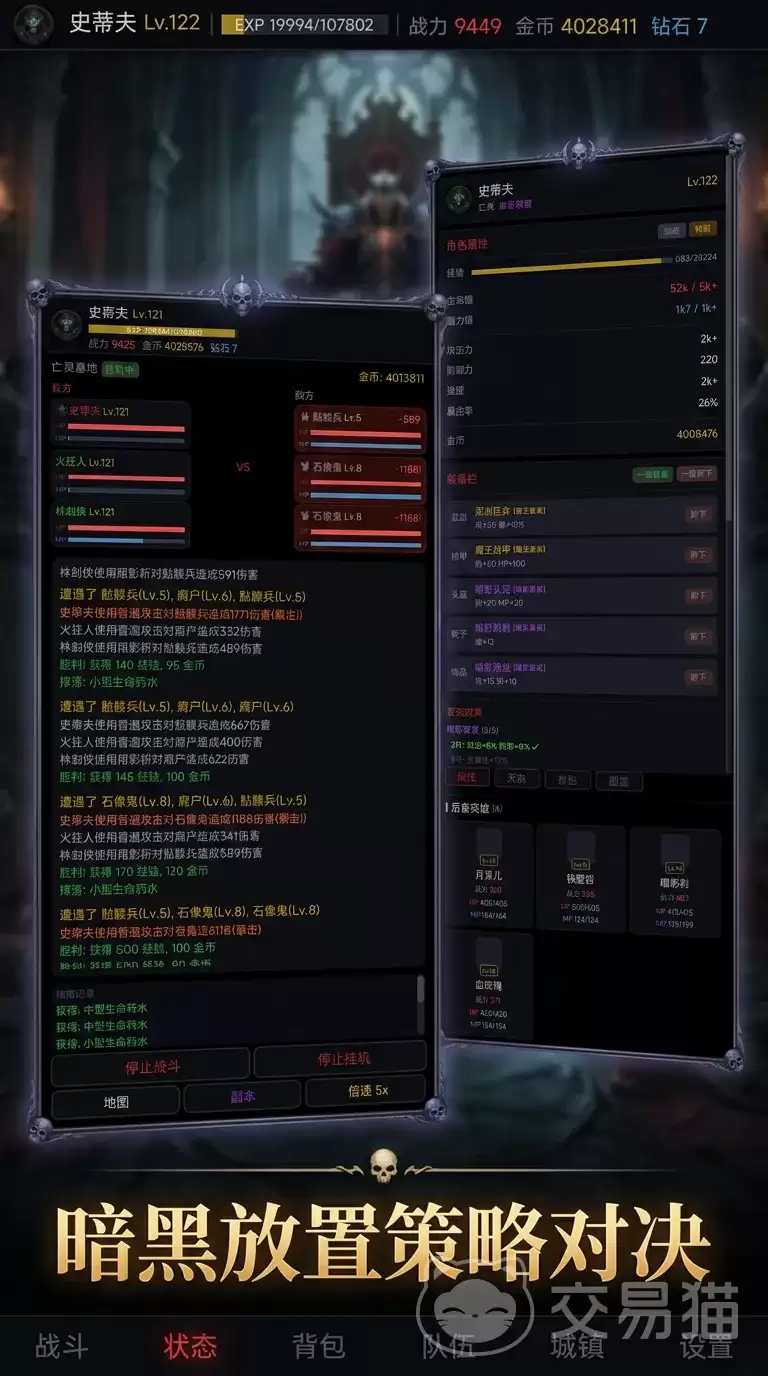

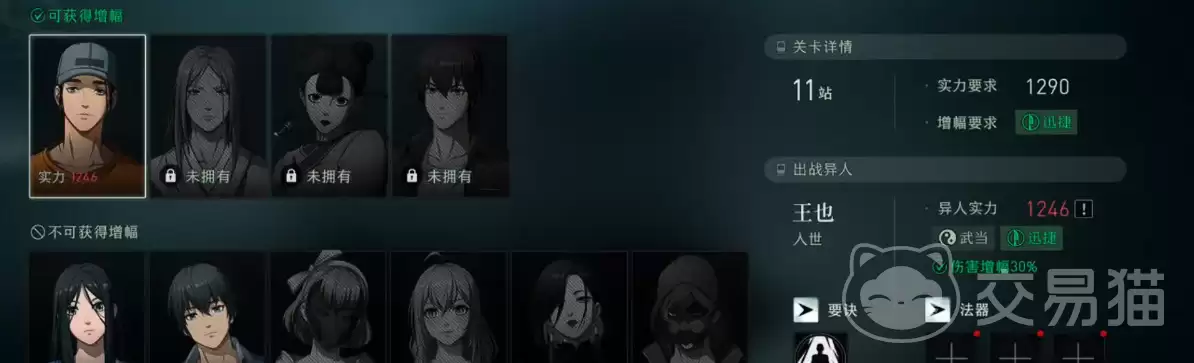

РДдДЃКЛЅСЊЭј 2026-04-25 09:26:10ФкДцДЂЦїЃКЫуСІЯЕЭГЕФЁАИпЫйЪрХІЁБгыЁАСйЪБЙЄзїЬЈЁБ ЫЕЕНМЦЫуЛњЕФадФмЃЌДѓМвГЃЙизЂCPUКЭЯдПЈЃЌЕЋеце§ОіЖЈЯЕЭГЯьгІЫйЖШКЭСїГЉЖШЕФЃЌЭљЭљЪЧвЛИіШнвзБЛКіЪгЕФВПМўЁЊЁЊФкДцДЂЦїЁЃЫќПЩВЛЪЧвЛИіМђЕЅЕФЁАСйЪБВжПтЁБЃЌЖјЪЧвЛИігЩRAMЁЂROMКЭCacheаЭЌзїеНЕФОЋУмЗжВуЬхЯЕЁЃМђЕЅРДЫЕЃЌRAMИКд№ГЬађдЫааЪБЕФЪ§ОнжазЊЃЌ

ФкДцДЂЦїЃКЫуСІЯЕЭГЕФЁАИпЫйЪрХІЁБгыЁАСйЪБЙЄзїЬЈЁБ

ЫЕЕНМЦЫуЛњЕФадФмЃЌДѓМвГЃЙизЂCPUКЭЯдПЈЃЌЕЋеце§ОіЖЈЯЕЭГЯьгІЫйЖШКЭСїГЉЖШЕФЃЌЭљЭљЪЧвЛИіШнвзБЛКіЪгЕФВПМўЁЊЁЊФкДцДЂЦїЁЃЫќПЩВЛЪЧвЛИіМђЕЅЕФЁАСйЪБВжПтЁБЃЌЖјЪЧвЛИігЩRAMЁЂROMКЭCacheаЭЌзїеНЕФОЋУмЗжВуЬхЯЕЁЃМђЕЅРДЫЕЃЌRAMИКд№ГЬађдЫааЪБЕФЪ§ОнжазЊЃЌЬиЕуЪЧЫйЖШПьЕЋЖЯЕчМДЪЇЃЛROMРяЙЬЛЏзХЦєЖЏЯЕЭГЕФЛљДЁжИСюЃЌШЗБЃЛњЦїФмЮШЖЈПЊЛњЃЛЖјCacheдђЪЧCPUЩэБпЕФЁАЩСЕчЛКГхЧјЁБЃЌзЈУХгУРДдЄДцИпЦЕжИСюЃЌДѓЗљМѕЩйЕШД§ЪБМфЁЃИљОнаавЕБъзМЃЌШчНёжїСїPCвбНјШыDDR5ЪБДњЃЌДјПэЧсЫЩЭЛЦЦ64GB/sЃЌбгГйвВгХЛЏЕНСЫCL30МЖБ№ЃЛЗўЮёЦїСьгђИќЪЧЧАбиЃЌе§дкМгЫйВПЪ№ДјОРДэЙІФмЕФRDIMMКЭгЕгаГЌИпДјПэЕФHBM3ЖбЕўФкДцЁЃДгФкДцПХСЃЁЂSPDаОЦЌЕНPCBЕчТЗКЭН№ЪжжИЃЌУПвЛИіЮяРэЛЗНкЖМзёбзХбЯПСЕФЕчЦјЙцЗЖЃЌЙВЭЌжЇГХзХДгШеГЃАьЙЋЕНИпЧПЖШAIбЕСЗЕФШЋГЁОАЫуСІашЧѓЁЃ

ГЄЦкЮШЖЈИќаТЕФдмОЂзЪдДЃК >>>ЕуДЫСЂМДВщПД<<<

вЛЁЂФкДцДЂЦїЕФКЫаФЙІФмгыЙЄзїТпМ

ФкДцДЂЦїЕФКЫаФЪЙУќЃЌОЭЪЧдкИпЫйЕФCPUКЭЯрЖдЕЭЫйЕФЭтВПЩшБИЃЈБШШчгВХЬЃЉжЎМфЃЌДюНЈвЛзљЁАЪ§ОнСЂНЛЧХЁБЁЃЕБФуДђПЊвЛИіШэМўЃЌВйзїЯЕЭГЛсЕквЛЪБМфАбЫљашЕФГЬађжИСюКЭЪ§ОнЃЌДггВХЬАсдЫЕНRAMЕФЬиЖЈЕижЗПеМфРяЁЃЫцКѓЃЌCPUЭЈЙ§ЕижЗзмЯпОЋзМЖЈЮЛЃЌдйОгЩЪ§ОнзмЯпЭъГЩЖСаДЃЌећИіЙ§ГЬЖМдкФЩУыМЖБ№ФкЭъГЩЁЃОйИіР§згЃЌдЫаавЛИіAIЭМЯёЩњГЩЙЄОпЪБЃЌХгДѓЕФФЃаЭВЮЪ§ЛсБЛЗжПщМгдиЕНDDR5ФкДцЕФЖрИіДцДЂЬхжаЃЌSPDаОЦЌдђЪЕЪБЯђжїАхБЈИцзюМбЙЄзїЪБађЃЌШЗБЃФкДцПижЦЦїФмвдCL30МЖБ№ЕФЕЭбгГйОЋзМЕїЖШЪ§ОнЁЃгыДЫЭЌЪБЃЌCacheЛсжЧФмдЄВтCPUНгЯТРДПЩФмашвЊЪВУДЃЌЬсЧААбИпЦЕЪЙгУЕФМЦЫуНсЙћЃЈБШШчФГаЉМЄЛюКЏЪ§жЕЃЉднДцдкL3ЛКДцРяЁЃетвЛЬзЁАдЄВтЁЂМгдиЁЂжДааЁЂЪЭЗХЁБЕФаадЦСїЫЎАуЕФВйзїЃЌе§ЪЧФкДцПижЦЦїгыВйзїЯЕЭГФкДцЙмРэФЃПщНєУмазїЕФНсЙћЁЃ

ЖўЁЂжїСїРраЭЕФММЪѕВювьгыЪЪгУГЁОА

ФкДцЕФжїЬхRAMЃЌжївЊЗжЮЊDRAMКЭSRAMСНДѓеѓгЊЁЃЮвУЧЪьЯЄЕФЯћЗбМЖDDR5ФкДцОЭЪєгкDRAMЃЌЫќРћгУЕчШнДцДЂЕчКЩЃЌашвЊЖЈЪБЫЂаТРДБЃГжЪ§ОнЃЌЕЅПХаОЦЌЕФШнСПЯждкФмзіЕН16GbЃЌЕЋашвЊХфЬзЕчТЗРДЮЌГжЕчбЙЮШЖЈЁЃЖјCPUФкжУЕФИїМЖЛКДцЃЈШчL3 CacheЃЉдђВЩгУSRAMЃЌЫќНсЙЙИќИДдгЁЂГЩБОИќИпЃЌЕЋгХЪЦЪЧЮоашЫЂаТЁЂЫйЖШМЋПьЃЌЫљвджЛБЛЁАЩнГоЁБЕиАВжУдкCPUКЫаФжмЮЇЁЃжСгкROMЃЌЫќЫфШЛВЛВЮгыШеГЃдЫЫуЃЌЕЋРяУцДцДЂЕФUEFIЙЬМўЪЧгВМўЦєЖЏЕФЁАзмжИЛгЁБЃЌжБНгЙиЯЕЕНЯЕЭГГѕЪМЛЏЕФПЩППадЃЌЯждкжїАхЦеБщВЩгУЕФSPI Flash ROMвбОжЇГжАВШЋЦєЖЏКЭЙЬМўЛиЙіЕШИпМЖЙІФмЁЃдйПДЛКДцВуМЖЃЌЮоТлЪЧIntelЛЙЪЧAMDЕФзюаТДІРэЦїЃЌЖМВЩгУСЫШ§МЖЛКДцЩшМЦЃЌЦфжаL1/L2ЛКДцзЈЪєгкУПИіКЫаФЃЌL3ЛКДцдђгЩЫљгаКЫаФЙВЯэЃЌзмДјПэГЌЙ§2TB/sЃЌетжжЩшМЦгааЇЕиЛКНтСЫдкЖрЯпГЬAIЭЦРэЕШШЮЮёжаГЃМћЕФЁАФкДцЧНЁБЦПОБЁЃ

Ш§ЁЂадФмЬсЩ§ЕФЙиМќТЗОЖгыЪЕВйНЈвщ

ЯывЊЭЈЙ§Щ§МЖФкДцРДЬсЩ§адФмЃЌЕУЭЌЪБЖЂНєЫФИігВжИБъЃКЦЕТЪЃЈБШШч6000MT/sЃЉЁЂЪБађЃЈШчCL30-36-36ЃЉЁЂЙЄзїЕчбЙЃЈЭЈГЃдк1.1VЕН1.25VжЎМфЃЉвдМАЭЈЕРЪ§ЃЈФПЧАЫЋЭЈЕРЪЧБъХфЃЉЁЃЪЕМЪВйзїжаЃЌгаИіЙиМќНЈвщЃКзАЛњЪБОЁСПбЁдёЭЌЦЗХЦЁЂЭЌаЭКХЁЂЭЌвЛЬзАќзАРяЕФСНЬѕФкДцзщГЩЫЋЭЈЕРЃЌетбљПЩвдзюДѓГЬЖШБмУтвђПХСЃХњДЮВЛЭЌЕМжТЕФМцШнадЮЪЬтКЭадФмЯТНЕЁЃЖдгкЗўЮёЦїгУЛЇЃЌВНжшвЊИќбЯНїЃКЮёБиШЗШЯбЁгУЕФRDIMMФЃзщдкжїАхЕФЙйЗНМцШнСаБэЃЈQVLЃЉРяЃЌВЂЧвБ№ЭќСЫЦєгУECCОРДэЙІФмЃЌЫќФмгааЇЗРжЙФЧаЉВЛвзВьОѕЕФЪ§ОнОВФЌДэЮѓЃЌБЃеЯЙиМќвЕЮёЕФЮШЖЈЁЃгаШЈЭўВтЪдЪ§ОнзєжЄЃКДгDDR4 3200MHzЩ§МЖЕНDDR5 6000MHzКѓЃЌЯёStable DiffusionетРрAIЙЄОпЕФБОЕиЭЦРэЫйЖШЬсЩ§СЫдМ22%ЃЌЭЌЪБФкДцДјПэЕФеМгУТЪДг78%ЯТНЕЕНСЫ61%ЁЃетЧхГўЕиБэУїЃЌЭЌВНгХЛЏДјПэКЭбгГйЃЌФмДјРДЪЕЪЕдкдкЕФадФмЪевцЁЃ

змЖјбджЎЃЌФкДцДЂЦїЪЧЪЭЗХЯЕЭГЫуСІЕФЕзВуЛљЪЏЁЃЫќЕФећИіММЪѕбнНјЪЗЃЌЦфЪЕОЭЪЧвЛГЁдкЫйЖШЁЂШнСПКЭЮШЖЈадетИіЁАВЛПЩФмШ§НЧЁБжаВЛЖЯбАЧѓзюМбЦНКтЕуЕФГжајЭЛЦЦЁЃ

ЯРгЮЯЗЗЂВМДЫЮФНіЮЊСЫДЋЕнаХЯЂЃЌВЛДњБэЯРгЮЯЗЭјеОШЯЭЌЦфЙлЕуЛђжЄЪЕЦфУшЪі

ЯрЙиЙЅТд

ИќЖрЭЌРрИќаТ

ИќЖрШШгЮЭЦМі

ИќЖр-

- КНЬьЛ№М§ФЃФтЦї

- Android/ | ФЃФтбјГЩ

- 2026-04-07

-

- УќдЫЦяЪПЭХ

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

-

-

-

-

- зЙаЧДѓТН ТђЖЯАц

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

- ЯцICPБИ14008430КХ-1 ЯцЙЋЭјАВБИ 43070302000280КХ

- All Rights Reserved

- БОеОЮЊЗЧгЏРћЭјеОЃЌВЛНгЪмШЮКЮЙуИцЁЃБОеОЫљгаШэМўЃЌЖМгЩЭјгб

- ЩЯДЋЃЌШчгаЧжЗИФуЕФАцШЈЃЌЧыЗЂгЪМўИјxiayx666@163.com

- ЕжжЦВЛСМЩЋЧщЁЂЗДЖЏЁЂБЉСІгЮЯЗЁЃзЂвтздЮвБЃЛЄЃЌНїЗРЪмЦЩЯЕБЁЃ

- ЪЪЖШгЮЯЗвцФдЃЌГСУдгЮЯЗЩЫЩэЁЃКЯРэАВХХЪБМфЃЌЯэЪмНЁПЕЩњЛюЁЃ