RedisЙҫіэ»әҙжК§°ЬөДФӯТтәНҪвҫц·Ҫ°ё

АҙФҙЈә»ҘБӘНш 2026-04-30 11:41:18ҪсМмФЫГЗАҙМҪМЦТ»ёц·ЗіЈКөјКөДПЯЙПОКМвЈәКэҫЭҝвГчГчТСҫӯёьРВіЙ№ҰБЛЈ¬ө«»әҙжЙҫіэИҙК§°ЬБЛЈ¬ХвКұәтёГФхГҙ°мЈҝ ПИёшҙр°ё Из№ыДгөДПоДҝАпЈ¬»әҙжЙҫіэҪцҪцТААөУЪТ»ҫд№ВБгБгөД redis.del(key)Ј¬ДЗГҙКэҫЭТ»ЦВРФәЬҙуіМ¶ИЙПКЗФЪЎ°ЕцФЛЖшЎұЎЈ Т»МЧёьОИҪЎөД№ӨіМ»ҜЧц·ЁЈ¬НЁіЈ°ьә¬ТФПВјёёц»·ҪЪЈә ФЪЦчБчіМЦРЈ¬јбіЦЎ°ПИ

ҪсМмФЫГЗАҙМҪМЦТ»ёц·ЗіЈКөјКөДПЯЙПОКМвЈәКэҫЭҝвГчГчТСҫӯёьРВіЙ№ҰБЛЈ¬ө«»әҙжЙҫіэИҙК§°ЬБЛЈ¬ХвКұәтёГФхГҙ°мЈҝ

ПИёшҙр°ё

Из№ыДгөДПоДҝАпЈ¬»әҙжЙҫіэҪцҪцТААөУЪТ»ҫд№ВБгБгөД redis.del(key)Ј¬ДЗГҙКэҫЭТ»ЦВРФәЬҙуіМ¶ИЙПКЗФЪЎ°ЕцФЛЖшЎұЎЈ

іӨЖЪОИ¶ЁёьРВөДФЬҫўЧКФҙЈә >>>өгҙЛБўјҙІйҝҙ<<<

Т»МЧёьОИҪЎөД№ӨіМ»ҜЧц·ЁЈ¬НЁіЈ°ьә¬ТФПВјёёц»·ҪЪЈә

- ФЪЦчБчіМЦРЈ¬јбіЦЎ°ПИРҙҝвЈ¬ФЩЙҫ»әҙжЎұөДЛіРтЎЈ

- Т»ө©ЙҫіэК§°ЬЈ¬БўјҙҪ«ИООс¶ӘИлТмІҪЦШКФ¶УБРЎЈ

- ОӘЦШКФЙиЦГЙППЮЈ¬і¬№эгРЦөФтЧӘИлЛАРЕ¶УБРЎЈ

- ЛАРЕ¶УБРРиТӘҙҘ·ўёжҫҜЈ¬ІўЦ§іЦИЛ№Ө»тЧФ¶ҜІ№іҘЎЈ

- ОӘХыёцБҙВ·ҙтөгјаҝШЈ¬ДЬЗеОъҝҙөҪЎ°ЙҫіэК§°ЬВКЎұәНЎ°І№іҘіЙ№ҰВКЎұЎЈ

ЛөөҪөЧЈ¬Йҫіэ»әҙжІ»УҰёГұ»ҝҙЧчТ»ёц№ВБўөД¶ҜЧчЈ¬¶шКЗТ»МхРиТӘҫЯұёҝЙ№ЫІвРФәНҝЙІ№іҘРФөДНкХыБҙВ·ЎЈ

ОӘКІГҙЎ°Йҫ»әҙжК§°ЬЎұұШРлөҘ¶АЙијЖ

әЬ¶аҝӘ·ўХЯҝЙДЬ»бПлЈәЎ°ЙҫК§°ЬБЛТІГ»№ШПөЈ¬ПВҙО¶БЗлЗуЧФИ»»б»ШФҙКэҫЭҝвЈ¬ЦШРВјУФШХэИ·өДКэҫЭЎЈЎұ

ФЪІў·ўС№БҰІ»ҙуөДЗйҝцПВЈ¬ХвёцВЯјӯҝҙЛЖіЙБўЎЈө«өҪБЛПЯЙПёЯ·еЖЪЈ¬ОКМвҫН»бұ©В¶іцАҙЈә

- ИИөг Key өДҫЙ»әҙжТАИ»ҙжФЪЈ¬ҙуБҝУГ»§»біЦРш¶БөҪ№эКұөДКэҫЭЎЈ

- ¶ББчБҝФҪҙуЈ¬ХвёцҫЙЦөҙ«ІҘөГҫНФҪҝмЎўФҪ№гЎЈ

- Из№ыГ»УРУРР§өДІ№іҘ»ъЦЖЈ¬ХвР©Ў°ФаКэҫЭЎұҝЙДЬ»бФЪ»әҙжЦРҙж»оПаөұіӨөДКұјдЎЈ

ёьј¬КЦөДКЗЈ¬ХвАаОКМвНЁіЈІ»»бБўҝМТэ·ўПөНіұЁҙнЈ¬¶шКЗТФЎ°Еј·ўРФУГ»§Н¶ЛЯЎұЎўЎ°әуМЁКэҫЭ¶ФІ»ЙПЎұөИРОКҪ»әВэёЎПЦЈ¬ЕЕІй¶ЁО»өДіЙұҫ·ЗіЈёЯЎЈ

Т»ёцХжКөҝЙВдөШөДБҙВ·

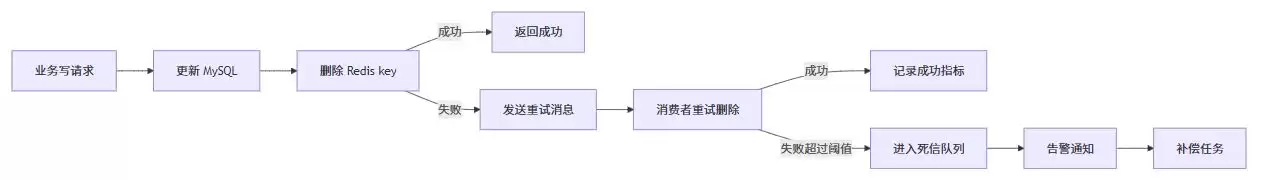

ҙУХвХЕНјҝЙТФЗеОъөШҝҙөҪЈ¬ХыМЧ·Ҫ°ёөДәЛРДЛјВ·Ј¬ТСҫӯҙУЎ°ИзәОЙҫіэЎұЧӘұдОӘЎ°ЙҫіэІ»өфКұЈ¬ИзәО¶өөЧЎұЎЈ

ҙъВлКҫАэЈәЦчБчіМ + ТмІҪЦШКФ

1. ЦчБчіМЈЁРҙҝвәуЙҫ»әҙжЈ©

@Service

public class ProductService {

@Resource

private ProductMapper productMapper;

@Resource

private StringRedisTemplate redisTemplate;

@Resource

private CacheDeleteProducer cacheDeleteProducer;

@Transactional(rollbackFor = Exception.class)

public void updateProduct(Product product) {

String key = "product:" + product.getId();

// 1) КэҫЭҝвКЗКВКөАҙФҙЈ¬ПИёьРВ

productMapper.updateById(product);

// 2) ЦчБчіМН¬ІҪЙҫ»әҙжЈ¬К§°ЬФт·ўНщЦШКФ¶УБР

try {

redisTemplate.delete(key);

} catch (Exception ex) {

cacheDeleteProducer.sendDeleteEvent(key, 1);

}

}

}

2. ЦШКФПы·СХЯЈЁЦёКэНЛұЬ + ЧоҙуҙОКэЈ©

@Component

public class CacheDeleteConsumer {

private static final int MAX_RETRY = 5;

@Resource

private StringRedisTemplate redisTemplate;

@Resource

private CacheDeleteProducer cacheDeleteProducer;

@Resource

private DeadLetterProducer deadLetterProducer;

public void onMessage(CacheDeleteEvent event) {

try {

redisTemplate.delete(event.getCacheKey());

// ҙтөгЈәdelete_success_total +1

} catch (Exception ex) {

int nextRetry = event.getRetryCount() + 1;

if (nextRetry > MAX_RETRY) {

deadLetterProducer.send(event.getCacheKey(), ex.getMessage());

return;

}

long delaySeconds = (long) Math.pow(2, nextRetry); // 2,4,8,16,32Гл

cacheDeleteProducer.sendDeleteEvent(event.getCacheKey(), nextRetry, delaySeconds);

}

}

}

3. ЛАРЕІ№іҘИООсЈЁ¶ЁКұСІјмЈ©

@Component

public class CacheDeleteCompensationJob {

@Resource

private DeadLetterRepository deadLetterRepository;

@Resource

private StringRedisTemplate redisTemplate;

// Гҝ 5 ·ЦЦУЦҙРРТ»ҙОІ№іҘИООс

@Scheduled(cron = "0 */5 * * * ")

public void compensate() {

List records = deadLetterRepository.queryUnresolved(200);

for (DeadLetterRecord record : records) {

try {

redisTemplate.delete(record.getCacheKey());

deadLetterRepository.markResolved(record.getId());

} catch (Exception e) {

deadLetterRepository.increaseFailCount(record.getId(), e.getMessage());

}

}

}

}

Хв 5 ёцПёҪЪЈ¬ҫц¶ЁДг·Ҫ°ёДЬІ»ДЬУГ

ГЭөИРФ

Йҫіэ»әҙжІЩЧчМмЙъҫЯұёГЭөИРФЈ¬ЙҫіэТ»ёцІ»ҙжФЪөД Key ТІУҰКУОӘіЙ№ҰЈ¬ОЮРиөұЧчТміЈҙҰАнЎЈ

ЦШКФЙППЮ

ЗРјЙОЮПЮЦШКФЎЈұШРлЙи¶ЁГчИ·өДгРЦөЈ¬і¬№эәујбҫцЧӘИлЛАРЕ¶УБРЈ¬·сФт»бФміЙТюРФөДПыПў¶С»эЈ¬НПҝеХыёцПөНіЎЈ

НЛұЬІЯВФ

ІЙУГ№М¶ЁөД¶МјдёфЈЁұИИз1ГлЈ©ЦШКФЈ¬ИЭТЧФЪRedis¶МФЭ№КХПКұРОіЙЎ°ЦШКФ·зұ©ЎұЈ¬Ҫ«Ждҙтұ¬ЎЈК№УГЦёКэНЛұЬІЯВФЈЁ2ГлЎў4ГлЎў8ГлЎӯЈ©ёьОӘОИҪЎЎЈ

ЛАРЕҝЙјыРФ

ЛАРЕІ»өИУЪ¶ӘЖъЎЈұШРлЕдұёПаУҰөДёжҫҜ»ъЦЖәНҙҰАнГж°еЈ¬ИГФЛО¬әНҝӘ·ўДЬҝҙјыЎўДЬҙҰАнЎЈ

БҙВ·јаҝШ

ЦБЙЩРиТӘјаҝШТФПВјёёцәЛРДЦёұкЈә

cache_delete_fail_totalЈЁ»әҙжЙҫіэК§°ЬЧЬКэЈ©cache_delete_retry_totalЈЁҪшИлЦШКФ¶УБРЧЬКэЈ©cache_delete_dlt_totalЈЁҪшИлЛАРЕ¶УБРЧЬКэЈ©cache_delete_compensation_success_totalЈЁІ№іҘіЙ№ҰЧЬКэЈ©

іЈјыОуЗш

ОуЗш 1ЈәЙҫК§°ЬёЕВКәЬөНЈ¬ҝЙТФәцВФ

ПЯЙП»·ҫіЧЬ»бУцөҪёчЦЦТвНвЈәНшВзЛІјд¶¶¶ҜЎўRedisПмУҰі¬КұЎўБ¬ҪУіШәДҫЎЎӯЎӯХвР©ЗйҝцІўІ»әұјыЎЈ

јЗЧЎТ»ёц№«КҪЈәөНёЕВККВјю ЎБ ёЯЖөЗлЗу = ҝЙ№ЫөДКВ№ККэБҝЎЈІ»ДЬРДҙжҪДРТЎЈ

ОуЗш 2ЈәУРСУіЩЛ«ЙҫҫН№»БЛ

СУіЩЛ«ЙҫІЯВФЦчТӘОӘБЛҪвҫцКэҫЭҝвЦчҙУСУіЩЖЪјдөД»әҙжІ»Т»ЦВОКМвЈ¬ЛьОЮ·ЁМжҙъХл¶ФЙҫіэІЩЧчұҫЙнК§°Ь¶шЙијЖөДЦШКФІ№іҘБҙВ·ЎЈБҪХЯҪвҫцөДОКМвО¬¶ИІ»Н¬ЎЈ

ОуЗш 3ЈәЛАРЕҫНКЗК§°ЬЈ¬ИЛ№ӨҝҙҫНРР

НкИ«ТААөИЛ№ӨјаҝШЛАРЕ¶УБРЈ¬ФЪЙоТ№»тҪЪјЩИХјёәхұШИ»»біцПЦКиВ©ЎЈАнПлөДДЈКҪКЗЎ°ЧФ¶ҜёжҫҜ + ЧФ¶ҜІ№іҘИООс + ИЛ№ӨСІјм¶өөЧЎұөДИэІг·АУщЎЈ

СЎРНҪЁТйЈЁ°ҙНЕ¶У№жДЈЈ©

| НЕ¶УҪЧ¶О | НЖјц·Ҫ°ё |

|---|---|

| РЎНЕ¶УЎўөҘМе·юОс | РҙҝвәуЙҫ»әҙж + јтөҘөДұҫөШЦШКФЈЁЧчОӘ¶МЖЪ·Ҫ°ёЈ© |

| ЦРРННЕ¶УЎў¶а·юОс | РҙҝвәуЙҫ»әҙж + ПыПў¶УБРЈЁMQЈ©ТмІҪЦШКФ + ЛАРЕёжҫҜ |

| ҙуНЕ¶УЎўёЯТ»ЦВРФТӘЗу | КВјюЗэ¶ҜөДТ»ЦВРФұЈХП + НіТ»өДЛАРЕҙҰАнЖҪМЁ + ЧФ¶ҜІ№іҘИООс |

ЧоәуЧЬҪб

Ў°Йҫіэ»әҙжК§°ЬЎұҫш·ЗТ»ёцҝЙТФәцВФөДРЎёЕВКұЯФөіЎҫ°Ј¬ЛьЗЎЗЎКЗұЈХП»әҙжТ»ЦВРФөДЦчХҪіЎЦ®Т»ЎЈ

Т»ёцХжХэДЬҫӯКЬЧЎПЯЙПБчБҝҝјСйөД·Ҫ°ёЈ¬НЁіЈҫЯұёТФПВЛДёцМШХчЈә

- ЦчБҙВ·ТӘҝмЈәәЛРДБчіМЈЁРҙҝвәуЙҫ»әҙжЈ©ұШРлЗбБҝЎўҝмЛЩЎЈ

- К§°ЬҝЙ»ЦёҙЈәНЁ№эТмІҪЦШКФ»ъЦЖЈ¬Пы»ҜБЩКұРФ№КХПЎЈ

- ј«¶ЛҝЙ¶өөЧЈәҪиЦъЛАРЕ¶УБРәНІ№іҘИООсЈ¬ҙҰАніЦҫГРФ№КХПЎЈ

- ХыМеҝЙ№ЫІвЈәҫЯұёНкХыөДјаҝШЦёұкәНёжҫҜЈ¬ЧцөҪРДЦРУРКэЎЈ

°СХвЛДјюКВВдКөөҪО»Ј¬ДгөД»әҙжТ»ЦВРФІЯВФҫНІ»ФЩКЗЎ°РюС§ЎұЈ¬¶шКЗФъКөөДЎўҝЙәвБҝөД№ӨіМДЬБҰЎЈ

ПАУОП··ўІјҙЛОДҪцОӘБЛҙ«өЭРЕПўЈ¬І»ҙъұнПАУОП·НшХҫИПН¬Жд№Ыөг»тЦӨКөЖдГиКц

Па№Ш№ҘВФ

ёь¶аН¬АаёьРВ

ёь¶аИИУОНЖјц

ёь¶а-

- әҪМм»рјэДЈДвЖч

- Android/ | ДЈДвСшіЙ

- 2026-04-07

-

- ГьФЛЖпКҝНЕ

- Android/ | ҪЗЙ«°зСЭ

- 2026-03-30

-

-

-

-

-

- Ч№РЗҙуВҪ Вт¶П°ж

- Android/ | ҪЗЙ«°зСЭ

- 2026-03-30

-

- ПжICPұё14008430әЕ-1 П湫Нш°Іұё 43070302000280әЕ

- All Rights Reserved

- ұҫХҫОӘ·ЗУҜАыНшХҫЈ¬І»ҪУКЬИОәО№гёжЎЈұҫХҫЛщУРИнјюЈ¬¶јУЙНшУС

- ЙПҙ«Ј¬ИзУРЗЦ·ёДгөД°жИЁЈ¬Зл·ўУКјюёшxiayx666@163.com

- өЦЦЖІ»БјЙ«ЗйЎў·ҙ¶ҜЎўұ©БҰУОП·ЎЈЧўТвЧФОТұЈ»ӨЈ¬Ҫч·АКЬЖӯЙПөұЎЈ

- КК¶ИУОП·ТжДФЈ¬іБГФУОП·ЙЛЙнЎЈәПАн°ІЕЕКұјдЈ¬ПнКЬҪЎҝөЙъ»оЎЈ