ИХұҫНЕ¶УСөБ·ҙуКуЙсҫӯФӘЈ¬ҝЙКөКұЦҙРР AI јЖЛгИООс

АҙФҙЈә»ҘБӘНш 2026-05-04 15:57:04ИХұҫҝЖС§јТСөБ·ҙуКуЙсҫӯФӘКөПЦЧФЦчAIјЖЛг ҪьИХЈ¬ҝЖјјГҪМеTomЎ®s HardwareұЁөАБЛТ»ПоН»ЖЖРФСРҫҝЎЈИХұҫ¶«ұұҙуС§УлОҙАҙҙуС§өДҝЖСРНЕ¶УіЙ№ҰСөБ·БЛҙуКуЖӨІгЙсҫӯФӘЈ¬К№ХвР©»оМеПё°ыФЪЎ°ұХ»·ҙўұёіШјЖЛгЎұөДКөКұ»ъЖчС§П°ҝтјЬПВЈ¬ЧФЦчЙъіЙБЛёҙФУөДКұРтРЕәЕЎЈХвПоҪшХ№Ҫ«ЙъОпјЖЛгНЖПтБЛРВөДЗ°СШЎЈ »оМеЙсҫӯФӘУлјЖЛгПө

ИХұҫҝЖС§јТСөБ·ҙуКуЙсҫӯФӘКөПЦЧФЦчAIјЖЛг

ҪьИХЈ¬ҝЖјјГҪМеTomЎ®s HardwareұЁөАБЛТ»ПоН»ЖЖРФСРҫҝЎЈИХұҫ¶«ұұҙуС§УлОҙАҙҙуС§өДҝЖСРНЕ¶УіЙ№ҰСөБ·БЛҙуКуЖӨІгЙсҫӯФӘЈ¬К№ХвР©»оМеПё°ыФЪЎ°ұХ»·ҙўұёіШјЖЛгЎұөДКөКұ»ъЖчС§П°ҝтјЬПВЈ¬ЧФЦчЙъіЙБЛёҙФУөДКұРтРЕәЕЎЈХвПоҪшХ№Ҫ«ЙъОпјЖЛгНЖПтБЛРВөДЗ°СШЎЈ

»оМеЙсҫӯФӘУлјЖЛгПөНіөДИЪәП

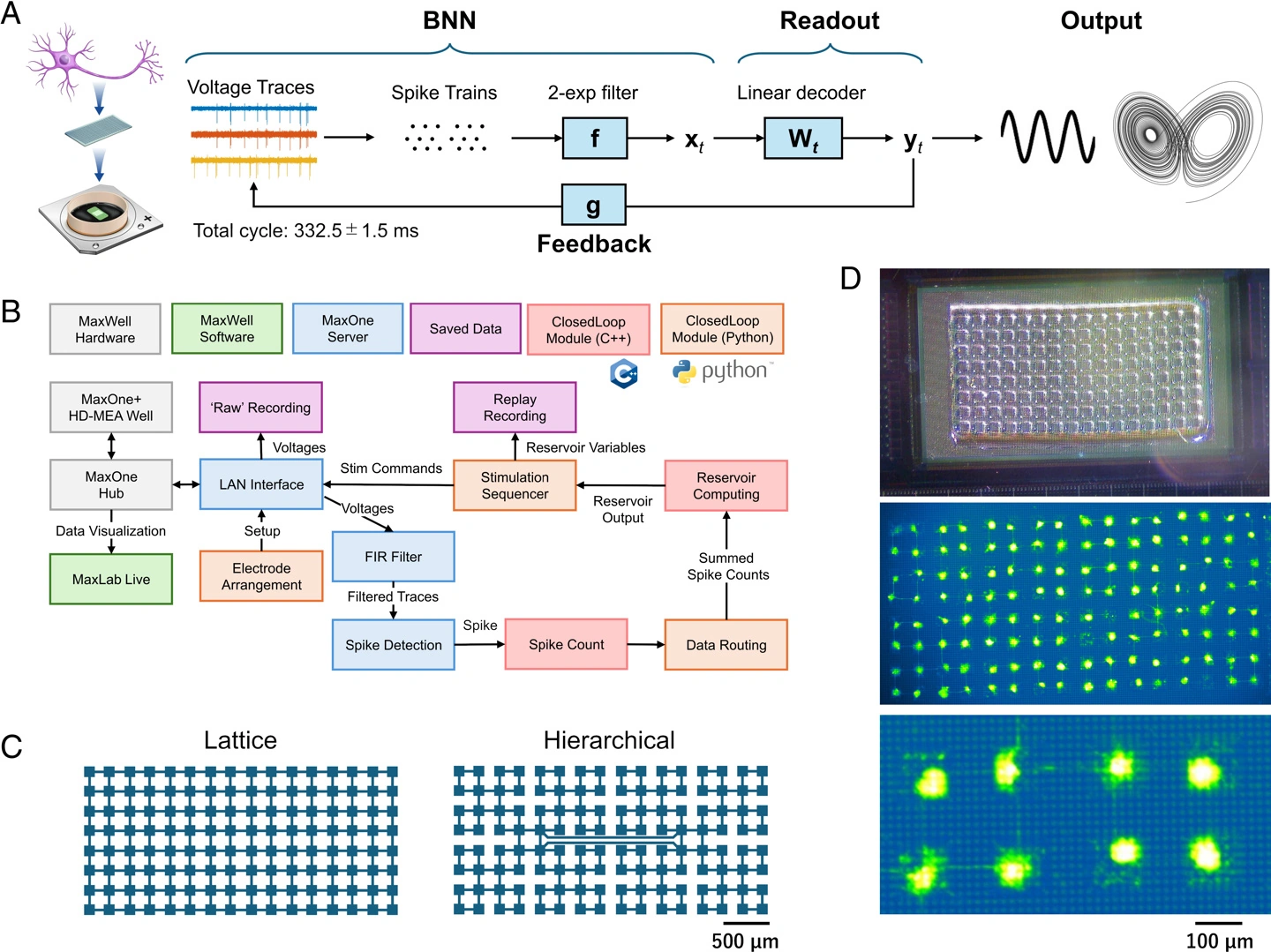

ёГјјКхөДәЛРДФЪУЪҪ«»оМеЙсҫӯФӘУлёЯГЬ¶ИОўөзј«ХуБРЎўОўБчҝШЙиұёҪшРРјҜіЙЎЈЛщ№№ҪЁөДПөНіОЮРиТААөНвІҝіЦРшЦёБоЈ¬јҙҝЙЧФЦчС§П°әНЙъіЙЦЬЖЪРФДЛЦБ»мгзІЁРОЈ¬¶АБўЦҙРРAIјЖЛгИООсЈ¬ОӘЙъОпјЖЛгҝӘұЩБЛРВөДҝЙДЬРФЎЈ

іӨЖЪОИ¶ЁёьРВөДФЬҫўЧКФҙЈә >>>өгҙЛБўјҙІйҝҙ<<<

ОпАнФјКшМбЙэЙсҫӯФӘјЖЛгДЬБҰ

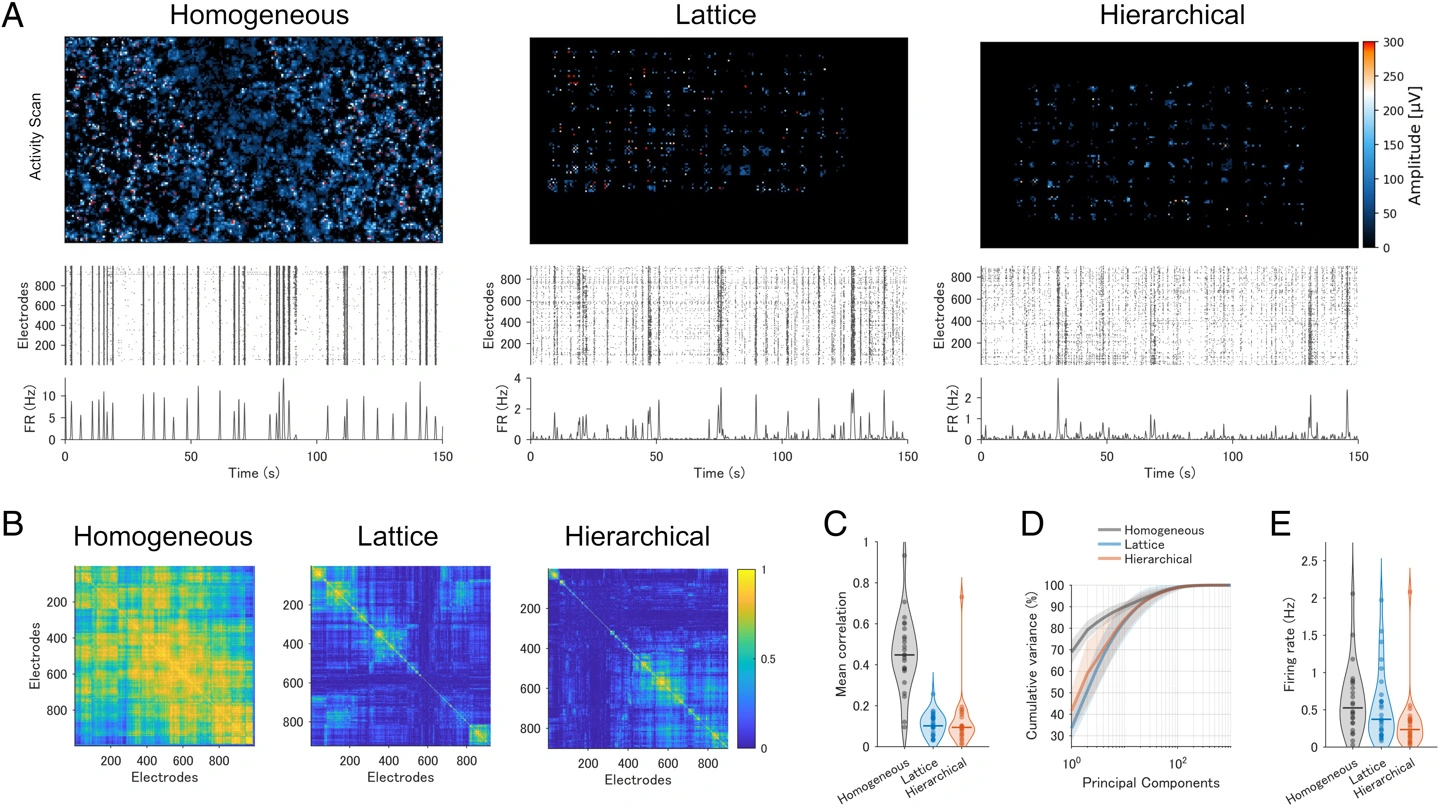

ИзәОТэөјЙсҫӯФӘНкіЙјЖЛгЈҝ№ШјьФЪУЪ¶ФЖдБ¬ҪУ·ҪКҪҪшРРОпАнФјКшЎЈСРҫҝ·ўПЦЈ¬ИфИОУЙЕаСшөДЙсҫӯФӘЧФУЙЙъіӨЈ¬»бРОіЙёЯ¶ИН¬ІҪ»ҜөДНшВзЈ¬·ҙ¶шІ»АыУЪҙҰАнёҙФУРЕПўУлС§П°ДҝұкРЕәЕЎЈ

НЕ¶УІЙУГPDMSЈЁҫЫ¶юјЧ»щ№иСхНйЈ©ОўБчҝШұЎДӨЈ¬Ҫ«ЙсҫӯФӘ°ыМеҫ«ЧјПЮЦЖФЪ128ёцОўРНОўҝЧДЪЈ¬ІўНЁ№эЙијЖөДОўНЁөАБ¬ҪУЈ¬№№ҪЁБЛёсРНУл·ЦІгРНБҪЦЦНшВзҪб№№ЎЈХвЦЦФјКшПФЦшМбЙэБЛНшВз¶ҜБҰС§О¬¶ИЈ¬К№ЙсҫӯФӘјдБҪБҪПа№ШРФҙУ0.45ҪөЦБ0.12Ј¬ФцЗҝБЛНшВзөД¶ҜМ¬ПмУҰДЬБҰЎЈ

ПөНіұнПЦУлөұЗ°МфХҪ

ІвКФПФКҫЈ¬ёсРННшВзФЪЛщУРДҝұкІЁРОЙъіЙИООсЦРұнПЦН»іцЎЈёГ»оМеЙсҫӯФӘПөНіДЬОИ¶ЁЙъіЙЦЬЖЪОӘ4ГлЎў10ГләН30ГлөДХэПТІЁЎўИэҪЗІЁУл·ҪІЁЈ¬ЙхЦБДЬұЖҪьИэО¬»мгз№мјЈЦРөДВеВЧЧИОьТэЧУДЈРНЎЈФЪС§П°ҪЧ¶ОЈ¬ЖдФӨІвРЕәЕУлДҝұкРЕәЕөДПа№ШРФі¬№э0.8Ј¬Х№ПЦіцҪПЗҝөДС§П°ДЬБҰЎЈ

¶«ұұҙуС§ЙҪұҫУўГчҪМКЪЦёіцЈ¬ёГСРҫҝЦӨКө»оМеЙсҫӯФӘНшВзҝЙЧчОӘРВРНјЖЛгЧКФҙҪшРРҝӘ·ўУлАыУГЎЈ

ДҝЗ°ёГјјКхИФГжБЩРФДЬЖҝҫұЈәөұСөБ·НЈЦ№ЎўПөНіҪшИлНкИ«ЧФЦчФЛРРДЈКҪКұЈ¬КдіцОуІо»бЦрҪҘАЫ»эЈ»Н¬КұЈ¬·ҙАЎ»·В·ЦРФј330әБГлөДСУіЩТІПЮЦЖБЛПөНі¶ФҝмЛЩұд»ҜІЁРОЈЁИзУпТфРЕәЕЈ©өДЧ·ЧЩДЬБҰЎЈХвР©КЗЧЯПтКөУГ»ҜұШРлҝЛ·юөДДСМвЎЈ

Х№НыЈәДФ»ъҪУҝЪөДРВВ·ҫ¶

СРҫҝНЕ¶УјЖ»®НЁ№эҝӘ·ўЧЁУГУІјюҪөөНПөНіСУіЩЈ¬ІўНШХ№ёГјјКхФЪДФ»ъҪУҝЪУлЙсҫӯјЩМеЙиұёЦРөДУҰУГЗұБҰЎЈХвМхјјКхВ·ҫ¶ЛдіӨЈ¬ө«ГҝТ»ІҪ¶јЦёПтёьҫЯПлПуБҰөДОҙАҙЎЈ

ІОҝјСРҫҝЈәOnline supervised learning of temporal patterns in biological neural networks under feedback control

ПАУОП··ўІјҙЛОДҪцОӘБЛҙ«өЭРЕПўЈ¬І»ҙъұнПАУОП·НшХҫИПН¬Жд№Ыөг»тЦӨКөЖдГиКц

Н¬АаёьРВ

ёь¶аИИУОНЖјц

ёь¶а-

- әҪМм»рјэДЈДвЖч

- Android/ | ДЈДвСшіЙ

- 2026-04-07

-

- ГьФЛЖпКҝНЕ

- Android/ | ҪЗЙ«°зСЭ

- 2026-03-30

-

-

-

-

-

- Ч№РЗҙуВҪ Вт¶П°ж

- Android/ | ҪЗЙ«°зСЭ

- 2026-03-30

-

- ПжICPұё14008430әЕ-1 П湫Нш°Іұё 43070302000280әЕ

- All Rights Reserved

- ұҫХҫОӘ·ЗУҜАыНшХҫЈ¬І»ҪУКЬИОәО№гёжЎЈұҫХҫЛщУРИнјюЈ¬¶јУЙНшУС

- ЙПҙ«Ј¬ИзУРЗЦ·ёДгөД°жИЁЈ¬Зл·ўУКјюёшxiayx666@163.com

- өЦЦЖІ»БјЙ«ЗйЎў·ҙ¶ҜЎўұ©БҰУОП·ЎЈЧўТвЧФОТұЈ»ӨЈ¬Ҫч·АКЬЖӯЙПөұЎЈ

- КК¶ИУОП·ТжДФЈ¬іБГФУОП·ЙЛЙнЎЈәПАн°ІЕЕКұјдЈ¬ПнКЬҪЎҝөЙъ»оЎЈ