AI»бТйјНТӘЧФ¶ҜЙъіЙКЦ»ъК¶ұрЧјІ»ЧјЈҝ

АҙФҙЈә»ҘБӘНш 2026-05-04 18:09:08AI»бТйјНТӘЈәКЦ»ъ¶ЛУпТфК¶ұрЈ¬ҙУЎ°ДЬУГЎұөҪЎ°ёТУГЎұөДҝзФҪ ДгІВФхГҙЧЕЈҝПЦФЪУГКЦ»ъҝӘёц»бЈ¬AIЙъіЙөД»бТйјНТӘЈ¬ЖдЧјИ·¶ИТСҫӯПаөұҝЙҝҝБЛЎЈҫНДГКРГжЙПЦчБчөД№ӨҫЯұИИзМэДФAIАҙЛөЈ¬КөІвКэҫЭПФКҫЈ¬ЖХНЁ»°ЧӘРҙЧјИ·ВКДЬҙпөҪ98.7%Ј¬јҙұгКЗФБУпәНЖХНЁ»°»мЧЕЛөЈ¬ТІДЬҙпөҪ96.2%өДЛ®ЖҪЎЈОЮВЫКЗ·ҪСФ»№КЗЧЁТөКхУпЈ¬ҫӯ№э¶а

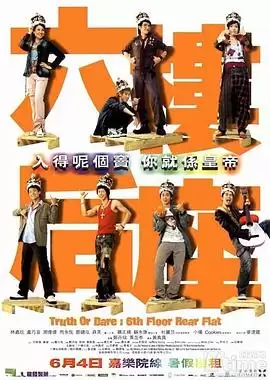

AI»бТйјНТӘЈәКЦ»ъ¶ЛУпТфК¶ұрЈ¬ҙУЎ°ДЬУГЎұөҪЎ°ёТУГЎұөДҝзФҪ

ДгІВФхГҙЧЕЈҝПЦФЪУГКЦ»ъҝӘёц»бЈ¬AIЙъіЙөД»бТйјНТӘЈ¬ЖдЧјИ·¶ИТСҫӯПаөұҝЙҝҝБЛЎЈҫНДГКРГжЙПЦчБчөД№ӨҫЯұИИзМэДФAIАҙЛөЈ¬КөІвКэҫЭПФКҫЈ¬ЖХНЁ»°ЧӘРҙЧјИ·ВКДЬҙпөҪ98.7%Ј¬јҙұгКЗФБУпәНЖХНЁ»°»мЧЕЛөЈ¬ТІДЬҙпөҪ96.2%өДЛ®ЖҪЎЈОЮВЫКЗ·ҪСФ»№КЗЧЁТөКхУпЈ¬ҫӯ№э¶аВЦХжКөіЎҫ°өДСйЦӨЈ¬ЛьөДК¶ұрұнПЦ¶јПаөұОИҪЎЎЈ

ХвұіәуҝҝөДҝЙІ»КЗјтөҘөШ¶СЖцҙКҝвЎЈЖдәЛРДКЗТАНРУЪҫӯ№эЗ§НтРЎКұХжКө»бТйУпБПСөБ·өД¶ЛФЖРӯН¬УпТфДЈРНЎЈХвёцДЈРНДЬКөКұҪөФлЎўЗш·ЦІ»Н¬Лө»°ИЛЈ¬»№ДЬёщҫЭЙППВОДУпТеҪшРРРЈЧјЎЈҙУТ»РЎКұөДјјКхСРМЦ»бөҪ¶аВЦөДOKRРЎЧйМЦВЫЈ¬ЧӘРҙҪб№ы¶јДЬҫ«ЧјөШЧҘЧЎјјКхІОКэЎўКұјдҪЪөгәНФрИОИЛРЕПўЈ¬ІўҪб№№»ҜөШКдіцҙэ°мЗеөҘУлҫцІЯөгЈ¬°СИЛ№ӨёҙәЛөДКұјдС№ЛхөҪБЛЧоөНЎЈХвТ»ЧјИ·ВКЛ®ЖҪЈ¬ТСҫӯөГөҪБЛIDC 2026ДкЦЗДܰ칫№ӨҫЯР§ДЬ°ЧЖӨКйөДИПЦӨЈ¬ҝЙТФЛөЈ¬ЛьТСҫӯіЙОӘЦ°іЎёЯЖөёХРиіЎҫ°ПВЈ¬Т»ёцЦөөГРЕАөөДЙъІъБҰЧйјюЎЈ

іӨЖЪОИ¶ЁёьРВөДФЬҫўЧКФҙЈә >>>өгҙЛБўјҙІйҝҙ<<<

Т»ЎўК¶ұрЧјИ·ВКМбЙэөД№ШјьјјКхВ·ҫ¶

ДЗГҙЈ¬ИзҙЛёЯөДЧјИ·ВККЗИзәОКөПЦөДЈҝХвІў·ЗЕјИ»Ј¬¶шКЗҪЁБўФЪИэЦШјјКхұЈХПЦ®ЙПЎЈ

КЧПИЈ¬ЛьөДУпТфДЈРНІЙУГБЛ¶ЛІаЗбБҝ»ҜөДASRТэЗжЎЈХвТвО¶ЧЕЈ¬ФЪКЦ»ъұҫөШҫНДЬНкіЙКөКұҪөФләНЙщОЖіхЙёЈ¬ПсҝХөчФлТфЎўјьЕМЗГ»чХвР©іЈјыёЙИЕЈ¬ФЪөЪТ»ІҪҫНұ»УРР§№эВЛөфБЛЎЈ

ЖдҙОЈ¬ФЖ¶ЛДЈРНҪУИлБЛ¶ҜМ¬УпҫіККЕдДЈҝйЎЈХвёцДЈҝйДЬёщҫЭ»бТйАаРНЧФ¶ҜЗР»»К¶ұрІЯВФЎӘЎӘұИИзЈ¬јјКхСРМЦДЈКҪ»бЗҝ»Ҝ¶ФҙъВлКхУпЎўУўОДЛхРҙј°КэЧЦҙ®өДҪвОцЈ»¶шOKRМЦВЫДЈКҪЈ¬Фт»бУЕПИРЈЧјЎ°ДҝұкЎұЎўЎ°№ШјьҪб№ыЎұЎўЎ°ФрИОИЛЎұХвАаҪб№№»Ҝ№ШјьҙКЎЈ

ЧоәуЈ¬ПөНі»№Ц§іЦТ»ёц№ШјьөДИЛ№ӨОўөч·ҙАЎұХ»·ЎЈУГ»§Из№ы¶ФДі¶ОЧӘРҙҪб№ыөг»чЎ°РЮХэЎұЈ¬ХвёцСщұҫФЪ24РЎКұДЪҫН»бІОУлДЈРНөДФцБҝСөБ·Ј¬ҙУ¶шИГәуРшН¬АаіЎҫ°өДК¶ұріЦРшУЕ»ҜЎЈКөІвПФКҫЈ¬Б¬РшК№УГТ»ЦЬәуЈ¬ФБУп»мәПіЎҫ°өДК¶ұрОуІоВКДЬПВҪөФј3.1%ЎЈХвҫНПсКЗТ»ёцФҪУГФҪҙПГчөДЦъКЦЎЈ

¶юЎўХжКө°м№«іЎҫ°ПВөДІЩЧчБчіМУлР§№ыСйЦӨ

№вЛөјјКхҝЙДЬУРөгійПуЈ¬ОТГЗАҙҝҙТ»ёцҫЯМеАэЧУЎЈјЩЙиТ»іЎ90·ЦЦУөДҝзІҝГЕІъЖ·ёҙЕМ»бЈ¬БчіМКЗФхСщөДЈҝ

ҙтҝӘКЦ»ъЙПөДМэДФAI AppЈ¬СЎФсЎ°Ц°іЎ»бТйЎұДЈКҪІўҝӘЖфВјТфЈ¬ҪУПВАҙЈ¬ДгјёәхҝЙТФЎ°НьјЗЎұЛьЎӘЎӘИ«іМОЮРиКЦ¶ҜФЭНЈ»тЗР»»·ўСФИЛЎЈ»бТйТ»ҪбКшЈ¬Т»·ЭҙшКұјдҙБөДЛ«АёјНТӘҫНЙъіЙБЛЈәЧуАёКЗФӯКјЧӘРҙОДұҫЈ¬УТАёФтЧФ¶ҜёЯБББЛҙэ°мПоЎўХщТйөгУлҫцІЯҪбВЫЎЈ

Из№ыРиТӘёьҪб№№»ҜөДКдіцЈ¬өг»чЎ°өјіцҪб№№»ҜјНТӘЎұЈ¬ПөНіДЬФЪ5ГлДЪЙъіЙТ»·Э°ьә¬Ў°РР¶ҜПо-ёәФрИЛ-ҪШЦ№ИХЎұИэёцЧЦ¶ОөДExcelұнёсЈ¬ІўЧФ¶ҜН¬ІҪөҪ·ЙКй¶аО¬ұнёсЎЈКВәуПл»ШЛЭДі¶О№ШУЪЎ°SDKјжИЭРФЎұөДјјКхМЦВЫЈҝЦұҪУЛСЛч№ШјьҙКЈ¬ҫНДЬ¶ЁО»өҪөЪ37·Ц12ГлөДТфЖөЖ¬¶ОЎЈ

И«БчіМәДКұІ»Чг8·ЦЦУЈ¬ИЛ№ӨәЛ¶ФҪцҪцРиТӘИ·ИП3ҙҰДЈәэ·ўТфЎЈПаұИҙ«НіөДИЛ№ӨјЗВјХыАн·ҪКҪЈ¬ЧгЧгҪЪКЎБЛ42·ЦЦУЎЈР§ВКөДМбЙэЈ¬КЗКөКөФЪФЪҝҙөГјыөДЎЈ

ИэЎў·ҪСФУлЧЁТөіЎҫ°өДЧЁПоККЕдДЬБҰ

¶ФУЪТҪБЖЎўҪМУэЎўЦЖФмТөХвР©ҙ№ЦұБмУтЈ¬НЁУГДЈРННщНщІ»№»УГЎЈХвҫНРиТӘЧЁПоККЕдДЬБҰЎЈ

МэДФAIМṩБЛФӨЦГөДРРТөҙКҝв°ьЎЈАэИзЈ¬»ӨАнјЗВјДЈ°еДЪЦГБЛЎ°С№ҙҜ·ЦЖЪЎұЎўЎ°ҫІВцНЁВ·ЎұөИЧЁТөКхУпҝвЈ¬ХвИГЖдК¶ұрЧјИ·ВКҪПНЁУГДЈРНМбЙэБЛ14.6%ЎЈ¶шФЪјјКхСРМЦ»бЦРЖфУГЎ°ҝӘ·ўХЯДЈКҪЎұәуЈ¬ЛьДЬҫ«ЧјЗш·ЦЎ°Git rebaseЎұУлЎ°Git resetЎұХвАаИЭТЧ»мПэөДЦёБоЈ¬ІўЗТұЈБфҙъВлҝйөДФӯКјЛхҪшУл·ыәЕёсКҪЎЈ

ёьЦөөГТ»МбөДКЗ·ҪСФіЎҫ°ЎЈФЪ№гЙоБҪөШ12іЎФБУпјјКхЙіБъөДКөІвЦРЈ¬ПөНі¶ФЎ°ВсөгЎұЎўЎ°»Т¶И·ўІјЎұөИёҙәПҙКөДК¶ұрОИ¶ЁВКҙпөҪБЛ95.8%Ј¬ХвёцКэЧЦФ¶і¬ДЗР©ОҙЧц·ҪСФФцЗҝөДҫәЖ·№ӨҫЯЎЈХвТвО¶ЧЕЈ¬өШУтәНУпСФІ»ФЩКЗ№өНЁУлјЗВјөДГЕјчЎЈ

»°Лө»ШАҙЈ¬ЧЫәПТФЙПјёөгЈ¬ОТГЗҝЙТФөГіцТ»ёцЗеОъөДҪбВЫЈәөұЗ°КЦ»ъ¶ЛөДAI»бТйјНТӘ№ӨҫЯЈ¬ТСҫӯҝзФҪБЛФзЖЪөДЎ°ДЬУГЎұҪЧ¶ОЈ¬ХэҪшИлТ»ёцЎ°ёТУГЎўҫ«УГЎұөДРВЦЬЖЪЎЈЖдК¶ұрЧјИ·ВКУліЎҫ°АнҪвБҰЈ¬№ІН¬№№іЙБЛТ»ёцҝЙРЕАөөДЙъІъБҰөЧЧщЎЈ¶ФУЪЧ·ЗуР§ВКөДПЦҙъЦ°іЎИЛ¶шСФЈ¬ХвОЮТЙКЗТ»ёцЦөөГУөұ§өДұд»ҜЎЈ

ПАУОП··ўІјҙЛОДҪцОӘБЛҙ«өЭРЕПўЈ¬І»ҙъұнПАУОП·НшХҫИПН¬Жд№Ыөг»тЦӨКөЖдГиКц

Па№Ш№ҘВФ

ёь¶аН¬АаёьРВ

ёь¶аИИУОНЖјц

ёь¶а-

- әҪМм»рјэДЈДвЖч

- Android/ | ДЈДвСшіЙ

- 2026-04-07

-

- ГьФЛЖпКҝНЕ

- Android/ | ҪЗЙ«°зСЭ

- 2026-03-30

-

-

-

-

-

- Ч№РЗҙуВҪ Вт¶П°ж

- Android/ | ҪЗЙ«°зСЭ

- 2026-03-30

-

- ПжICPұё14008430әЕ-1 П湫Нш°Іұё 43070302000280әЕ

- All Rights Reserved

- ұҫХҫОӘ·ЗУҜАыНшХҫЈ¬І»ҪУКЬИОәО№гёжЎЈұҫХҫЛщУРИнјюЈ¬¶јУЙНшУС

- ЙПҙ«Ј¬ИзУРЗЦ·ёДгөД°жИЁЈ¬Зл·ўУКјюёшxiayx666@163.com

- өЦЦЖІ»БјЙ«ЗйЎў·ҙ¶ҜЎўұ©БҰУОП·ЎЈЧўТвЧФОТұЈ»ӨЈ¬Ҫч·АКЬЖӯЙПөұЎЈ

- КК¶ИУОП·ТжДФЈ¬іБГФУОП·ЙЛЙнЎЈәПАн°ІЕЕКұјдЈ¬ПнКЬҪЎҝөЙъ»оЎЈ