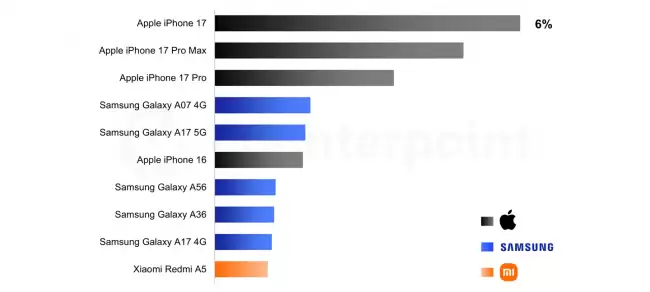

Node.js HTTPЗлЗуИХЦҫ·ЦОц·Ҫ·ЁПкҪв

АҙФҙЈә»ҘБӘНш 2026-05-07 11:49:29·ЦОцNode.jsУҰУГөДHTTPЗлЗуИХЦҫРиҪиЦъELKөИЖҪМЁКөПЦКХјҜЎўЛСЛчУлҝЙКУ»ҜЎЈАыУГMorganЦРјдјюКдіцJSONҪб№№»ҜИХЦҫЈ¬јаҝШПмУҰКұјдЎўҙнОуВКУлЗлЗуБҝөИ№ШјьЦёұкТФ·ўПЦРФДЬЖҝҫұЎЈјҜіЙSentryЧФ¶ҜІ¶»сҙнОуЈ¬ҪбәПУГ»§РРОӘ·ЦОцУЕ»ҜМеСйЎЈ¶ЁЖЪЙуІйИХЦҫІўұаРҙ¶ЁЦЖҪЕұҫЈ¬ҝЙіЦРшМбЙэУҰУГРФДЬУлҝЙҝҝРФЎЈ

ҙҰАнNode.jsУҰУГКұЈ¬·юОсЖчИХЦҫҫНПсТ»ұҫПкҫЎөДЎ°РРОӘИХјЗЎұЈ¬УИЖдКЗЖдЦРөДHTTPЗлЗујЗВјЈ¬ёьКЗ¶ҙІмУҰУГҪЎҝөЧҙҝцЎўРФДЬЖҝҫұәНУГ»§»Ҙ¶ҜөД№ШјьЎЈҪсМмЈ¬ОТГЗҫНАҙБДБДЈ¬ИзәОёЯР§өШ·ЦОцХвР©ИХЦҫЈ¬°СәЈБҝКэҫЭұдіЙЗеОъөДРР¶ҜЦёДПЎЈ

іӨЖЪОИ¶ЁёьРВөДФЬҫўЧКФҙЈә >>>өгҙЛБўјҙІйҝҙ<<<

К№УГИХЦҫ№ЬАн№ӨҫЯ

Гж¶ФіЙ¶СөДИХЦҫОДұҫЈ¬КЦ¶Ҝ·ЦОцОЮТмУЪҙуәЈАМХлЎЈХвКұәтЈ¬ЧЁТөөДИХЦҫ№ЬАн№ӨҫЯҫНіЙБЛөГБҰЦъКЦЎЈПсELKЈЁElasticsearch, Logstash, KibanaЈ©¶СХ»ЎўGraylog»тХЯSplunkХвАаЖҪМЁЈ¬ДЬ°пДгЗбЛЙКөПЦИХЦҫөДКХјҜЎўЛчТэЎўЛСЛчәНҝЙКУ»ҜЎЈДгҝЙТФҝмЛЩ№эВЛіцМШ¶ЁAPIөДЗлЗуЈ¬ҫЫәП·ЦОцПмУҰКұјдөД·ЦІјЈ¬»тХЯЦұ№ЫөШҝҙөҪҙнОуВлЛжКұјдөДЗчКЖұд»ҜЈ¬ИГТюІШФЪКэҫЭұіәуөДДЈКҪәНОКМвТ»ДҝБЛИ»ЎЈ

ИХЦҫёсКҪ»Ҝ

№ӨУыЙЖЖдКВЈ¬ұШПИАыЖдЖчЎЈ·ЦОцөДЗ°МбЈ¬КЗИХЦҫұҫЙнТӘЎ°ТЧУЪФД¶БЎұЎЈИ·ұЈДгөДУҰУГКдіцҪб№№»ҜөДИХЦҫёсКҪЈ¬ұИИзJSONЈ¬ХвДЬИГәуРшөДҪвОц№ӨЧчКВ°л№Ұұ¶ЎЈФЪNode.jsЙъМ¬ЦРЈ¬ПсMorganХвСщөДЦРјдјюҫН·ЗіЈКөУГЈ¬ЛьҝЙТФ·ҪұгөШјЗВјПВГҝҙОHTTPЗлЗуөДПкПёРЕПўЈ¬°ьАЁЗлЗу·Ҫ·ЁЎўURLЎўЧҙМ¬ВлЎўПмУҰКұјдЙхЦБУГ»§ҙьАпЈ¬ОӘәуРш·ЦОцҙтПВјбКө»щҙЎЎЈ

·ЦОц№ШјьЦёұк

ФЪ·Ч·ұөДКэҫЭЦРЈ¬ЧҘЧЎ№ШјьЦёұкІЕДЬЦұ»чТӘәҰЎЈДгРиТӘЦШөг№ШЧўХвјёАаЈә

- ПмУҰКұјдЈәЖҪҫщПмУҰКұјдЎўP95/P99·ЦО»ЦөЈ¬ХвКЗәвБҝУҰУГРФДЬөДЦұҪУіЯЧУЎЈ

- ҙнОуВКЈәHTTP 5xxәН4xxЧҙМ¬ВлөДұИВКЈ¬ЦұҪУ·ҙУіБЛУҰУГөДОИ¶ЁРФәНУГ»§МеСйЎЈ

- ЗлЗуБҝЈәQPSЈЁГҝГлІйСҜВКЈ©»тИХЗлЗуЧЬБҝЈ¬°пДгАнҪвБчБҝ№жДЈәНС№БҰ·ЦІјЎЈ

јаҝШХвР©ЦёұкөДТміЈІЁ¶ҜЈ¬НщНщКЗ·ўПЦРФДЬЖҝҫұ»тЗұФЪ№КХПөДөЪТ»РЕәЕЎЈ

јаҝШТміЈәНҙнОу

ИХЦҫЦРөДҙнОу¶СХ»РЕПўКЗұҰ№уөДөчКФЧКФҙЎЈіэБЛКЦ¶ҜЛСЛчЈ¬ёьёЯР§өДЧц·ЁКЗјҜіЙЧЁТөөДҙнОујаҝШ№ӨҫЯЈ¬АэИзSentryЎЈХвАа№ӨҫЯДЬЧФ¶ҜІ¶»сЎўҫЫәПәНЙПұЁФЛРРКұТміЈУлҙнОуЈ¬І»ҪцМṩПкПёөДЙППВОДРЕПўЈ¬»№ДЬНЁ№эұЁҫҜ»ъЦЖИГДгФЪУГ»§ҙу№жДЈН¶ЛЯЗ°ҫН¶ЁО»өҪОКМвёщФҙЎЈ

УГ»§РРОӘ·ЦОц

HTTPИХЦҫІ»ҪцКЗјјКхХп¶П№ӨҫЯЈ¬ТІКЗАнҪвУГ»§өДҙ°ҝЪЎЈНЁ№э·ЦОцЗлЗуВ·ҫ¶ЎўҪУҝЪөчУГЖөВКЎўіЈјыІЩЧчРтБРЈ¬ДгҝЙТФ№ҙАХіцУГ»§өДК№УГП°№ЯәНЖ«әГЎЈұИИзЈ¬ДіёцТіГжјУФШҪУҝЪәДКұН»И»ФцјУЈ¬ҝЙДЬТвО¶ЧЕРВЙППЯөД№ҰДЬУцөҪБЛРФДЬОКМвЈ»ДіР©APIөчУГЖө·ұК§°ЬЈ¬»тРн°өКҫЧЕІъЖ·ЙијЖ»тТэөјБчіМҙжФЪИұПЭЎЈХвР©¶ҙІм¶ФУЪУЕ»ҜУГ»§МеСйЦБ№ШЦШТӘЎЈ

¶ЁЖЪЙуІйИХЦҫ

ИХЦҫ·ЦОцІ»КЗТ»ҙОРФИООсЈ¬¶шУҰіЙОӘИХіЈФЛО¬өДАэРР№ӨЧчЎЈҪЁБў¶ЁЖЪЈЁИзГҝИХЎўГҝЦЬЈ©өДИХЦҫЙуІй»ъЦЖЈ¬УРЦъУЪ·ўПЦ»әВэЧМЙъөДЗчКЖРФОКМвЈ¬АэИзДЪҙжР№В©өДФзЖЪХчХЧЈ¬»тДіёцТААөAPIРФДЬөДЦрІҪНЛ»ҜЎЈЧФ¶Ҝ»ҜұЁёж№ӨҫЯҝЙТФ°пДг°СХвПоИООсұдөГҝЙіЦРшЗТёЯР§ЎЈ

ИХЦҫ·ЦОцҪЕұҫ

өұНЁУГ№ӨҫЯОЮ·ЁНкИ«ВъЧг¶ЁЦЖ»ҜРиЗуКұЈ¬ұаРҙ·ЦОцҪЕұҫҫНіЙБЛЦХј«Ҫвҫц·Ҫ°ёЎЈДгҝЙТФК№УГPythonЎўGoөИУпСФЈ¬»тХЯЦұҪУАыУГLogstashөД·бё»ІејюЈ¬Хл¶ФМШ¶ЁіЎҫ°ұаРҙҪвОцәННіјЖҪЕұҫЎЈАэИзЈ¬ЧЁГЕ·ЦОцДіёцОў·юОсјдөДөчУГБҙВ·әДКұЈ¬»тНіјЖМШ¶ЁУГ»§ИәМеөДAPIК№УГДЈКҪЈ¬Бй»оРФј«ёЯЎЈ

ЛөөҪөЧЈ¬·ЦОцNode.jsөДHTTPЗлЗуИХЦҫЈ¬КЗТ»ёцҪбәПБЛ№ӨҫЯЎў·Ҫ·ЁВЫәНіЦРш№ЫІмөДЧЫәПРФ№эіМЎЈЛьГ»УРОЁТ»өДХэИ·ҙр°ёЈ¬әЛРДФЪУЪҪЁБўЖрҙУКэҫЭКХјҜЎўөҪ№ШјьЦёұкјаҝШЎўФЩөҪЙо¶И·ЦОцәНіЦРшУЕ»ҜөДНкХыұХ»·ЎЈөұДгДЬ№»УОИРУРУаөШјЭФҰХвР©ИХЦҫКэҫЭКұЈ¬ТІҫНОХЧЎБЛМбЙэУҰУГРФДЬЎўҝЙҝҝРФУлУГ»§МеСйөДҪрФҝіЧЎЈ

ПАУОП··ўІјҙЛОДҪцОӘБЛҙ«өЭРЕПўЈ¬І»ҙъұнПАУОП·НшХҫИПН¬Жд№Ыөг»тЦӨКөЖдГиКц

Па№Ш№ҘВФ

ёь¶аН¬АаёьРВ

ёь¶аИИУОНЖјц

ёь¶а-

- әҪМм»рјэДЈДвЖч

- Android/ | ДЈДвСшіЙ

- 2026-04-07

-

- ГьФЛЖпКҝНЕ

- Android/ | ҪЗЙ«°зСЭ

- 2026-03-30

-

-

-

-

-

- Ч№РЗҙуВҪ Вт¶П°ж

- Android/ | ҪЗЙ«°зСЭ

- 2026-03-30

-

- ПжICPұё14008430әЕ-1 П湫Нш°Іұё 43070302000280әЕ

- All Rights Reserved

- ұҫХҫОӘ·ЗУҜАыНшХҫЈ¬І»ҪУКЬИОәО№гёжЎЈұҫХҫЛщУРИнјюЈ¬¶јУЙНшУС

- ЙПҙ«Ј¬ИзУРЗЦ·ёДгөД°жИЁЈ¬Зл·ўУКјюёшxiayx666@163.com

- өЦЦЖІ»БјЙ«ЗйЎў·ҙ¶ҜЎўұ©БҰУОП·ЎЈЧўТвЧФОТұЈ»ӨЈ¬Ҫч·АКЬЖӯЙПөұЎЈ

- КК¶ИУОП·ТжДФЈ¬іБГФУОП·ЙЛЙнЎЈәПАн°ІЕЕКұјдЈ¬ПнКЬҪЎҝөЙъ»оЎЈ