ЪЙгУOllamaБОЕиВПЪ№OpenClawФЃаЭХфжУНЬГЬ

РДдДЃКЛЅСЊЭј 2026-05-10 18:46:19БОЮФНщЩмЯШАВзАopenclawЃЌдкНщЩмШчКЮАВзАВЂХфжУБОЕиФЃаЭЙЄОпollamaЃЌВЂСЌНгБОЕиЕФФЃаЭЁЃ ЛљДЁШэгВМў ЯывЊЫГРћдЫааБОЕиAIФЃаЭЃЌгВМўХфжУЪЧЙиМќЁЃРДПДПДашвЊФФаЉЛљДЁЬѕМўЃК CPUЃКЭЦМі4КЫМАвдЩЯХфжУЃЌШыУХМЖЩшБИдЫаа7BФЃаЭЛљБОУЛЮЪЬт ФкДцЃКжСЩй16GBЦ№ВНЃЌдЫаа7BФЃаЭЪБ16GBИеКУЙЛгУ GP

БОЮФНщЩмЯШАВзАopenclawЃЌдкНщЩмШчКЮАВзАВЂХфжУБОЕиФЃаЭЙЄОпollamaЃЌВЂСЌНгБОЕиЕФФЃаЭЁЃ

ЛљДЁШэгВМў

ЯывЊЫГРћдЫааБОЕиAIФЃаЭЃЌгВМўХфжУЪЧЙиМќЁЃРДПДПДашвЊФФаЉЛљДЁЬѕМўЃК

- CPUЃКЭЦМі4КЫМАвдЩЯХфжУЃЌШыУХМЖЩшБИдЫаа7BФЃаЭЛљБОУЛЮЪЬт

- ФкДцЃКжСЩй16GBЦ№ВНЃЌдЫаа7BФЃаЭЪБ16GBИеКУЙЛгУ

- GPUЃКRTX3060 12GЪЧИіВЛДэЕФбЁдёЃЌФмЙЛСїГЉдЫаа7BЁЂ14BЕШжїСїБОЕиФЃаЭЁЃШчЙћУЛгаRTXЯдПЈЛђепДІгкЦЛЙћЙВЯэДцДЂЛЗОГЃЌБОЕиФЃаЭетЬѕТЗЛљБОзпВЛЭЈЁЊЁЊгВМўадФмИњВЛЩЯ

- ЭјТчЃКЪзДЮЯТдиФЃаЭЪБашвЊЮШЖЈЕФЭјТчСЌНг

- ВйзїЯЕЭГЃКWindows 10/11ЃЈ64ЮЛЃЉЪЧзюМббЁдёЃЌащФтЛњЕФЯТдиТЗОЖПЩвдВЮПМЁЖAIАВШЋЁЗзЈРИЕФЯрЙиФкШн

- ащФтЛњЃКгЩгкopenlawШЈЯовЊЧѓНЯИпЃЌЧПСвНЈвщдкащФтЛњЛЗОГжаАВзАдЫааЃЌетбљФмгааЇБмУтЮѓВйзїЕМжТЯЕЭГЮФМўЪмЫ№

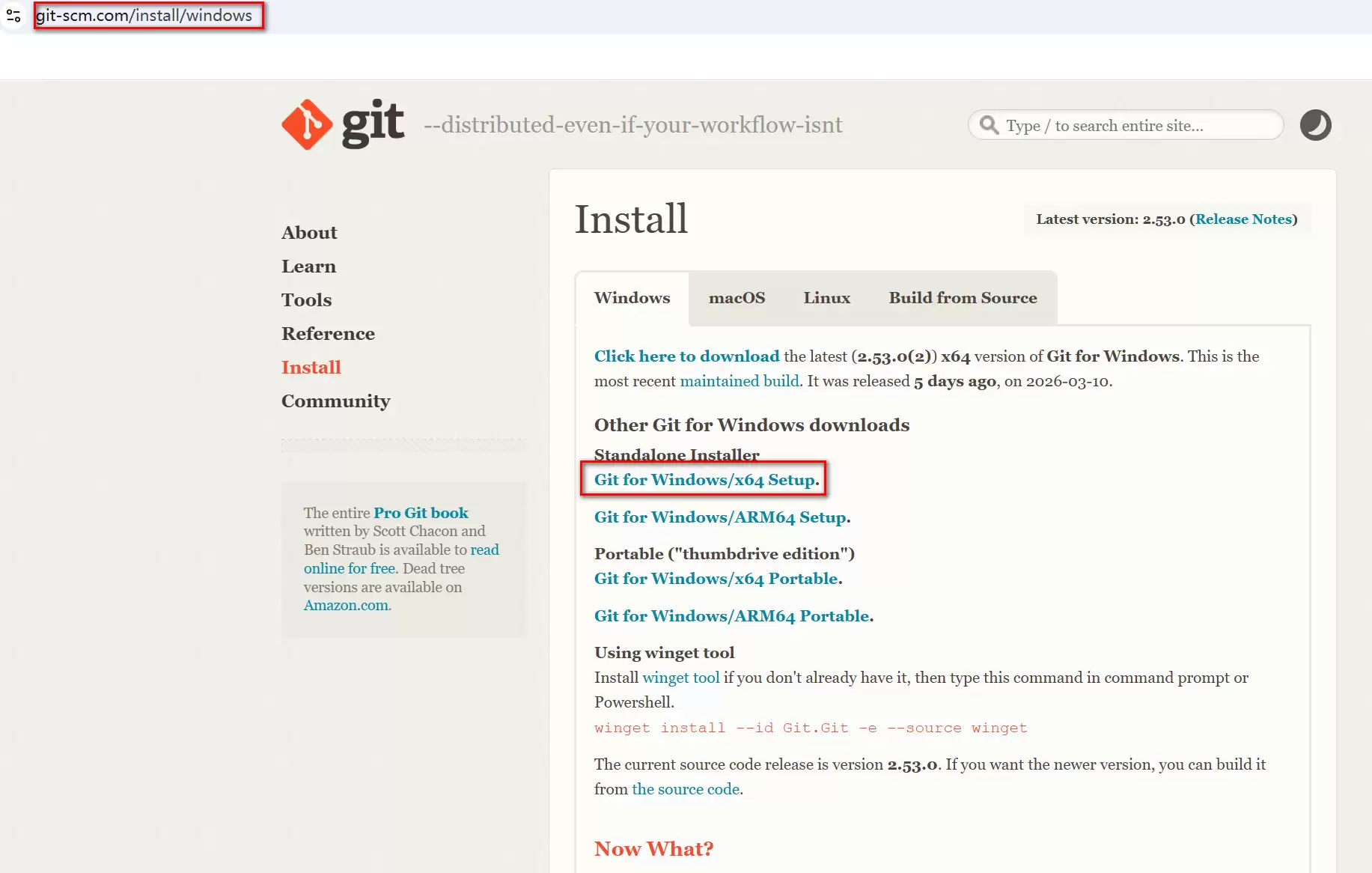

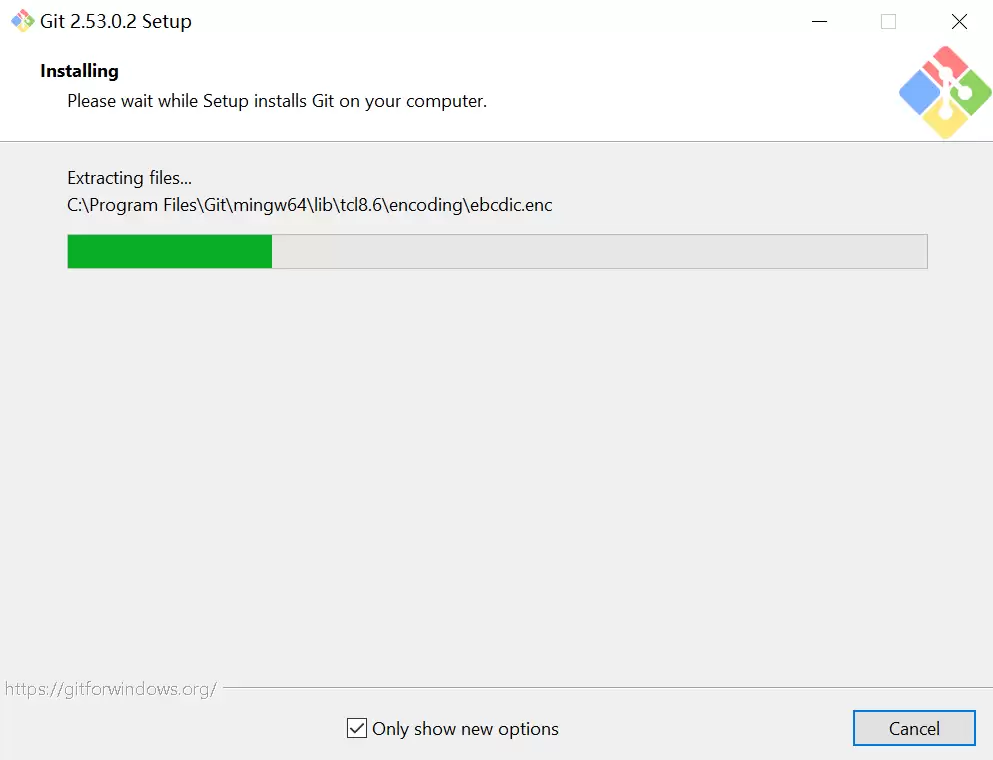

АВзАGit

етИіЙЄОпжївЊИКд№ДгGitHubЛёШЁзЪдДЃЌАВзАЙ§ГЬШчЯТЃК

ГЄЦкЮШЖЈИќаТЕФдмОЂзЪдДЃК >>>ЕуДЫСЂМДВщПД<<<

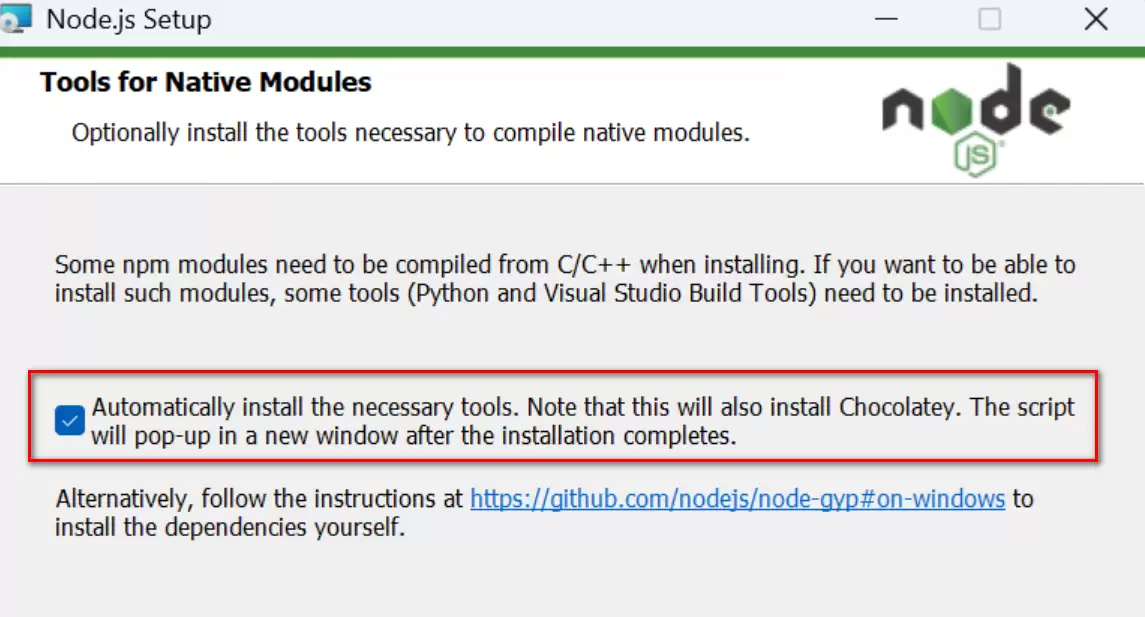

АВзАNodeJs

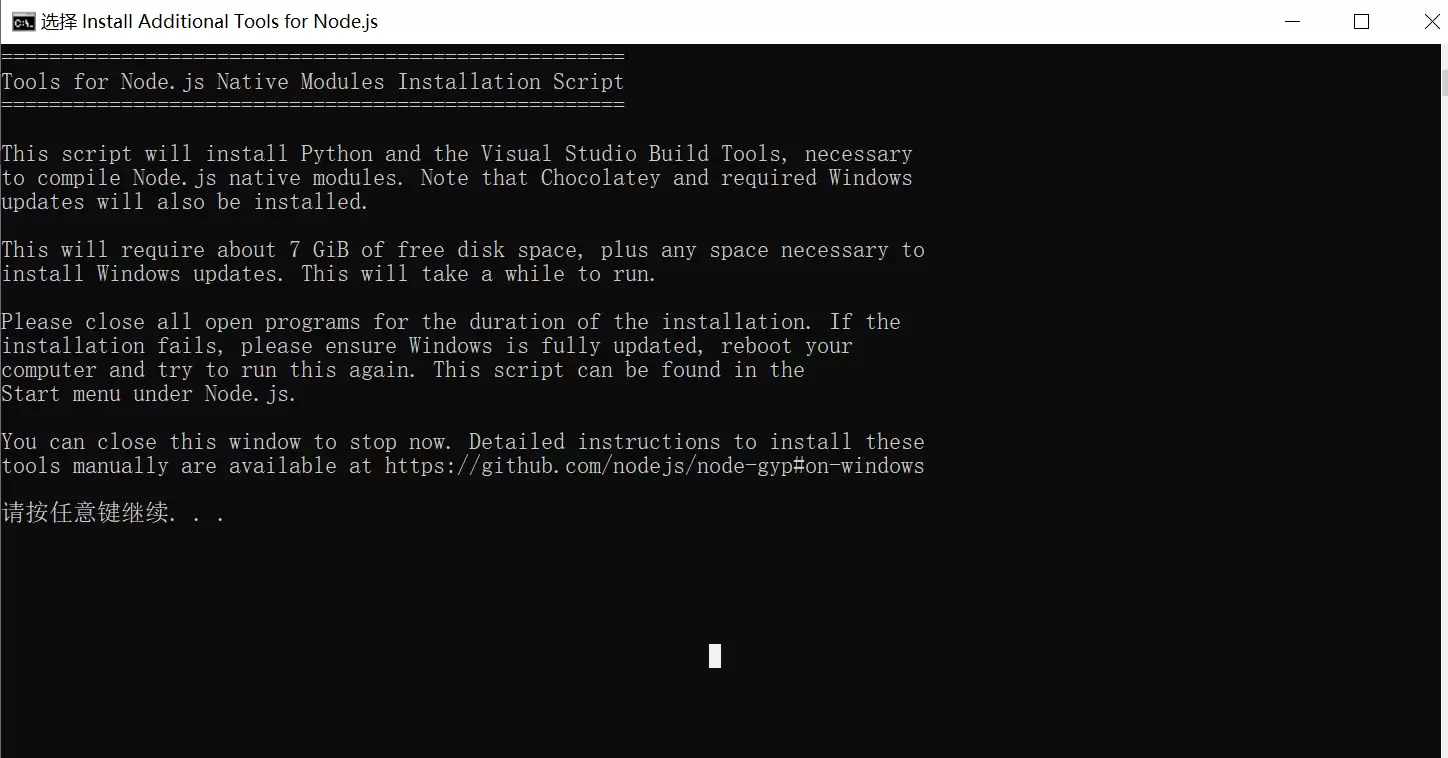

зїЮЊЛљгкNodeJSПЊЗЂЕФЯюФПЃЌopenclawдЫааЕФЧАЬсОЭЪЧДюНЈКУNodeJSЛЗОГЁЃЧАЭљЙйЭјЯТдиАВзААќЃЈСДНгМћетРяЃЉЃЌОпЬхВйзїШчЯТЃК

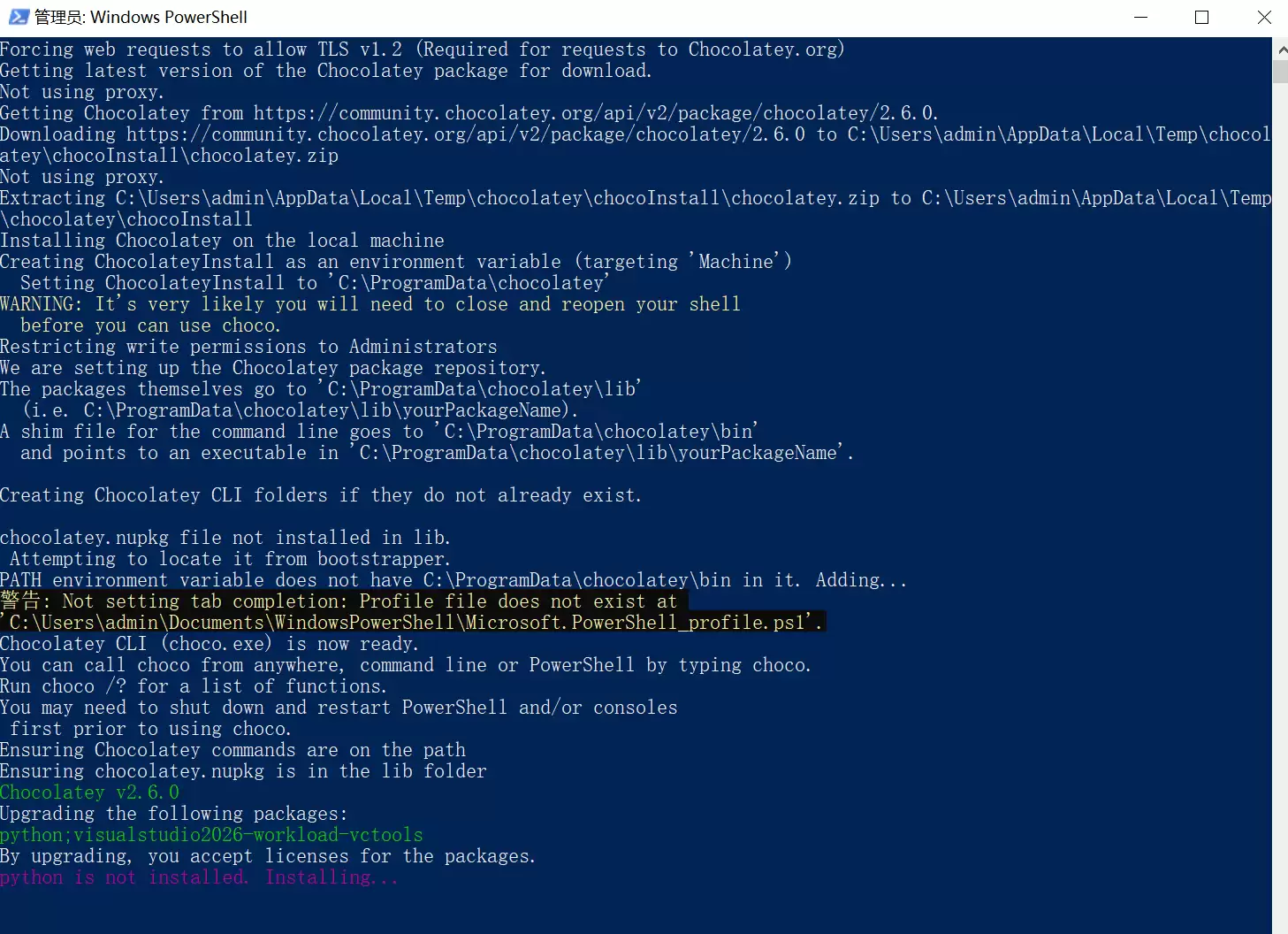

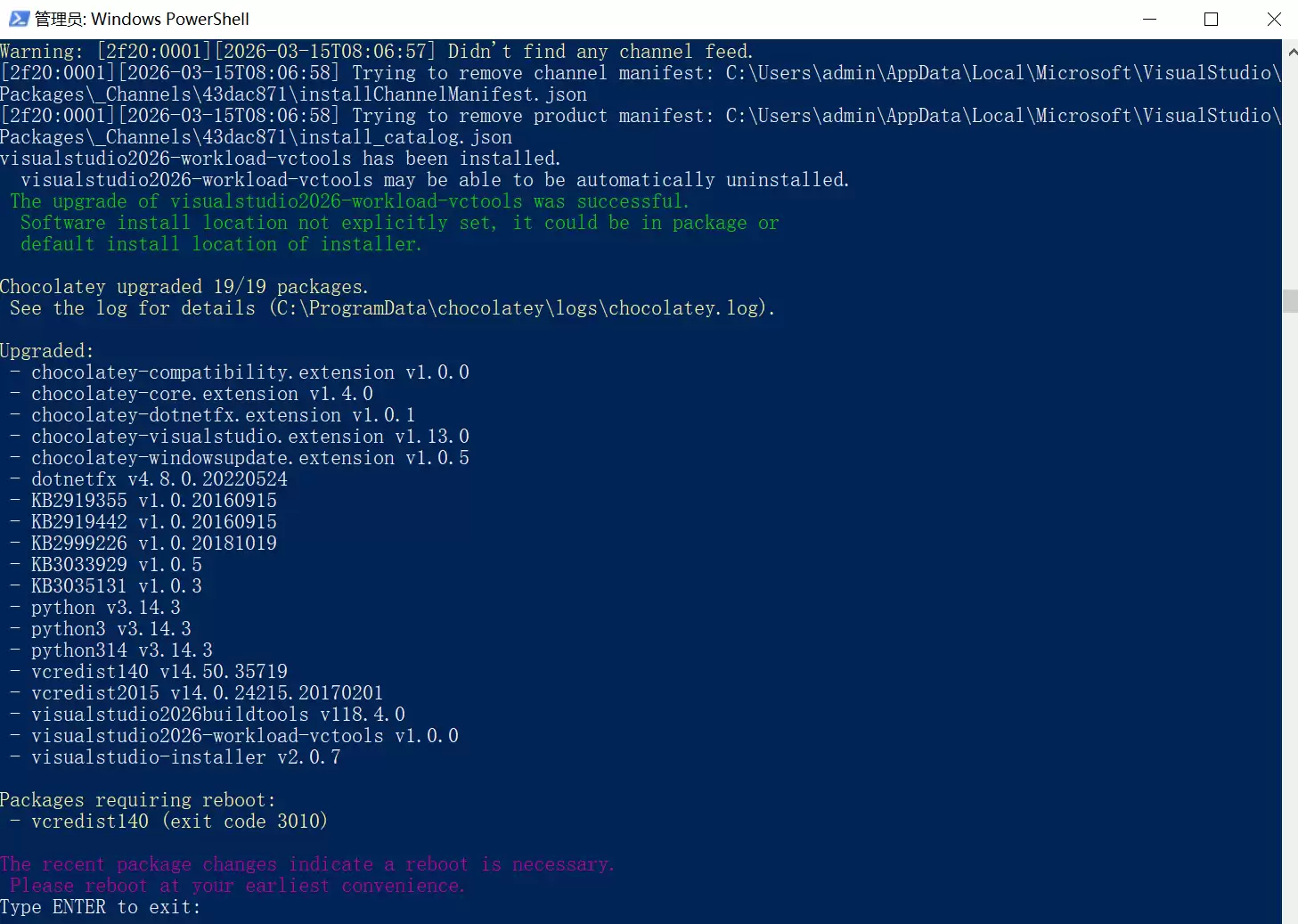

АВзАЙ§ГЬжагаИіЙиМќЯИНкашвЊЬиБ№зЂвтЃКЮёБиЙДбЁЁАздЖЏАВзАЫљашвРРЕЙЄОпЁБбЁЯюЁЃNodeJSжїЬхАВзАЭъГЩКѓЃЌетаЉвРРЕЕФздЖЏАВзАЛЙашвЊ10ЖрЗжжгЁЃ

NodeJSАВзАЭъБЯЛсЬсЪОАДШЮвтМќМЬајЃК

НгзХЯЕЭГЛсздЖЏЕїгУPowerShellАВзАЦфЫћвРРЕШэМўЃК

ШЋВПАВзАЭъГЩКѓЕФНчУцЃК

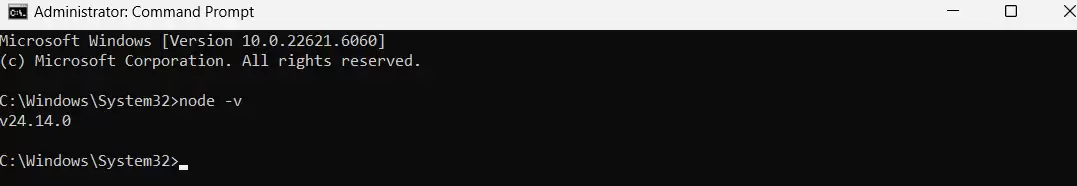

ЪЙгУвдЯТУќСюбщжЄNodeJSЪЧЗёАВзАГЩЙІЃК

АВзА OpenClaw

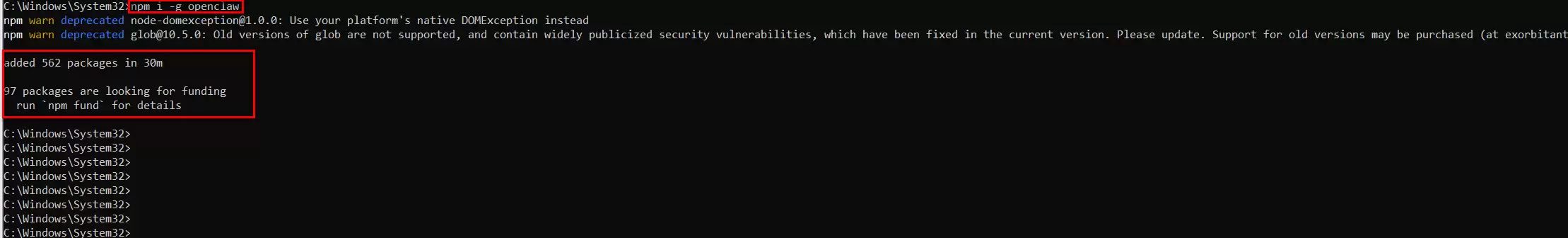

NodeJSЛЗОГОЭаїКѓЃЌОЭПЩвдЭЈЙ§NPMАВзАopenclawСЫЁЃМЧЕУгУЙмРэдБШЈЯоДђПЊPowerShellЃЌжДааУќСю npm i -g openclawЃК

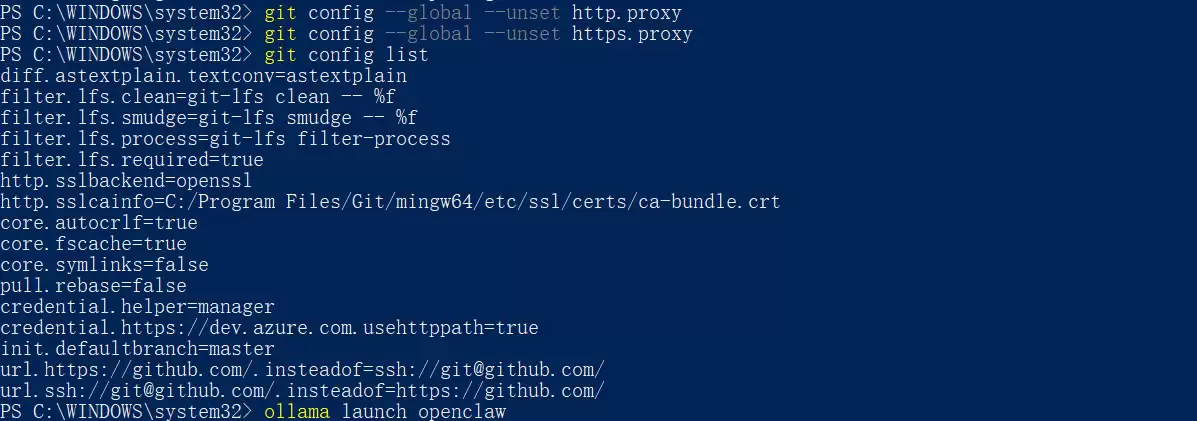

АВзАЙ§ГЬПЩФмашвЊЕШД§вЛЖЮЪБМфЁЃШчЙћгіЕНДэЮѓЬсЪОЃЌЭЈГЃгаСНИіХХВщЗНЯђЃКЪзЯШМьВщproxyХфжУЃЌЪЙгУgit config listВщПДЩшжУЃЌБивЊЪБПЩвдШЁЯћproxyЩшжУЃК

ЕкЖўИіНтОіЗНАИЪЧжДаавдЯТУќСюЃК

git config --global url."https://github.com/".insteadOf ssh://git@github.com/АВзАollama

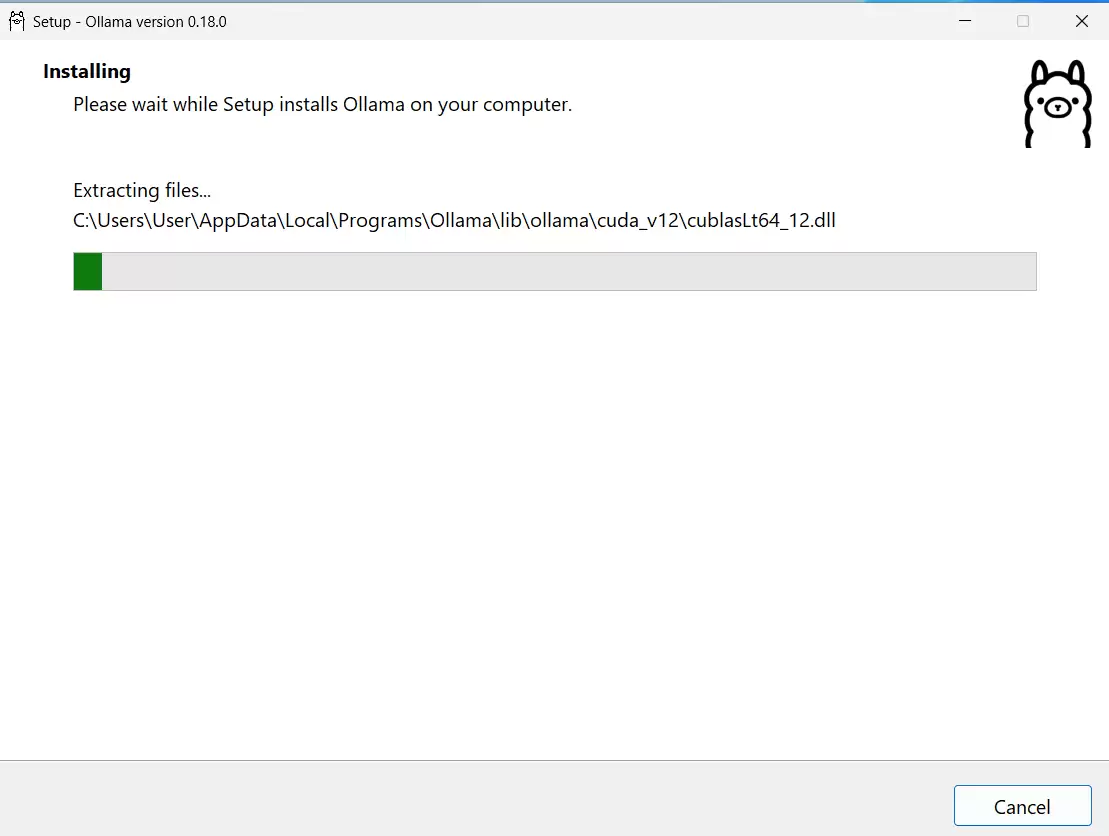

ЗУЮЪollamaЙйЭјЃЌЯЕЭГЛсздЖЏМьВтВйзїЯЕЭГВЂИјГіЖдгІЕФАВзАУќСюЁЃвдЯТЪЧWindowsЦНЬЈЕФАВзАЗНЗЈЃК

вдЙмРэдБШЈЯоДђПЊPowerShellЃЌдЫаавдЯТУќСюАВзАollamaЃК

irm https://ollama.com/install.ps1 | iexвВПЩвджБНгДгЙйЭјЯТдиАВзААќЁЃШчЙћЯТдиЫйЖШВЛРэЯыЃЌЕБЧАзюаТАцБОЮЊ0.18ЃК

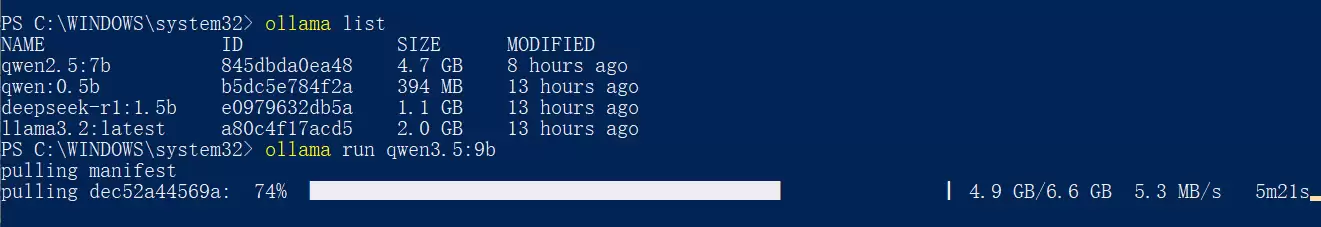

РШЁФЃаЭ

ollamaГЬађАВзАЭъГЩКѓЃЌашвЊЭЈЙ§ollama runУќСюРШЁЫљашЕФФЃаЭЁЃЙигкФЃаЭбЁдёЃЌПЩвдВЮПМетРяЕФЯъЯИаХЯЂЃК

ФЃаЭОЭЮЛКѓЃЌОЭПЩвдЪЙгУollamaПЭЛЇЖЫНјааЖдЛАСЫЃК

ХфжУOpenClaw

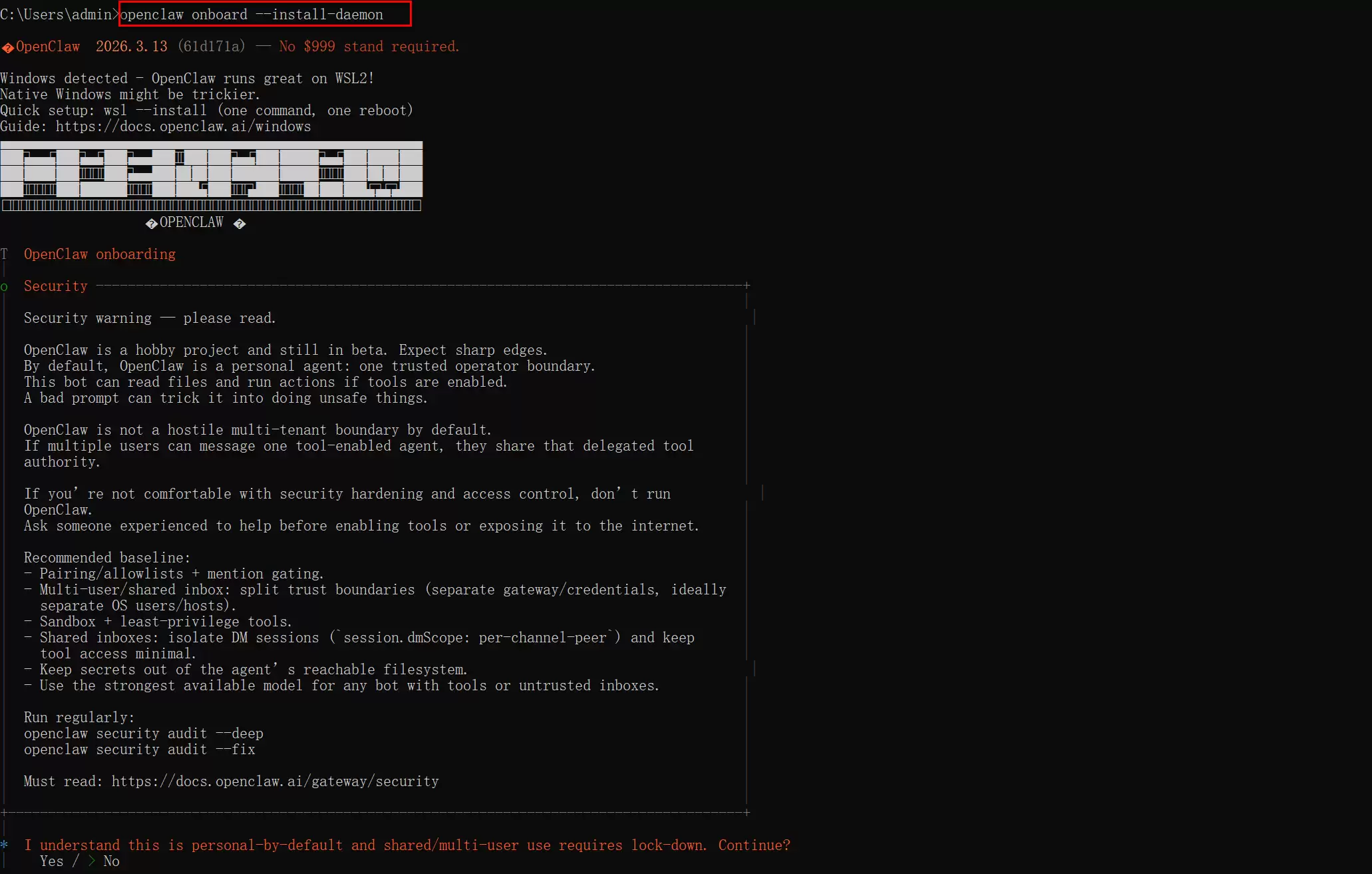

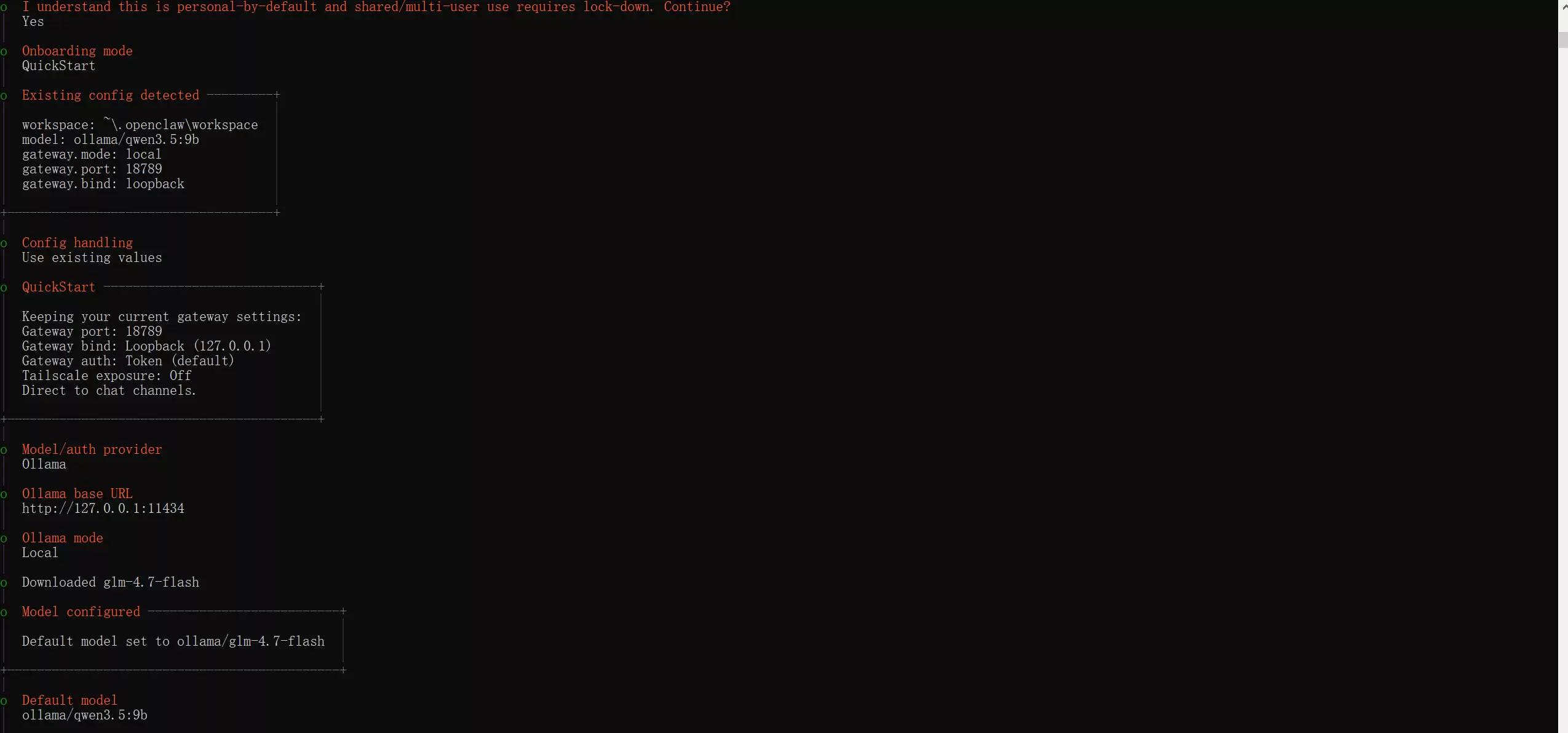

дкCMDжаЪЙгУУќСюopenclaw onboard --install-daemonНјааХфжУЃК

етРягаИіЪЕгУНЈвщЃКДѓВПЗжХфжУЯюЖМПЩвдднЪБЬјЙ§ЃЌЕШЕНОпЬхЙІФмашвЊЪБдйЛиЭЗХфжУвВВЛГйЁЃ

openclawжївГУц

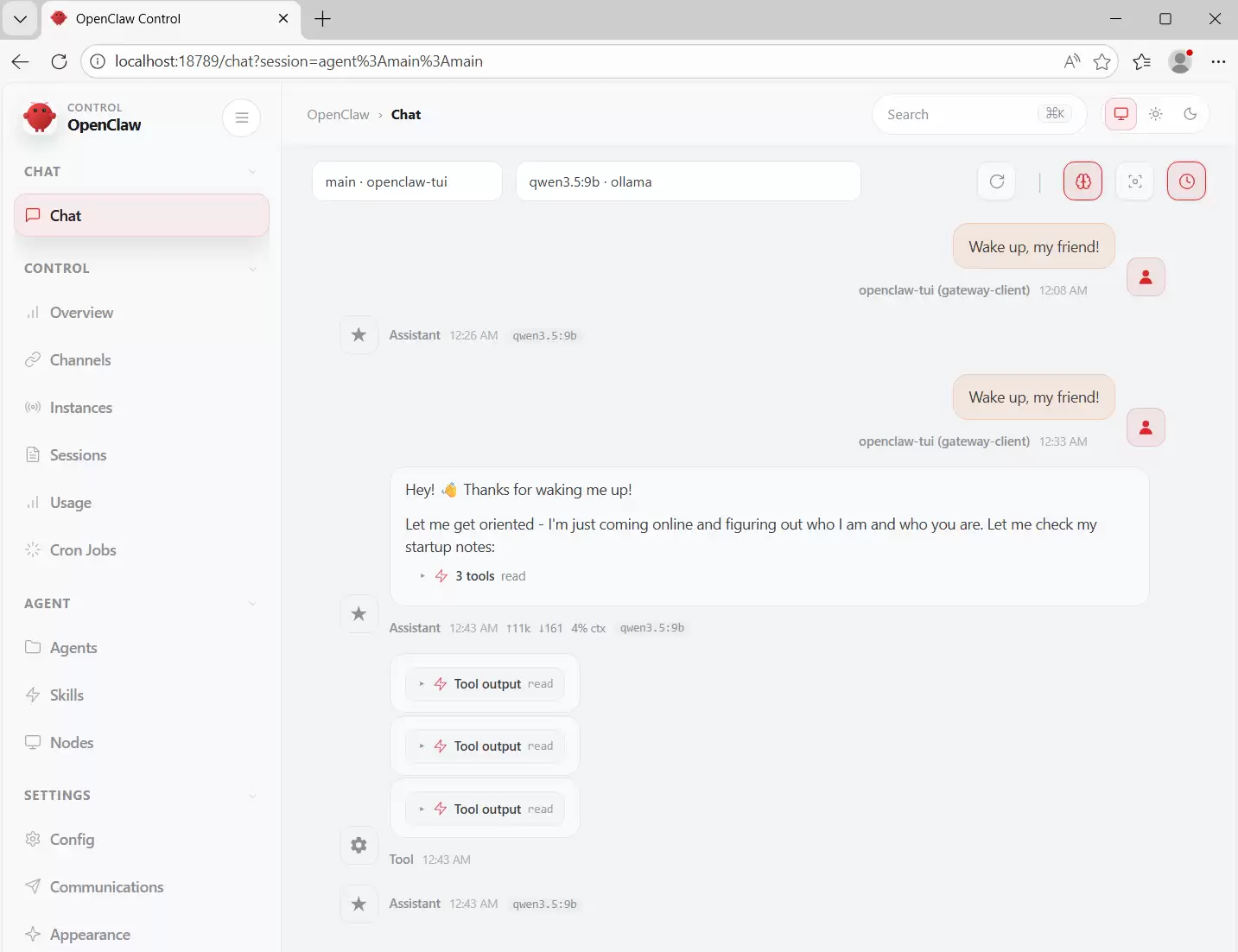

ДђПЊБОЕи18789ЖЫПкЃЌОЭФмПДЕНopenclawЕФжївГУцЃК

ашвЊЫЕУїЕФЪЧЃЌБОЮФжївЊОлНЙгкЛљДЁЛЗОГДюНЈЃЌКмЖрЯъЯИХфжУЛсдкКѓајЕФЁЖAIАВШЋЁЗзЈРИжаж№вЛеЙПЊЃЌОДЧыЙизЂЯрЙиИќаТЁЃ

ЯРгЮЯЗЗЂВМДЫЮФНіЮЊСЫДЋЕнаХЯЂЃЌВЛДњБэЯРгЮЯЗЭјеОШЯЭЌЦфЙлЕуЛђжЄЪЕЦфУшЪі

ЯрЙиЙЅТд

ИќЖрЭЌРрИќаТ

ИќЖрШШгЮЭЦМі

ИќЖр-

- КНЬьЛ№М§ФЃФтЦї

- Android/ | ФЃФтбјГЩ

- 2026-04-07

-

- УќдЫЦяЪПЭХ

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

-

-

-

-

- зЙаЧДѓТН ТђЖЯАц

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

- ЯцICPБИ14008430КХ-1 ЯцЙЋЭјАВБИ 43070302000280КХ

- All Rights Reserved

- БОеОЮЊЗЧгЏРћЭјеОЃЌВЛНгЪмШЮКЮЙуИцЁЃБОеОЫљгаШэМўЃЌЖМгЩЭјгб

- ЩЯДЋЃЌШчгаЧжЗИФуЕФАцШЈЃЌЧыЗЂгЪМўИјxiayx666@163.com

- ЕжжЦВЛСМЩЋЧщЁЂЗДЖЏЁЂБЉСІгЮЯЗЁЃзЂвтздЮвБЃЛЄЃЌНїЗРЪмЦЩЯЕБЁЃ

- ЪЪЖШгЮЯЗвцФдЃЌГСУдгЮЯЗЩЫЩэЁЃКЯРэАВХХЪБМфЃЌЯэЪмНЁПЕЩњЛюЁЃ