iPhone 17 ProЪЕВтдЫаа4000вкВЮЪ§ДѓФЃаЭЃЌЭЦРэЫйЖШЛКТ§ФбЪЕгУ

РДдДЃКЛЅСЊЭј 2026-05-08 16:19:17дкiPhone 17 ProЩЯдЫаа4000вкВЮЪ§ДѓФЃаЭЃЌММЪѕЭЛЦЦЕЋЫйЖШЛКТ§ ЭЈГЃЃЌдЫаагЕга4000вкВЮЪ§ЕФДѓаЭгябдФЃаЭашвЊХфБИДѓШнСПФкДцЕФИпадФмгВМўЃЌМДЪЙЪЧСПЛЏбЙЫѕАцБОвВжСЩйвЊЧѓ200GBФкДцЁЃвдДЫБъзМКтСПЃЌiPhone 17 ProВЂЗЧдЫааДЫРрОоаЭФЃаЭЕФРэЯыЦНЬЈЁЃЕЋНќЦквЛЯюЭЛЦЦБэУїЃЌвбгаШЫГЩЙІдкет

дкiPhone 17 ProЩЯдЫаа4000вкВЮЪ§ДѓФЃаЭЃЌММЪѕЭЛЦЦЕЋЫйЖШЛКТ§

ЭЈГЃЃЌдЫаагЕга4000вкВЮЪ§ЕФДѓаЭгябдФЃаЭашвЊХфБИДѓШнСПФкДцЕФИпадФмгВМўЃЌМДЪЙЪЧСПЛЏбЙЫѕАцБОвВжСЩйвЊЧѓ200GBФкДцЁЃвдДЫБъзМКтСПЃЌiPhone 17 ProВЂЗЧдЫааДЫРрОоаЭФЃаЭЕФРэЯыЦНЬЈЁЃЕЋНќЦквЛЯюЭЛЦЦБэУїЃЌвбгаШЫГЩЙІдкетПюЦьНЂЪжЛњЩЯзіЕНСЫетвЛЕуЃЌетРыВЛПЊвЛЯЕСаЧЩУюЕФММЪѕЗНАИЁЃ

ГЄЦкЮШЖЈИќаТЕФдмОЂзЪдДЃК >>>ЕуДЫСЂМДВщПД<<<

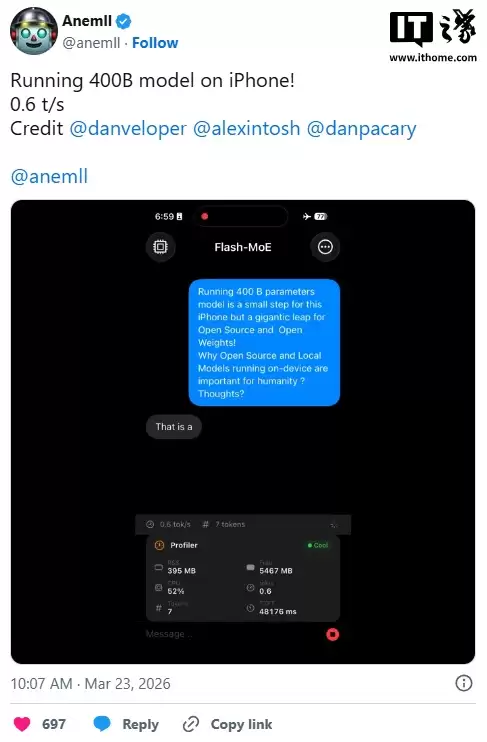

FlashMoEЯюФПЪЕЯжЪжЛњЖЫдЫааЃЌЩњГЩЫйЖШНіЮЊ0.6 token/Уы

ПЊдДЯюФПFlashMoEзюНќГЩЙІдкiPhone 17 ProЩЯдЫааСЫ4000вкВЮЪ§ФЃаЭЁЃИљОнгУЛЇ@anemllЕФбнЪОЃЌЪжЛњЫфШЛФмдЫааетвЛИпЫуСІашЧѓФЃаЭЃЌЕЋвВБЉТЖГіЯджјадФмЦПОБЃКЦфTokenЩњГЩЫйЖШНіЮЊ0.6Иі/УыЃЌЯрЕБгкУП1.5жС2УыЩњГЩвЛИіЕЅДЪЃЌЖдгУЛЇФЭаФЪЧвЛДѓПМбщЁЃ

ММЪѕРяГЬБЎЃКдЄЪОЪжЛњБОЕидЫааДѓФЃаЭЕФЮДРДЧБСІ

ЮоТлШчКЮЃЌФмЙЛдкжЧФмЪжЛњЩЯдЫаа4000вкВЮЪ§ДѓгябдФЃаЭБОЩэОпгаРяГЬБЎвтвхЁЃетвЛГЩЙћЧхЮњБэУїЃЌЭЈЙ§ГжајгХЛЏЃЌЮДРДдкЪжЛњЖЫБОЕидЫааДѓаЭгябдФЃаЭОпБИПЩааадЁЃ

ШчКЮЭЛЦЦгВМўЯожЦЃПНшжњSSDСїЪНДЋЪфгыMoEМмЙЙ

iPhone 17 ProНіХфБИ12GB LPDDR5XФкДцЃЌЮоЗЈЭъећдиШыДѓФЃаЭЁЃFlashMoEЭЈЙ§СНЯюЙиМќММЪѕЭЛЦЦЯожЦЃКвЛЪЧРћгУЩшБИЙЬЬЌгВХЬЃЈSSDЃЉжБНгЯђGPUСїЪНДЋЪфЪ§ОнЃЛЖўЪЧВЩгУЛьКЯзЈМвФЃаЭЃЈMoEЃЉМмЙЙЃЌУПДЮЩњГЩЕЅДЪЪБНіЕїгУ4000вкВЮЪ§жаЕФвЛаЁВПЗжЃЌЖјЗЧШЋВПВЮЪ§ЁЃ

БОЕидЫааЕФгХЪЦгыДњМлЃКвўЫНБЃЛЄгыЕчСПЯћКФ

дкЪжЛњБОЕидЫааДѓгябдФЃаЭЕФЯджјгХЪЦАќРЈЭъШЋБЃЛЄгУЛЇвўЫНЃЌЧвЮоашСЊЭјМДПЩЛёЕУЛиИДЁЃЕЋДњМлЪЧiPhone 17 ProЕФЕчГиЯћКФЛсЗЧГЃУїЯдЁЃПЊЗЂепЭЈГЃЪЙгУСПЛЏбЙЫѕАцФЃаЭЃЌЕЋМДБуЪЧСПЛЏКѓЕФ4000вкВЮЪ§ФЃаЭвВжСЩйашвЊ200GBФкДцЃЌетдБОЪЧiPhoneЮоЗЈПЫЗўЕФеЯАЁЃ

ЁАФмЙЛдЫааЁБгыЁАСїГЉПЩгУЁБШдгаОрРы

ДЫДЮбнЪОжЄУїЃЌШєФмНгЪмУПУы0.6ИіTokenЕФЩњГЩЫйЖШЃЌжЧФмЪжЛњШЗЪЕПЩвддЫаа4000вкВЮЪ§ДѓФЃаЭЁЃЕЋашвЊУїШЗЃЌЁАФмЙЛдЫааЁБгыЁАФмЙЛСїГЉЁЂПЩгУЕиЪЙгУЁБШдЪЧСНИіВЛЭЌИХФюЁЃММЪѕНјВНЪМгкБпНчЭЛЦЦЃЌЖјзпЯђЪЕгУЛЏШдашИќГЄЕФТЗвЊзпЁЃ

ЯРгЮЯЗЗЂВМДЫЮФНіЮЊСЫДЋЕнаХЯЂЃЌВЛДњБэЯРгЮЯЗЭјеОШЯЭЌЦфЙлЕуЛђжЄЪЕЦфУшЪі

ЯрЙиЙЅТд

ИќЖрЭЌРрИќаТ

ИќЖрШШгЮЭЦМі

ИќЖр-

- КНЬьЛ№М§ФЃФтЦї

- Android/ | ФЃФтбјГЩ

- 2026-04-07

-

- УќдЫЦяЪПЭХ

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

-

-

-

-

- зЙаЧДѓТН ТђЖЯАц

- Android/ | НЧЩЋАчбн

- 2026-03-30

-

- ЯцICPБИ14008430КХ-1 ЯцЙЋЭјАВБИ 43070302000280КХ

- All Rights Reserved

- БОеОЮЊЗЧгЏРћЭјеОЃЌВЛНгЪмШЮКЮЙуИцЁЃБОеОЫљгаШэМўЃЌЖМгЩЭјгб

- ЩЯДЋЃЌШчгаЧжЗИФуЕФАцШЈЃЌЧыЗЂгЪМўИјxiayx666@163.com

- ЕжжЦВЛСМЩЋЧщЁЂЗДЖЏЁЂБЉСІгЮЯЗЁЃзЂвтздЮвБЃЛЄЃЌНїЗРЪмЦЩЯЕБЁЃ

- ЪЪЖШгЮЯЗвцФдЃЌГСУдгЮЯЗЩЫЩэЁЃКЯРэАВХХЪБМфЃЌЯэЪмНЁПЕЩњЛюЁЃ